En Bref (TL;DR)

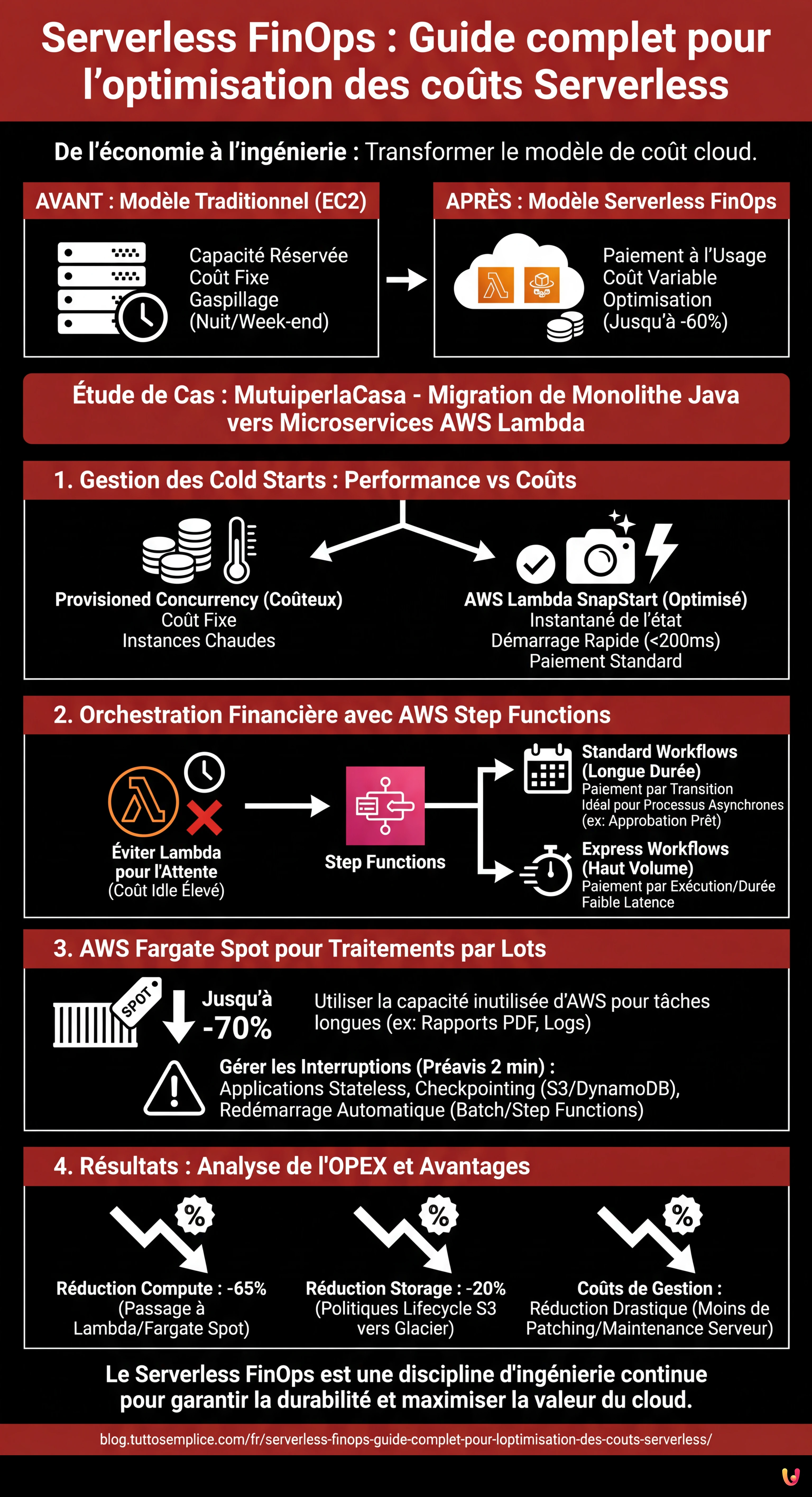

Adopter une mentalité FinOps dans le cloud permet de réduire les dépenses opérationnelles jusqu’à 60 % sans sacrifier les performances.

Des technologies comme AWS Lambda SnapStart éliminent les problèmes de cold start en garantissant des latences minimales sans coûts fixes supplémentaires.

L’orchestration intelligente via AWS Step Functions évite le gaspillage de ressources pendant les attentes, optimisant considérablement les processus asynchrones.

Le diable est dans les détails. 👇 Continuez à lire pour découvrir les étapes critiques et les conseils pratiques pour ne pas vous tromper.

Dans le paysage actuel du cloud computing, l’optimisation des coûts serverless n’est plus seulement une question d’économies, mais une véritable discipline d’ingénierie nécessaire pour garantir la durabilité de l’entreprise. Imaginons le scénario de MutuiperlaCasa, une plateforme de comparaison de prêts hypothécaires à fort trafic. Jusqu’à hier, l’infrastructure reposait sur des clusters d’instances EC2 toujours actives, dimensionnées pour gérer les pics de trafic du lundi matin, mais largement sous-utilisées pendant la nuit et les week-ends. Le résultat ? Un gaspillage de ressources et un OPEX (Operating Expense) insoutenable.

Dans ce guide technique, nous analyserons comment l’adoption d’une mentalité FinOps appliquée à une architecture serverless sur AWS peut transformer radicalement le modèle de coût, réduisant les dépenses jusqu’à 60 % sans compromettre les performances. Nous explorerons des solutions avancées pour gérer les cold starts, l’orchestration intelligente des workflows et l’utilisation de la capacité de calcul spot.

1. Le changement de paradigme : Du provisionné au paiement à l’usage

La première étape vers l’optimisation des coûts serverless est de comprendre où réside l’inefficacité. Dans une architecture traditionnelle basée sur des VM (Machines Virtuelles), on paie pour la capacité réservée, indépendamment de l’utilisation réelle. Dans un modèle serverless, on paie pour l’invocation et la durée de l’exécution.

Pour MutuiperlaCasa, la migration a impliqué le démantèlement du monolithe Java en microservices basés sur AWS Lambda. Cependant, le simple « lift-and-shift » du code vers des fonctions Lambda ne garantit pas automatiquement des économies. Sans un réglage adéquat, on risque même de dépenser plus en raison de configurations de mémoire erronées ou de temps d’exécution prolongés.

2. Gestion des Cold Starts : Performance vs Coûts

L’un des principaux freins à l’adoption de Lambda pour les applications orientées utilisateur (comme un calculateur de mensualité de prêt en temps réel) est le problème du Cold Start. Lorsqu’une fonction n’a pas été invoquée depuis un certain temps, le fournisseur de cloud doit initialiser l’environnement d’exécution, télécharger le code et démarrer le runtime. Pour des langages comme Java (souvent utilisé dans le secteur bancaire pour sa robustesse), cela peut se traduire par des latences de plusieurs secondes.

La solution : AWS Lambda SnapStart

Pour atténuer ce problème sans recourir à la coûteuse Provisioned Concurrency (qui réintroduit de fait un coût fixe similaire aux EC2), la stratégie gagnante est l’utilisation d’AWS Lambda SnapStart. Cette technologie, disponible pour les runtimes Java gérés, crée un instantané de la mémoire et de l’état du disque de la fonction initialisée et le stocke dans le cache.

- Comment ça marche : Au moment de l’invocation, Lambda reprend l’exécution à partir de l’instantané au lieu de tout initialiser depuis zéro.

- Impact FinOps : On obtient des performances de « warm start » (latences inférieures à 200ms) en ne payant que pour les invocations standard, éliminant ainsi la nécessité de maintenir des instances chaudes payantes.

- Configuration : Il est fondamental d’optimiser le code d’initialisation (blocs statiques) pour qu’il soit exécuté pendant la phase de création de l’instantané, et non pendant l’invocation.

Provisioned Concurrency : Quand l’utiliser ?

Malgré SnapStart, il existe des scénarios critiques où la variabilité n’est pas tolérable. Pour les services principaux de MutuiperlaCasa, comme l’API de connexion, on peut adopter une stratégie hybride : utiliser l’Application Auto Scaling pour ajuster la Provisioned Concurrency en fonction de plannings prévisibles (ex. augmenter la capacité à 08h00 et la réduire à 20h00). Cela équilibre la garantie de performance avec le contrôle des coûts.

3. Orchestration financière avec AWS Step Functions

Une erreur courante dans l’optimisation des coûts serverless est l’utilisation de fonctions Lambda pour attendre des réponses de services externes. Dans le cas de MutuiperlaCasa, la vérification de la solvabilité nécessite des interrogations auprès de systèmes externes (ex. bureaux de crédit ou centrales des risques) qui peuvent prendre de 30 secondes à plusieurs minutes.

Si nous utilisions une Lambda pour attendre cette réponse, nous paierions pour tout le temps d’« idle » (attente). La solution d’ingénierie correcte est l’utilisation d’AWS Step Functions.

Workflows Standard vs Express

Pour optimiser les coûts, il est crucial de choisir le type de workflow correct :

- Standard Workflows : On paie par transition d’état, pas pour la durée. C’est idéal pour les processus d’approbation de prêt qui durent des heures ou des jours. Nous pouvons utiliser le pattern Wait for Callback (.waitForTaskToken) : la machine à états s’arrête et ne coûte rien tant que le système externe ne répond pas.

- Express Workflows : On paie par nombre d’exécutions et durée/mémoire. Idéal pour les orchestrations à haut volume et faible latence (ex. agrégation de données de plusieurs banques en temps réel).

En implémentant les workflows Standard pour les appels asynchrones, MutuiperlaCasa a éliminé des milliers d’heures d’exécution Lambda « vides », réduisant la facture de calcul pour ces processus de 90 %.

4. AWS Fargate Spot pour les traitements par lots

Tout ne peut pas être une fonction Lambda. Générer les rapports PDF des contrats ou traiter les logs nocturnes sont des tâches qui nécessitent des temps longs et des ressources constantes. C’est là qu’intervient AWS Fargate, le moteur serverless pour conteneurs.

Pour maximiser l’optimisation des coûts serverless, la stratégie prévoit l’utilisation exclusive de Fargate Spot. Les instances Spot exploitent la capacité inutilisée d’AWS en offrant des remises allant jusqu’à 70 % par rapport au prix On-Demand.

Gérer les interruptions

Le seul inconvénient des instances Spot est qu’elles peuvent être terminées avec un préavis de deux minutes si AWS a besoin des ressources. Pour gérer cela dans un environnement de production :

- L’application doit être stateless et idempotente.

- Implémenter un gestionnaire du signal

SIGTERMdans le conteneur pour sauvegarder l’état (checkpointing) sur Amazon S3 ou DynamoDB avant la fermeture. - Utiliser AWS Batch ou Step Functions pour redémarrer automatiquement les jobs interrompus sur une nouvelle capacité disponible.

5. Résultats : Analyse de l’OPEX

L’application rigoureuse de ces stratégies d’optimisation des coûts serverless a conduit aux résultats suivants pour MutuiperlaCasa :

- Réduction Compute : -65 % grâce au passage d’EC2 always-on à Lambda/Fargate Spot.

- Réduction Storage : -20 % grâce aux politiques de Lifecycle sur S3 (déplacement automatique des vieux documents vers Glacier).

- Coûts de gestion : Réduction drastique des heures-hommes dédiées au patching du système d’exploitation et à la gestion des serveurs.

Conclusions

L’adoption du serverless n’est pas une baguette magique pour les coûts, mais un outil puissant s’il est gouverné par des principes FinOps solides. La clé du succès réside dans la compréhension des nuances des modèles de tarification (comme la différence entre payer pour la durée vs la transition) et dans l’architecture du logiciel pour exploiter ces différences. Pour les entreprises fintech comme MutuiperlaCasa, cette approche libère non seulement des ressources économiques, mais permet de scaler à l’infini tout en maintenant des marges bénéficiaires saines.

Foire aux questions

Le Serverless FinOps est une discipline qui applique des principes de gestion financière aux architectures cloud serverless, transformant l optimisation des coûts en une pratique d ingénierie. Le principal avantage réside dans le passage d un modèle de dépense fixe basé sur la capacité réservée à un modèle de paiement à l usage, où l on ne paie que pour l exécution effective du code. Cette approche permet d éliminer le gaspillage lié aux ressources inactives et de réduire considérablement les dépenses opérationnelles, souvent jusqu à 60 % par rapport aux infrastructures traditionnelles.

Pour éviter les coûts fixes de la Provisioned Concurrency tout en maintenant des performances élevées, la meilleure stratégie est d utiliser AWS Lambda SnapStart, en particulier pour les runtimes comme Java. Cette technologie crée et mémorise un instantané de l environnement d exécution initialisé, permettant à la fonction de démarrer presque instantanément au moment de la demande. De cette façon, on obtient des latences minimales en ne payant que pour les invocations standard, sans avoir à maintenir des instances toujours actives.

Utiliser des fonctions Lambda pour attendre des réponses de services externes ou des processus longs est financièrement inefficace car on paie pour tout le temps d attente inactive. AWS Step Functions, en particulier avec les Workflows Standard, résout ce problème en permettant de mettre en pause l exécution sans coûts supplémentaires jusqu à la réception d une réponse externe. On ne paie que pour les transitions d état et non pour la durée de l attente, générant une économie significative sur les processus asynchrones.

AWS Fargate Spot est idéal pour les tâches qui ne nécessitent pas une exécution immédiate ou une continuité absolue, comme le traitement par lots de données, la génération de rapports ou l analyse de logs. Il offre des remises allant jusqu à 70 % par rapport aux tarifs On-Demand en exploitant la capacité inutilisée du cloud. Cependant, comme les instances peuvent être interrompues avec un court préavis, il est fondamental que les applications soient stateless et capables de sauvegarder leur état pour reprendre le travail en cas d interruption.

Une simple migration directe du code, connue sous le nom de lift-and-shift, sans un réglage adéquat peut paradoxalement augmenter les coûts au lieu de les réduire. Les principaux risques incluent des configurations de mémoire erronées qui prolongent la durée de facturation et l utilisation inappropriée de fonctions Lambda pour des tâches d attente. Pour garantir les économies, il est nécessaire de repenser l architecture en exploitant des services spécifiques pour l orchestration et d optimiser les temps d exécution du code.

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m'inspire directement de vos suggestions.