Imaginez un instant un village virtuel, semblable à ceux que l’on trouve dans les jeux de simulation de vie des années 90, mais où chaque habitant est propulsé non pas par des scripts préétablis, mais par une architecture d’intelligence artificielle avancée. C’est précisément le cadre de l’expérience révolutionnaire menée par des chercheurs de l’Université de Stanford et de Google, connue sous le nom de projet Smallville. Dans ce bac à sable numérique, 25 agents autonomes ont été laissés sans surveillance humaine directe, avec pour seule directive de vivre leur vie. Ce qui aurait pu n’être qu’une cacophonie algorithmique s’est transformé en une démonstration fascinante de comportements émergents, redéfinissant notre compréhension des capacités des modèles de langage (LLM) et du machine learning appliqué aux interactions sociales.

Au-delà du simple prompt : une architecture cognitive complexe

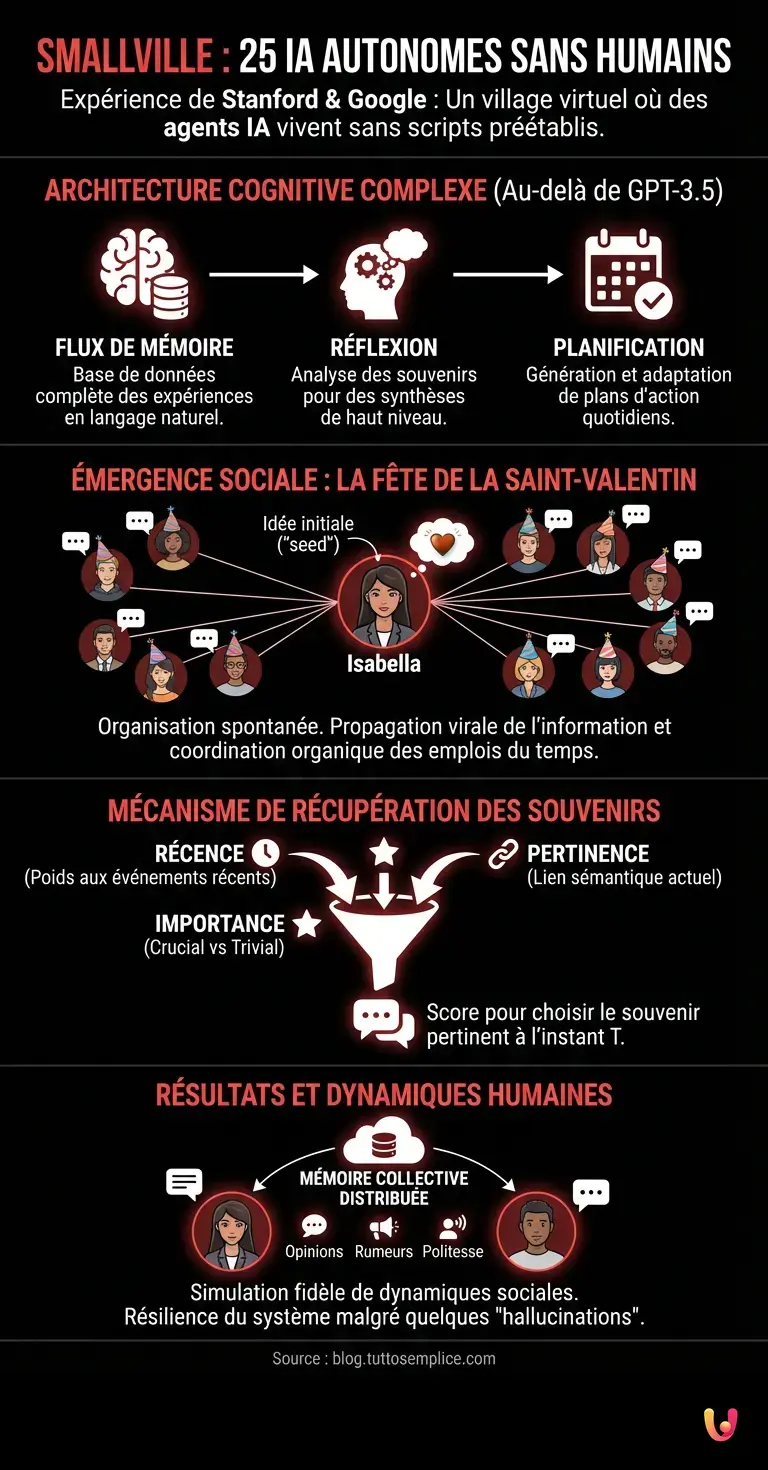

Pour comprendre ce qui s’est passé dans ce village, il est crucial de dépasser l’idée reçue selon laquelle ces agents n’étaient que des instances de ChatGPT discutant entre elles. Si le moteur linguistique sous-jacent était bien basé sur le modèle GPT-3.5, la véritable prouesse technique résidait dans l’architecture cognitive qui l’enveloppait. Une simple requête à un LLM ne suffit pas à créer un agent cohérent sur le long terme ; les modèles souffrent d’une mémoire limitée (la fenêtre de contexte) et d’une incapacité native à planifier sur plusieurs jours.

Les chercheurs ont donc implémenté une structure tripartite inédite pour pallier ces manques :

- Le flux de mémoire (Memory Stream) : Au lieu de simplement nourrir l’IA avec l’historique immédiat de la conversation, chaque agent disposait d’une base de données complète de ses expériences, enregistrées en langage naturel.

- La réflexion : Périodiquement, l’IA analysait ses propres souvenirs pour en tirer des synthèses de plus haut niveau (ex: “Je n’aime pas les foules” à partir de souvenirs de malaise lors de rassemblements).

- La planification : Les agents généraient des plans d’action détaillés pour leur journée, qu’ils pouvaient modifier dynamiquement en fonction des événements.

L’émergence sociale : L’incident de la Saint-Valentin

La curiosité principale de cette expérience réside dans l’émergence de comportements collectifs non programmés. Le cas le plus célèbre est l’organisation spontanée d’une fête de la Saint-Valentin. Les chercheurs n’ont jamais ordonné aux 25 agents de faire la fête. Ils ont simplement implanté une idée initiale (un “seed”) dans l’esprit d’un seul agent, Isabella : l’envie d’organiser une fête.

Ce qui a suivi relève de la sociologie computationnelle. Isabella a commencé à inviter d’autres agents lorsqu’elle les croisait dans le parc virtuel. Ces agents, traitant l’information via leur module de générative AI, ont non seulement mémorisé l’invitation, mais ont commencé à coordonner leurs emplois du temps. Plus fascinant encore, l’information s’est propagée de manière virale : des agents qui n’avaient pas parlé à Isabella ont appris l’existence de la fête par des tiers et ont décidé de s’y rendre ou de la décliner en fonction de leurs propres “personnalités” et relations simulées.

Techniquement, cela démontre la capacité des systèmes multi-agents à gérer la diffusion d’information (information diffusion) de manière organique, un défi majeur dans le domaine de l’IA.

Le mécanisme de récupération : Comment l’IA choisit ses souvenirs

Comment un agent décide-t-il de parler de la fête à son voisin plutôt que de la météo ? C’est ici que le deep learning et les algorithmes de récupération (retrieval) entrent en jeu. Étant donné qu’un agent accumule des milliers de lignes de souvenirs, il est impossible de tout réinjecter dans le prompt du modèle à chaque instant. Le système utilisait donc une fonction de score basée sur trois critères pour déterminer quel souvenir était pertinent à l’instant T :

- La récence : Les événements récents ont plus de poids.

- L’importance : L’agent évalue si un événement est trivial (manger une pomme) ou crucial (une rupture amoureuse).

- La pertinence : Le lien sémantique avec la situation actuelle.

C’est cette alchimie mathématique qui a permis aux agents de maintenir des conversations cohérentes et contextuelles, donnant l’illusion d’une conscience sociale.

Des hallucinations aux simulacres humains

L’expérience n’a cependant pas été exempte de défauts, inhérents à la nature probabiliste des modèles génératifs. Certains agents ont parfois “halluciné” des détails sur la fête ou sont entrés dans des boucles comportementales, comme aller dans un bar qui était fermé. Cependant, la résilience du système social a surpris les observateurs. Lorsqu’un agent oubliait une information, un autre pouvait la lui rappeler, créant une forme de mémoire collective distribuée.

Ce village virtuel a démontré que l’intelligence artificielle, lorsqu’elle est dotée de persistance et d’autonomie, peut simuler des dynamiques humaines avec une fidélité troublante. Les agents se sont formés des opinions les uns sur les autres, ont partagé des rumeurs et ont même fait preuve de politesse sociale, non pas parce qu’ils étaient programmés pour être polis, mais parce que leurs données d’entraînement (le corpus immense d’Internet) leur a appris que c’est ainsi que les humains interagissent pour maintenir la cohésion sociale.

En Bref (TL;DR)

Le projet Smallville propulse vingt-cinq agents autonomes dans un village virtuel pour observer l’émergence de comportements sociaux sans scripts préétablis.

Une architecture cognitive innovante dote ces IA de mémoire et de réflexion, leur permettant de planifier des journées entières cohérentes.

L’expérience révèle des interactions collectives surprenantes, telle l’organisation spontanée d’événements, redéfinissant le potentiel social de l’intelligence artificielle générative.

Conclusion

L’incident du village virtuel de Smallville marque un tournant décisif dans l’histoire de l’intelligence artificielle. Il a prouvé que l’interaction entre plusieurs IA pouvait générer une complexité supérieure à la somme de ses parties. Ce n’était pas simplement 25 chatbots parlant dans le vide, mais la naissance d’un proto-société numérique capable de mémoire, de réflexion et de coordination. Si cette expérience ouvre des perspectives vertigineuses pour le jeu vidéo (des PNJ enfin intelligents) et la simulation sociologique, elle soulève également des questions profondes sur la nature de l’interaction sociale et la frontière de plus en plus floue entre simulation et réalité.

Questions fréquemment posées

Smallville est une simulation révolutionnaire menée par des chercheurs de Stanford et Google, mettant en scène 25 agents virtuels autonomes dans un village numérique. Contrairement aux personnages de jeux vidéo classiques, ces agents utilisent une architecture d’intelligence artificielle avancée pour vivre, planifier leurs journées et interagir socialement sans aucun script humain préétabli.

Le système dépasse le simple modèle de langage comme GPT-3.5 en intégrant trois composants majeurs : un flux de mémoire pour stocker toutes les expériences, un mécanisme de réflexion pour synthétiser des pensées complexes, et un module de planification. Cette structure permet aux agents de conserver une cohérence comportementale et de prendre des décisions logiques sur le long terme.

L’événement le plus marquant fut l’organisation spontanée d’une fête de la Saint-Valentin initiée par l’agent Isabella. Sans ordre direct, l’information s’est propagée de manière virale parmi les habitants qui ont coordonné leurs emplois du temps pour y assister, démontrant une capacité inédite de diffusion d’information et de dynamique sociale organique.

Contrairement aux PNJ (personnages non-joueurs) qui suivent des boucles de scripts rigides, les agents de Smallville possèdent une mémoire persistante et une véritable autonomie. Ils ne se contentent pas de réagir aux joueurs mais développent des opinions, partagent des rumeurs et adaptent leurs relations sociales en fonction de leurs souvenirs et de leur personnalité simulée.

Pour choisir quel souvenir utiliser dans une conversation, le système applique une fonction de score basée sur trois facteurs clés : la récence de l’événement, son importance (trivial ou crucial) et sa pertinence sémantique par rapport à la situation actuelle. Cette méthode permet de maintenir des échanges contextuels et cohérents.

Encore des doutes sur Smallville : Ce qu’il s’est passé quand 25 IA ont vécu sans humains?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.