O treino dos grandes modelos de linguagem sofreu uma transformação radical com a introdução do Vitruvian-1. No panorama da Informática de 2026, já não é suficiente confiar exclusivamente no feedback humano (RLHF) para a otimização das políticas. Para garantir uma precisão absoluta nas respostas técnicas, de engenharia e matemáticas, a indústria mudou para o uso de verificadores determinísticos. Este guia técnico explora em detalhe a arquitetura de validação, explicando como os testes unitários e as verificações matemáticas são integrados diretamente no ciclo de Reinforcement Learning (RL) para eliminar as alucinações e maximizar a fiabilidade do código gerado.

Introdução ao Reinforcement Learning Determinístico

No contexto do Vitruvian-1, para avaliar as métricas: como interpretar verificado e não verificado muda radicalmente a abordagem ao Reinforcement Learning. O uso de testes unitários e verificadores matemáticos garante que as respostas técnicas sejam exatas, superando os limites das tradicionais recompensas probabilísticas.

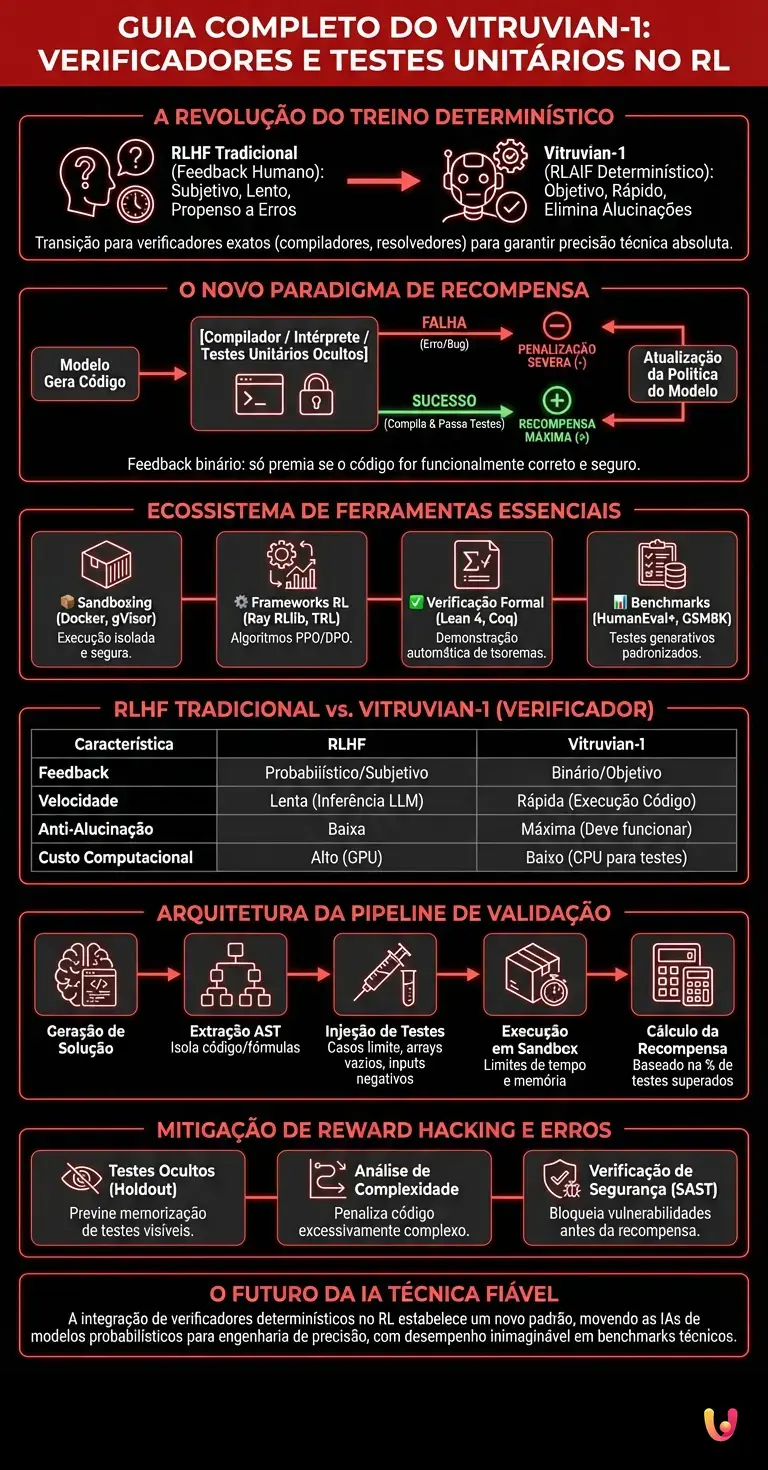

O Reinforcement Learning tradicional aplicado aos LLMs baseou-se historicamente em Reward Models treinados com preferências humanas. No entanto, quando se trata de domínios exatos como a programação ou a matemática avançada, a preferência humana é lenta, dispendiosa e sujeita a erros. O Vitruvian-1 introduz um paradigma baseado em RLAIF (Reinforcement Learning from AI/Algorithmic Feedback), onde o ambiente de RL é constituído por compiladores, intérpretes e resolutores simbólicos (como SymPy ou Lean). Neste ecossistema, o modelo recebe uma recompensa positiva apenas se o código compilar, for executado sem erros e passar numa rigorosa suite de testes unitários ocultos.

Pré-requisitos e Ferramentas de Avaliação

Antes de aprofundar como avaliar as métricas: como interpretar verificado em ambientes complexos, é necessário dominar ferramentas específicas. Os pré-requisitos incluem frameworks de Reinforcement Learning, sandboxes de execução de código e bibliotecas de verificação formal para a matemática avançada.

Para implementar ou compreender totalmente a pipeline de treino de um modelo como o Vitruvian-1, os engenheiros de machine learning devem estar familiarizados com um conjunto de ferramentas altamente especializadas. Segundo a documentação oficial dos modernos frameworks de RL, a infraestrutura requer:

- Ambientes de Sandboxing: Contentores Docker isolados (ex. gVisor) para executar o código gerado pela IA em total segurança, prevenindo ataques de execução de código em modo kernel.

- Frameworks RL: Bibliotecas como Ray RLlib ou TRL (Transformer Reinforcement Learning) configuradas para algoritmos PPO (Proximal Policy Optimization) ou DPO (Direct Preference Optimization).

- Motores de Verificação Formal: Ferramentas como Lean 4 ou Coq para a demonstração automática de teoremas matemáticos gerados pelo modelo.

- Suites de Benchmark: Datasets padronizados como HumanEval+ e GSM8K, estendidos com testes unitários generativos.

O Papel dos Verificadores Determinísticos no Treino

Os verificadores determinísticos são algoritmos que devolvem um feedback binário objetivo. Para avaliar as métricas: como interpretar verificado significa analisar se o código gerado passa nos testes unitários ou se a demonstração matemática respeita os axiomas, eliminando as alucinações do modelo.

Ao contrário dos modelos de recompensa baseados em redes neuronais, que devolvem uma pontuação escalar contínua (ex. 0.85 para uma resposta «boa»), os verificadores determinísticos operam com lógica booleana ou métricas de cobertura de código. Se o Vitruvian-1 gera uma função para ordenar um array, o verificador não avalia o estilo do código, mas a sua correção funcional através de casos limite (edge cases). Esta abordagem previne o fenómeno de sycophancy, onde o modelo tenta agradar ao utilizador humano fornecendo respostas plausíveis mas tecnicamente erradas.

| Característica | Reward Model Tradicional (RLHF) | Verificador Determinístico (Vitruvian-1) |

|---|---|---|

| Natureza do Feedback | Probabilístico / Subjetivo | Binário / Objetivo |

| Velocidade de Inferência | Lenta (requer inferência de um LLM) | Extremamente rápida (execução de código) |

| Resistência às Alucinações | Baixa (pode premiar código que «parece» correto) | Máxima (o código deve funcionar realmente) |

| Custo Computacional | Alto (intensivo em GPU) | Baixo (intensivo em CPU para os testes) |

Arquitetura do Vitruvian-1 para os Testes Unitários

A arquitetura do Vitruvian-1 integra um compilador interno durante a fase de RL. Quando vamos avaliar as métricas: como interpretar verificado traduz-se na execução em tempo real de testes unitários isolados, fornecendo uma recompensa positiva apenas se o output for funcionalmente correto.

O processo de treino do Vitruvian-1 segue uma pipeline rigorosa e automatizada. Quando o modelo gera uma solução técnica, esta não é enviada diretamente para a atualização da política. Pelo contrário, atravessa as seguintes fases:

- Extração da AST (Abstract Syntax Tree): O sistema analisa a resposta do modelo, extraindo apenas os blocos de código executável ou as fórmulas matemáticas, ignorando o texto discursivo.

- Injeção de Testes: O código extraído é concatenado com uma suite de testes unitários (frequentemente gerados dinamicamente através de mutational testing) que cobrem casos padrão, arrays vazios, inputs negativos e limites de memória.

- Execução em Sandbox: O pacote completo é executado num ambiente isolado com limites rigorosos de tempo (timeout) e memória (OOM limits).

- Cálculo da Recompensa (Reward Shaping): O sinal de recompensa é calculado com base na percentagem de testes superados. Uma falha de compilação devolve uma penalização severa (-1.0), enquanto a superação de todos os testes fornece a recompensa máxima (+1.0).

Exemplos Práticos de Validação Matemática

Analisando casos de uso reais, para avaliar as métricas: como interpretar verificado requer o uso de resolutores simbólicos. Se o Vitruvian-1 gera uma equação, o verificador matemático compara-a com a solução esperada, atribuindo a pontuação máxima apenas em caso de equivalência lógica absoluta.

Tomemos como exemplo um problema de cálculo diferencial. Se o prompt pede para calcular a derivada de uma função complexa, o Vitruvian-1 gera os passos e o resultado final. Com base nos dados do setor sobre as arquiteturas de validação, o sistema utiliza bibliotecas como SymPy em Python para verificar o output. O verificador não executa uma simples comparação de strings (que falharia se o modelo escrevesse «x+1» em vez de «1+x»), mas constrói uma árvore matemática. Subtraindo a solução gerada pelo Vitruvian-1 à solução de referência (Ground Truth) e simplificando a expressão, o verificador controla se o resultado é exatamente zero. Apenas neste caso a flag «verificado» é ativada, desencadeando uma atualização positiva dos pesos do modelo através do algoritmo PPO.

Resolução de Problemas Comuns e Falsos Positivos

Durante o treino, podem surgir anomalias nos benchmarks. Para avaliar as métricas: como interpretar verificado de forma correta, é necessário gerir os falsos positivos, como código que passa nos testes unitários mas apresenta vulnerabilidades de segurança ou ineficiências computacionais ocultas.

Um dos problemas mais conhecidos no Reinforcement Learning aplicado ao código é o Reward Hacking. O modelo poderia aprender a superar os testes unitários de formas imprevistas, por exemplo, fazendo hardcoding das respostas se os casos de teste forem previsíveis, ou escrevendo código que consome recursos excessivos embora devolvendo o output correto. Para mitigar estes problemas, a equipa de desenvolvimento do Vitruvian-1 implementa diversas estratégias de troubleshooting:

- Testes Unitários Ocultos (Holdout Tests): O modelo é treinado num conjunto de testes visíveis, mas a recompensa final depende de testes que o modelo nunca viu durante a geração.

- Análise da Complexidade Ciclomática: Além da correção funcional, o verificador penaliza o código excessivamente complexo ou ilegível, promovendo soluções elegantes e pythonic.

- Verificação de Segurança Estática (SAST): Antes de atribuir a recompensa, o código passa por analisadores estáticos que procuram vulnerabilidades comuns (ex. SQL injection ou buffer overflow). Se for detetada uma vulnerabilidade, a flag «verificado» é revogada.

Em Resumo (TL;DR)

O Vitruvian-1 revoluciona o treino dos modelos linguísticos superando o tradicional feedback humano para abraçar uma abordagem baseada em rigorosos verificadores determinísticos.

Este sistema inovador integra testes unitários e resolutores matemáticos no Reinforcement Learning, fornecendo recompensas positivas apenas para outputs perfeitamente funcionais.

Graças a esta arquitetura avançada eliminam-se as alucinações do código, maximizando a total fiabilidade técnica das soluções propostas pela inteligência artificial.

Conclusões

Em síntese, para avaliar as métricas: como interpretar verificado representa o futuro do treino dos modelos linguísticos. A abordagem do Vitruvian-1, baseada em testes unitários e rigor matemático, estabelece um novo padrão para a fiabilidade e a precisão das inteligências artificiais no âmbito técnico.

A integração de verificadores determinísticos no ciclo de Reinforcement Learning marca a passagem definitiva das IA probabilísticas para as IA de engenharia. O Vitruvian-1 demonstra que, fornecendo aos modelos um ambiente onde podem testar, falhar e corrigir o seu próprio código de forma autónoma antes de fornecer a resposta final, é possível atingir níveis de performance nos benchmarks técnicos (como HumanEval e SWE-bench) anteriormente inimagináveis. Compreender e dominar estas métricas de verificação é hoje a competência fundamental para qualquer pessoa que trabalhe no desenvolvimento e na otimização dos Foundation Models de nova geração.

Perguntas frequentes

O Vitruvian-1 transforma a fase de treino das inteligências artificiais integrando verificadores determinísticos e testes unitários no ciclo de Reinforcement Learning. Esta abordagem elimina as alucinações e garante a máxima fiabilidade para a geração de código informático e soluções matemáticas complexas.

O feedback humano resulta frequentemente lento e subjetivo quando se avaliam domínios exatos como a programação. Os verificadores determinísticos oferecem, em vez disso, um feedback binário e objetivo baseado na execução real do código. Este sistema previne respostas apenas aparentemente corretas e assegura que o resultado final funcione realmente sem erros.

O sistema utiliza resolutores simbólicos avançados para comparar a solução gerada com a de referência. Em vez de fazer uma comparação textual banal, o verificador constrói uma árvore matemática e controla a total equivalência lógica entre as duas expressões. O modelo recebe uma recompensa positiva somente se o resultado da subtração entre as duas fórmulas equivaler a zero.

Para evitar que o modelo aprenda a enganar o sistema superando os testes de formas imprevistas, os programadores utilizam testes unitários ocultos e análises da complexidade do código. Além disso, antes de atribuir a recompensa final, o código é submetido a verificações de segurança estáticas para bloquear eventuais ineficiências ou vulnerabilidades informáticas.

Os engenheiros devem dominar ambientes de execução isolados para testar o código em total segurança. São necessários frameworks de Reinforcement Learning para otimizar as políticas e motores de verificação formal para demonstrar os teoremas matemáticos. A estes juntam-se datasets padronizados enriquecidos com testes unitários generativos para avaliar o desempenho global.

Ainda tem dúvidas sobre Guia Completo do Vitruvian-1: Verificadores e Testes Unitários no RL?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Fontes e Aprofundamento

- Aprendizagem por Reforço com Feedback Humano (RLHF) – Wikipedia

- Verificação Formal em Engenharia de Software e Algoritmos – Wikipedia

- Assistente de Demonstração Lean e Verificação Matemática – Wikipedia

- Otimização de Política Proximal (PPO) em Aprendizagem por Reforço – Wikipedia

- gVisor: Isolamento de Contentores e Sandboxing de Código – Wikipedia

- Normas e Avaliação de Confiança em Inteligência Artificial – NIST (EUA)

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.