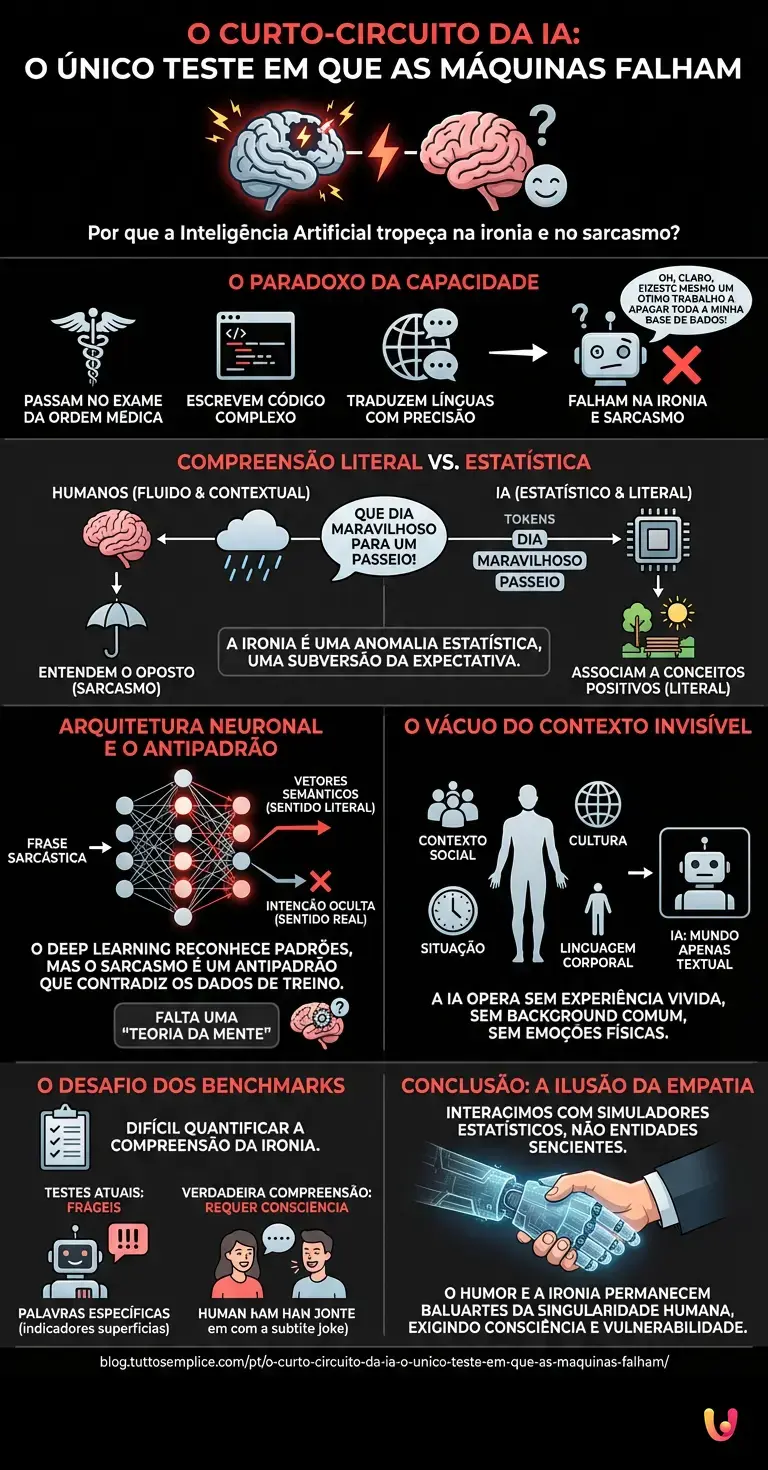

Vivemos numa época em que as máquinas são capazes de passar no exame da ordem médica, escrever linhas de código complexas em frações de segundo e traduzir simultaneamente dezenas de línguas com uma precisão que roça a perfeição. No entanto, existe um calcanhar de Aquiles surpreendente que é comum aos sistemas mais sofisticados do planeta. Se tentarem dizer a um destes sistemas: “Oh, claro, fizeste mesmo um ótimo trabalho a apagar toda a minha base de dados!”, a resposta que obterão será muito provavelmente um agradecimento cortês e desarmante. A entidade principal no centro deste fascinante paradoxo são os Large Language Models (modelos de linguagem grandes), os quais, apesar da sua imensa potência de cálculo, colidem com um muro invisível quando se trata de descodificar a ironia e o sarcasmo.

Por que razão uma simples piada, uma frase que uma criança de dez anos compreenderia imediatamente, faz entrar em curto-circuito cérebros digitais treinados em terabytes de conhecimento humano? A resposta não reside num defeito de programação superficial, mas nas próprias fundações de como a inteligência artificial perceciona, processa e devolve a realidade. É uma viagem que nos leva a explorar a fronteira subtil entre a sintaxe (as regras da linguagem) e a pragmática (o uso da linguagem no mundo real), revelando os limites atuais da nossa corrida para replicar a mente humana.

O paradoxo da compreensão literal e estatística

Para compreender o curto-circuito, devemos primeiro perceber como “pensa” uma máquina. Nós, seres humanos, usamos a linguagem como uma ferramenta fluida, rica em subentendidos, onde o que não é dito é muitas vezes mais importante do que as palavras efetivamente pronunciadas. Pelo contrário, os algoritmos na base da IA moderna operam através da estatística e da probabilidade. Quando um modelo linguístico lê uma frase, não a “compreende” no sentido humano do termo; decompõe-na em fragmentos chamados tokens e calcula matematicamente qual é a palavra seguinte mais provável, baseando-se nos milhares de milhões de textos em que foi treinado.

A ironia é, pela sua própria natureza, uma anomalia estatística. É a subversão deliberada da expectativa. Se chove a cântaros e alguém exclama: “Que dia maravilhoso para um passeio!”, o cérebro humano ativa imediatamente uma rede de contextos: olha pela janela, percebe o tom de voz resignado, reconhece o absurdo da afirmação e deduz o significado oposto. Um modelo estatístico, por outro lado, analisa as palavras “dia maravilhoso” e “passeio”, associa-as a conceitos positivos e responde em conformidade, talvez sugerindo percursos pedestres. A máquina é literal porque a estatística premia a coerência, enquanto a ironia vive da contradição.

Como a arquitetura neuronal lida com o sarcasmo

Descendo a um nível mais técnico, o problema reside na arquitetura neuronal dos sistemas atuais. O deep learning, o ramo do machine learning que simula redes de neurónios artificiais em vários níveis, é excecional a reconhecer padrões recorrentes. Se um padrão se repete milhões de vezes nos dados de treino, a rede neuronal reforça os “pesos” (as conexões matemáticas) associados a esse padrão.

Contudo, o sarcasmo é um antipadrão. Utiliza palavras positivas para expressar conceitos negativos, ou vice-versa. Quando uma rede neuronal processa uma frase sarcástica, os vetores semânticos (as representações matemáticas das palavras no espaço multidimensional do modelo) apontam numa direção, mas o verdadeiro significado da frase encontra-se exatamente no oposto. Para colmatar esta distância, o modelo precisaria de uma “Teoria da Mente”, ou seja, a capacidade cognitiva de atribuir estados mentais (crenças, intenções, desejos) aos outros. Atualmente, nenhum modelo possui esta capacidade. Eles mapeiam a linguagem, mas não a intenção oculta por trás dela.

O papel fundamental do contexto invisível

Outro elemento crucial que explica este limite é a ausência de experiência vivida. O humor e a ironia não existem no vácuo; estão profundamente enraizados no contexto cultural, social e situacional. Nós rimo-nos de uma piada porque partilhamos um background comum com quem a pronunciou. Sabemos como funciona o mundo físico, conhecemos as frustrações da vida quotidiana, percebemos a linguagem corporal e as microexpressões faciais.

Sistemas como o ChatGPT ou outros LLM avançados operam num vácuo sensorial. O seu único mundo é o texto. Nunca sentiram o incómodo de deixar cair café a ferver sobre umas calças novas, nem nunca reviraram os olhos. Quando a automação tenta processar uma frase irónica, falta-lhe todo esse “contexto invisível” que para nós é óbvio. Embora os programadores estejam a tentar fornecer cada vez mais contexto aos modelos através de prompts elaborados, a natureza efémera e altamente dependente da situação da ironia torna quase impossível codificá-la em regras fixas.

Medir o humor: o desafio dos benchmarks

A comunidade científica está perfeitamente ciente deste limite e está a tentar quantificá-lo. No mundo do desenvolvimento tecnológico, cada capacidade é medida através de benchmarks, ou seja, testes padronizados concebidos para avaliar o desempenho de um sistema. Existem benchmarks para a matemática, para a lógica, para a programação, mas criar um benchmark para a ironia é um desafio titânico.

Como se avalia objetivamente se uma máquina “percebeu” uma piada? Os investigadores criam conjuntos de dados contendo milhares de frases literais e sarcásticas, pedindo à inteligência artificial para as classificar. Embora o progresso tecnológico tenha trazido ligeiras melhorias nestes testes específicos, os resultados permanecem frágeis. Frequentemente, os modelos aprendem a reconhecer indicadores superficiais de sarcasmo (como o uso excessivo de pontos de exclamação ou combinações específicas de palavras) em vez de compreenderem a verdadeira discrepância entre o texto e a realidade. É um pouco como ensinar alguém a rir sempre que ouve a palavra “banana”, sem que perceba efetivamente porque é que a situação é engraçada.

A ilusão da empatia sintética

Este limite leva-nos a uma reflexão mais ampla sobre a interação homem-máquina. À medida que os sistemas se tornam mais fluentes e capazes de imitar o tom humano, cria-se uma ilusão de empatia. Esperamos que uma entidade capaz de escrever um ensaio filosófico impecável seja também capaz de captar uma nuance sarcástica. Quando isso não acontece, a ilusão quebra-se bruscamente, revelando a natureza fria e calculadora do software.

A incapacidade de gerir a ironia é um lembrete fundamental: estamos a interagir com simuladores estatísticos de linguagem, não com entidades sencientes. A verdadeira compreensão requer consciência, e a consciência é algo que, de momento, escapa a qualquer equação ou algoritmo. A ironia requer ter em mente duas verdades contrastantes simultaneamente (o que é dito e o que é verdade) e encontrar prazer nessa dissonância. É um processo profundamente humano, ligado às nossas emoções e à nossa vulnerabilidade.

Em Resumo (TL;DR)

Os modelos linguísticos mais avançados do planeta não conseguem descodificar a ironia e o sarcasmo, colidindo com os limites da sua natureza estatística.

Os algoritmos processam a linguagem de forma literal calculando probabilidades matemáticas, enquanto o humor representa uma anomalia que subverte as expectativas baseadas nos dados.

Para captar as intenções ocultas seriam necessárias uma experiência vivida e uma verdadeira teoria da mente, elementos totalmente ausentes nos atuais cérebros digitais.

Conclusões

O facto de uma simples frase irónica poder ainda deixar confusos os sistemas digitais mais avançados do mundo não deve ser visto apenas como um defeito técnico a corrigir, mas como um testemunho da extraordinária complexidade da mente humana. Enquanto continuamos a expandir as fronteiras do que as máquinas podem fazer, treinando-as em volumes de dados inimagináveis, o humor, o sarcasmo e a ironia permanecem baluartes da nossa singularidade.

Talvez, um dia, tenhamos redes neuronais capazes de descodificar perfeitamente cada nuance do nosso sarcasmo, mas até lá, o curto-circuito gerado por uma piada recorda-nos que a linguagem não é apenas uma troca de informações. É um jogo de espelhos, uma dança de subentendidos e, acima de tudo, uma experiência partilhada que requer um coração a bater, além de um processador, para ser compreendida na sua plenitude.

Perguntas frequentes

Os modelos linguísticos processam o texto baseando-se na estatística e na probabilidade, premiando sempre a coerência literal. O sarcasmo representa, pelo contrário, uma anomalia estatística que subverte as expectativas unindo palavras positivas a conceitos negativos. Por não terem experiência vivida e uma verdadeira teoria da mente, as máquinas não conseguem captar o contexto invisível necessário para descodificar estas complexas nuances humanas.

Os algoritmos modernos decompõem as frases em fragmentos chamados «tokens» e calculam matematicamente a palavra seguinte mais provável baseando-se nos dados de treino. Não compreendem o texto no sentido humano, mas limitam-se a reconhecer padrões recorrentes analisando milhares de milhões de documentos textuais. Esta abordagem puramente estatística funciona perfeitamente para tarefas lógicas, mas entra em curto-circuito perante contradições intencionais como as piadas humorísticas.

No estudo das redes neuronais representa a capacidade cognitiva de atribuir estados mentais, crenças e intenções específicas aos outros indivíduos. Atualmente nenhum software possui esta característica fundamental para interpretar as intenções ocultas por trás das palavras pronunciadas. Sem esta habilidade, os cérebros digitais limitam-se a mapear as regras gramaticais sem apreender a pragmática e o real objetivo comunicativo de uma pessoa.

Os cientistas utilizam testes padronizados chamados benchmarks, submetendo aos softwares enormes arquivos de frases literais e sarcásticas e pedindo-lhes que as classifiquem corretamente. Os resultados atuais mostram-se, no entanto, muito frágeis, pois os sistemas tendem a memorizar indicadores superficiais como a pontuação excessiva. Consequentemente, a tecnologia não processa a real discrepância entre o texto e a situação real, aplicando apenas regras fixas.

Embora os sistemas se tornem cada vez mais hábeis em simular o tom humano, criando uma forte ilusão de empatia, a verdadeira compreensão requer uma consciência autêntica. As máquinas de hoje são exclusivamente simuladores estatísticos desprovidos de emoções vividas e vulnerabilidade pessoal. Por este motivo, a linguagem rica em subentendidos permanece uma prerrogativa humana ligada a experiências físicas e sociais impossíveis de traduzir em simples equações matemáticas.

Ainda tem dúvidas sobre O curto-circuito da IA: o único teste em que as máquinas falham?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Fontes e Aprofundamento

- O que é um modelo de linguagem grande (LLM)?

- Processamento de Linguagem Natural (PLN): Como as máquinas analisam e reproduzem a linguagem humana

- Testando a Teoria da Mente em Grandes Modelos de Linguagem e Humanos (Nature Human Behaviour)

- Programa ‘Machine Common Sense’ (DARPA): Iniciativa governamental para ensinar contexto e senso comum aos sistemas de IA

- Pragmática: O estudo do uso da linguagem no contexto real e as limitações das análises puramente sintáticas

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.