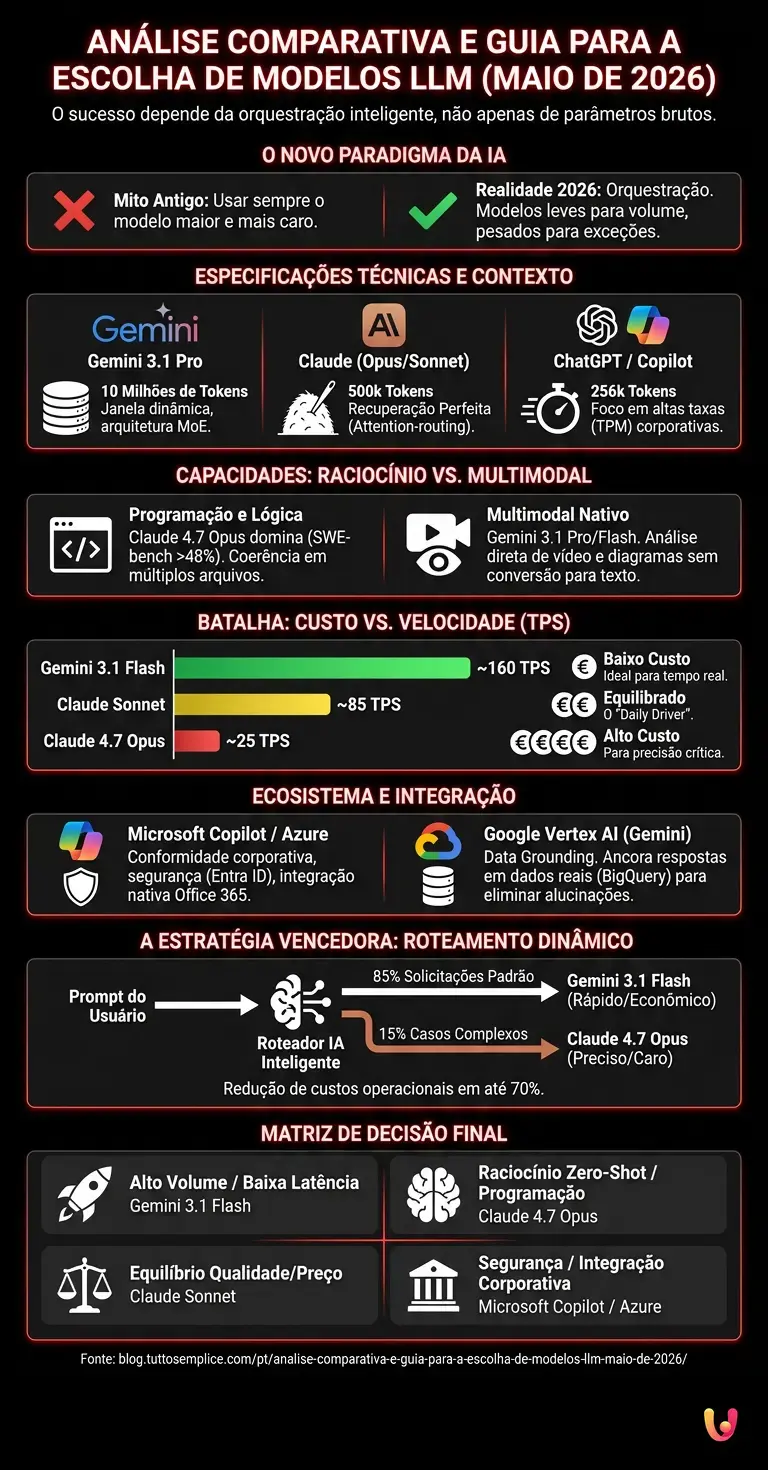

O mito mais arraigado no cenário atual da inteligência artificial é que, para obter desempenho de nível empresarial, é indispensável adotar o modelo mais robusto e custoso disponível. A verdade, em maio de 2026, é diametralmente oposta: o sucesso em produção não depende da pontuação em benchmarks de raciocínio, mas sim da orquestração inteligente entre modelos leves para alto volume e modelos pesados para exceções. Esta comparação de modelos de LLM demonstra como o ecossistema, o *vendor lock-in* e a latência contam, atualmente, muito mais do que os parâmetros brutos, impondo aos CTOs uma mudança radical de paradigma no projeto de arquiteturas de IA.

Especificações Técnicas e Arquiteturas Básicas

Nesta comparação de modelos de LLM , as especificações técnicas revelam divergências cruciais. Analisamos as dimensões da janela de contexto, os limites de taxa (RPM/TPM) e as peculiaridades arquiteturais que definem as capacidades do Claude, Gemini, ChatGPT e Copilot em cenários de produção intensiva.

Em maio de 2026, a corrida pela expansão da janela de contexto atingiu um patamar funcional, deslocando o foco para a eficiência da recuperação de informações (Retrieval-Augmented Generation nativa). De acordo com a documentação oficial do Google Cloud, o Gemini 3.1 Pro mantém a liderança absoluta com uma janela de contexto dinâmica de até 10 milhões de tokens, suportada por uma arquitetura Mixture-of-Experts (MoE) altamente paralelizada. Isso permite a ingestão de repositórios de código inteiros ou arquivos de vídeo sem fragmentação.

Por outro lado, o Claude 4.7 Opus e a iteração mais recente do Claude Sonnet estabelecem-se em uma janela de 500.000 tokens. No entanto, a Anthropic implementou um mecanismo de *attention-routing* que garante uma recuperação perfeita (100% no teste *Needle-in-a-Haystack*), mesmo nos limites extremos do contexto, reduzindo as alucinações estruturais. O ChatGPT (em sua versão empresarial baseada na arquitetura GPT-4.5/5 ) e o Microsoft Copilot oferecem janelas padronizadas de 256.000 tokens, priorizando limites de taxa (TPM – *Tokens Per Minute*) extremamente elevados para atender às cargas de trabalho corporativas simultâneas.

Capacidades Multimodais e Raciocínio Complexo

Avaliar o raciocínio complexo é fundamental em uma comparação atualizada de modelos LLM . Examinamos o desempenho nos benchmarks mais recentes para programação avançada , lógica matemática *zero-shot* e análise nativa de imagens e documentos complexos.

As capacidades de raciocínio bifurcaram-se em duas categorias distintas: lógica analítica (programação e matemática) e compreensão multimodal nativa. No domínio do desenvolvimento de software, o Claude 4.7 Opus domina de forma incontestável. Nos benchmarks SWE-bench atualizados em 2026, o Opus resolve autonomamente mais de 48% das *issues* complexas do GitHub, superando o ChatGPT graças à sua capacidade superior de manter a coerência lógica em múltiplos arquivos.

No que diz respeito à multimodalidade, o Gemini 3.1 Pro e o Gemini 3.1 Flash operam com uma arquitetura nativamente multimodal desde o pré-treinamento. Isso significa que eles não traduzem imagens ou áudio em texto antes do processamento, mas mapeiam os pixels e as frequências diretamente no espaço latente. O resultado é uma superioridade avassaladora na análise de vídeos em tempo real e na leitura de plantas ou diagramas industriais complexos. O Microsoft Copilot , integrado ao ecossistema Office 365, destaca-se, por sua vez, no raciocínio documental, cruzando dados entre Excel, Word e Teams com uma precisão semântica inigualável para tarefas administrativas.

Latência, Velocidade de Inferência e Custos Operacionais

A otimização do orçamento exige uma comparação criteriosa dos modelos de LLM, baseada nos custos por milhão de tokens e na latência. Vamos descobrir quais modelos oferecem a melhor relação entre Tokens por Segundo (TPS) e gastos com infraestrutura para as empresas.

O verdadeiro campo de batalha de 2026 é a eficiência econômica. Os modelos "Frontier" (Opus, GPT de nível máximo) são insustentáveis para tarefas de alto volume, como a classificação de logs ou o atendimento ao cliente de primeiro nível. É aqui que entram em cena os modelos otimizados .

| Modelo de LLM | Custo de Input (por 1M) | Custo de Saída (por 1M) | Velocidade (TPS) |

|---|---|---|---|

| Claude 4.7 Opus | 15,00 € | 75,00 € | ~25 |

| Claude Sonnet | 3,00 € | 15,00 € | ~85 |

| Gemini 3.1 Pro | 5,00 € | 15,00 € | ~60 |

| Gemini 3.1 Flash | 0,35 € | 1,05 € | ~160 |

| ChatGPT (Empresarial) | 10,00 € | 30,00 € | ~45 |

De acordo com a documentação oficial do Google, o Gemini 3.1 Flash oferece uma velocidade de inferência de cerca de 160 tokens por segundo (TPS), tornando-o ideal para aplicações em tempo real e agentes de voz. O Claude Sonnet posiciona-se como o melhor equilíbrio do mercado: oferece capacidades de raciocínio próximas às dos modelos topo de linha de 2025, mas a um quinto do custo do Opus e com uma latência imperceptível para o usuário final.

Integração, Ecossistema e Plataformas em Nuvem

Nenhuma comparação de modelos de LLM está completa sem analisar o *vendor lock-in* e a infraestrutura. Comparamos as vantagens das APIs da Anthropic e da OpenAI com plataformas corporativas integradas, como o Google Cloud Vertex AI e o Microsoft Azure.

A escolha do modelo está intrinsecamente ligada à infraestrutura de nuvem preexistente da empresa. O Microsoft Copilot e os modelos da OpenAI via Azure oferecem a vantagem inigualável da conformidade corporativa (HIPAA, GDPR rigoroso) e da integração nativa com o Entra ID (antigo Azure AD) para o gerenciamento de permissões em nível de documento individual. Se uma empresa já utiliza o ecossistema Microsoft, a adoção do Azure OpenAI reduz o tempo de *go-to-market* em 60%.

O Gemini 3.1 no Google Cloud Vertex AI se destaca no Data Grounding . Ele permite ancorar as respostas do modelo diretamente aos bancos de dados corporativos (BigQuery, AlloyDB) e à Pesquisa Google em tempo real, eliminando, na prática, as alucinações em dados proprietários. A Anthropic , embora não possua uma nuvem própria, adotou uma estratégia agnóstica: as APIs do Claude estão disponíveis no AWS Bedrock e no Google Cloud, oferecendo máxima flexibilidade para arquiteturas multi-cloud.

Estudo de Caso: A evolução do Atendimento ao Cliente (2024-2026)

Em 2024, a Klarna ganhou as manchetes ao gerenciar 2,3 milhões de conversas (dois terços do total) com um assistente de IA baseado na OpenAI, reduzindo o tempo de resolução de 11 para 2 minutos e estimando uma economia de 40 milhões de dólares. Em maio de 2026, as empresas líderes evoluíram essa abordagem implementando o *Dynamic Model Routing *. Em vez de utilizar um único modelo pesado, um roteador de IA analisa a intenção do usuário em milissegundos: 85% das solicitações padrão são gerenciadas pelo Gemini 3.1 Flash (custo quase zero, latência instantânea), enquanto apenas 15% dos casos complexos (ex.: disputas legais ou reembolsos atípicos) são encaminhados para o Claude 4.7 Opus. Essa abordagem híbrida reduziu ainda mais os custos operacionais em 70% em comparação com 2024, mantendo a satisfação do cliente inalterada.

Conclusões

Para concluir esta comparação de modelos de LLM , apresentamos a matriz de decisão definitiva. A escolha do modelo ideal depende do equilíbrio entre o volume de chamadas, a necessidade de raciocínio *zero-shot* e os requisitos de integração empresarial.

Não existe um vencedor absoluto, mas existem escolhas ideais de acordo com o cenário de utilização:

- Tarefas de alto volume e baixa latência (Chatbots, Triagem, Extração Básica de Dados): O vencedor indiscutível é o Gemini 3.1 Flash . O custo irrisório e a velocidade extrema o tornam o único candidato lógico para operações em larga escala.

- Raciocínio Zero-Shot extremo e programação complexa: o Claude 4.7 Opus permanece como o padrão ouro. É o investimento necessário quando a precisão lógica é crítica e erros humanos ou de máquina acarretariam custos elevados.

- Equilíbrio Qualidade/Preço (O "Daily Driver"): O Claude Sonnet representa o ponto de equilíbrio perfeito para 80% das aplicações empresariais que exigem boa inteligência sem esgotar o orçamento de API.

- Integração Corporativa e Segurança Documental: O Microsoft Copilot e o ecossistema ChatGPT no Azure destacam-se pela facilidade de implantação em ambientes corporativos altamente regulamentados.

A estratégia vencedora para 2026 não é escolher um único modelo, mas construir uma arquitetura de roteamento que direcione dinamicamente cada prompt para o modelo mais eficiente para aquela tarefa específica.

Perguntas frequentes

Para o desenvolvimento de software e o raciocínio lógico avançado, o Claude 4.7 Opus representa o padrão de referência. Graças à sua excepcional capacidade de manter a coerência em múltiplos arquivos, ele resolve problemas complexos de forma autônoma, superando as alternativas disponíveis no mercado. É a ferramenta ideal quando a precisão do código é fundamental para o projeto.

A estratégia mais eficaz consiste na criação de um sistema de roteamento dinâmico de solicitações. Em vez de utilizar um único modelo de alto custo para cada operação, um roteador inteligente analisa o objetivo do prompt e encaminha as tarefas simples para soluções econômicas, como o Gemini 3.1 Flash. As operações complexas são direcionadas para modelos avançados, reduzindo drasticamente os custos da empresa.

O Gemini 3.1 Pro domina este setor graças a uma janela dinâmica que atinge dez milhões de tokens, permitindo analisar arquivos inteiros sem fragmentação. No entanto, o Claude 4.7 Opus e o Sonnet garantem uma recuperação perfeita das informações, mesmo nos limites de seu contexto, reduzindo ao mínimo as alucinações estruturais durante a leitura de textos extensos.

Escolher o sistema Microsoft oferece vantagens enormes em termos de conformidade normativa e segurança dos dados corporativos. Esta solução garante uma integração nativa para o gerenciamento de permissões em documentos individuais. Portanto, mostra-se a escolha ideal para corporações altamente regulamentadas que necessitam de um controle rigoroso sobre os acessos e as informações sensíveis.

As versões Pro e Flash do Gemini operam com uma arquitetura nativamente multimodal desde a fase de treinamento básico. Isso significa que elas não precisam traduzir conteúdos visuais ou de áudio em texto antes de processá-los, mas sim mapeiam os dados diretamente. O resultado é uma precisão altíssima na compreensão de vídeos em tempo real e diagramas industriais complexos.

Ainda tem dúvidas sobre Análise Comparativa e Guia para a Escolha de Modelos LLM (Maio de 2026)?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Fontes e Aprofundamento

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.