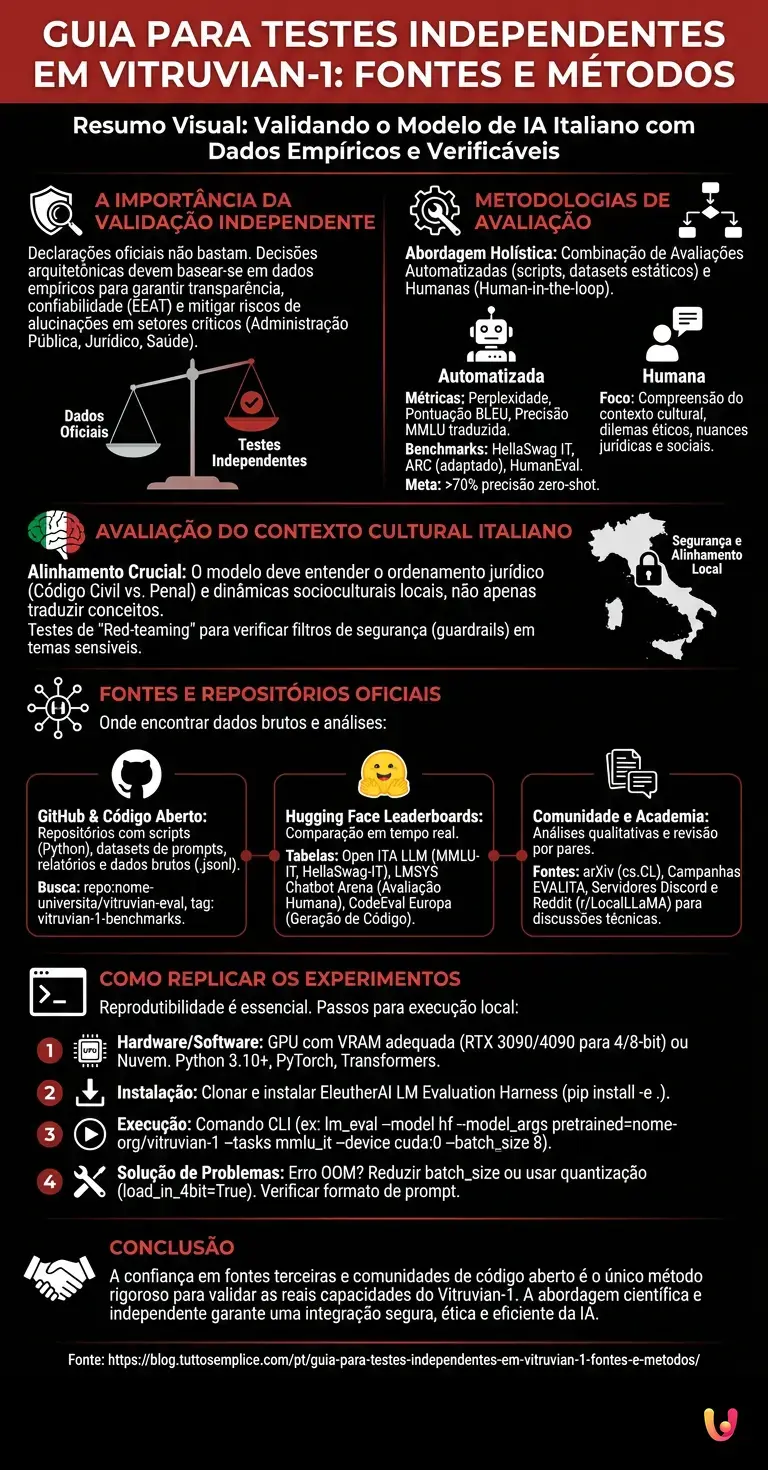

O ecossistema da inteligência artificial viu o surgimento do Vitruvian-1 como um dos modelos fundacionais mais promissores no cenário europeu e italiano . No entanto, para desenvolvedores, pesquisadores e empresas do setor de informática, as declarações oficiais dos criadores do software não são suficientes. É essencial basear as decisões arquitetônicas em dados empíricos e verificáveis. Este guia técnico explora em detalhes onde encontrar, como interpretar e de que forma replicar as evidências científicas e os benchmarks de terceiros relacionados a este modelo de linguagem.

A importância da validação para os modelos de IA italianos

Para avaliar as capacidades reais do modelo, é fundamental analisar os testes independentes vitruvian-1 . Esses exames imparciais, conduzidos pela comunidade científica, permitem medir o desempenho do software fora dos ambientes de desenvolvimento oficiais, garantindo transparência e confiabilidade.

No contexto da ciência da computação moderna, o ganho de informação proveniente de fontes não afiliadas é o pilar do EEAT (Experiência, Autoridade, Confiabilidade, Transparência). De acordo com dados do setor atualizados para 2026, os modelos de linguagem de grande porte (LLMs) treinados em corpora específicos por idioma, como o italiano, tendem a apresentar vieses ou limitações que os benchmarks generalistas em inglês têm dificuldade em capturar. A dependência de avaliações externas significa mitigar o risco de alucinações em ambientes de produção críticos , como a administração pública, o setor jurídico ou o setor médico-sanitário.

Metodologias de avaliação para Vitruvian-1

As metodologias aplicadas nos testes independentes vitruvian-1 baseiam-se em frameworks padronizados para o Processamento de Linguagem Natural. Os pesquisadores utilizam conjuntos de dados específicos para a língua italiana, medindo não apenas a correção sintática, mas também a compreensão do contexto cultural e normativo.

A avaliação de um modelo de IA não é um processo monolítico. As metodologias recomendadas pela comunidade de código aberto dividem-se em avaliações automatizadas (baseadas em scripts e conjuntos de dados estáticos) e avaliações humanas (Human-in-the-loop). Ambos os abordagens são necessárias para obter uma visão holística do comportamento do software.

Métricas padrão e benchmarks linguísticos

Ao analisar os testes independentes vitruvian-1 , as métricas mais utilizadas incluem a perplexidade, a pontuação BLEU e a precisão em tarefas MMLU traduzidas. Esses indicadores quantitativos oferecem uma visão objetiva das capacidades de raciocínio do software em comparação com outros modelos concorrentes.

Pesquisadores independentes utilizam conjuntos de avaliação rigorosos. Entre os testes mais frequentes, encontramos o HellaSwag IT (para completamento lógico de frases), o ARC (AI2 Reasoning Challenge) adaptado para o italiano, e benchmarks específicos para programação como o HumanEval. De acordo com a documentação oficial dos principais frameworks de teste, superar a marca de 70% de precisão nesses testes em modo zero-shot é um indicativo de um modelo de alto desempenho.

Avaliação do contexto cultural italiano

Um aspeto crucial dos testes independentes vitruvian-1 diz respeito ao alinhamento cultural. Os avaliadores independentes testam o software em dilemas éticos locais, jurisprudência italiana e idiomas regionais, garantindo que a inteligência artificial não se limite a traduzir conceitos anglo-saxónicos.

Ao contrário dos modelos globais, uma IA desenvolvida com foco na Itália deve compreender as nuances do nosso ordenamento jurídico (por exemplo, a diferença entre o Código Civil e o Código Penal) e as dinâmicas socioculturais. Os repositórios acadêmicos frequentemente incluem conjuntos de dados de “red-teaming” projetados especificamente para forçar o modelo a gerar respostas sobre temas sensíveis italianos, verificando assim a eficácia de seus filtros de segurança (guardrails).

Repositórios oficiais e plataformas de compartilhamento

Os resultados dos testes independentes vitruvian-1 são publicados regularmente em repositórios públicos e plataformas de aprendizado de máquina. O acesso a esses bancos de dados permite que os desenvolvedores consultem os registros originais, baixem os pesos do modelo e verifiquem a reprodutibilidade dos experimentos.

Para quem busca evidências concretas, a internet oferece hubs específicos onde a transparência é a regra. Não basta ler um artigo resumido; um verdadeiro profissional de TI deve analisar os dados brutos.

Plataformas de código aberto e GitHub

No GitHub, é possível encontrar vários repositórios dedicados aos testes independentes vitruvian-1 . Os pesquisadores carregam scripts de avaliação em Python, conjuntos de dados de prompts e relatórios detalhados, facilitando a colaboração e a identificação de possíveis vieses ou alucinações do software.

Para encontrar esses recursos, recomenda-se usar consultas de pesquisa avançadas no GitHub, como repo:nome-universita/vitruvian-eval , ou procurar tags específicas como vitruvian-1-benchmarks . Dentro desses repositórios, os arquivos fundamentais a serem analisados são os requirements.txt (para entender o ambiente de teste) e os arquivos .jsonl que contêm as saídas geradas pelo modelo durante as sessões de inferência.

Hugging Face e leaderboards independentes

A plataforma Hugging Face hospeda diversos leaderboards onde os testes independentes vitruvian-1 são comparados em tempo real. As seções dedicadas aos modelos fundacionais italianos mostram as pontuações agregadas, permitindo filtrar os resultados com base em tarefas específicas de processamento de linguagem.

Hugging Face representa o padrão de facto para o compartilhamento de modelos e conjuntos de dados. Abaixo, uma tabela resumindo os principais tipos de leaderboards onde é possível encontrar dados sobre o Vitruvian-1:

| Nome da Tabela de Classificação | Foco Principal | Métricas-chave | Frequência de Atualização |

|---|---|---|---|

| Tabela de Classificação do Open ITA LLM | Modelos em língua italiana | MMLU-IT, HellaSwag-IT, RAG | Semanal |

| Arena de Chatbots LMSYS (IT) | Avaliação humana (classificação Elo) | Teste A/B cego | Diária |

| CodeEval Europa | Geração de código-fonte | Pass@1, Pass@10 (Python, C++) | Mensal |

Comunidade e fóruns de pesquisa acadêmica

Para discutir os testes independentes Vitruvian-1 , os pesquisadores reúnem-se em comunidades especializadas e fóruns acadêmicos. Plataformas como o arXiv para artigos científicos e servidores Discord dedicados à IA italiana representam as fontes primárias para obter análises qualitativas e revisões por pares.

Além dos dados quantitativos, a análise qualitativa é indispensável. As comunidades oferecem um contexto valioso para interpretar os números. Eis os canais recomendados:

- arXiv.org: Pesquisando “Vitruvian-1” na seção

cs.CL(Computação e Linguagem), é possível acessar pré-publicações acadêmicas que analisam a arquitetura e o desempenho do modelo com rigor científico. - Campanhas EVALITA: A iniciativa italiana para a avaliação de tecnologias da linguagem falada e escrita é uma referência. Os relatórios dos participantes frequentemente incluem testes em modelos de ponta.

- Servidores Discord e Reddit: Comunidades como

r/LocalLLaMAou servidores Discord de desenvolvedores italianos de IA hospedam discussões técnicas sobre como otimizar a quantização do modelo e os resultados obtidos em hardware de consumo.

Como replicar os experimentos em seu próprio hardware

A replicação dos testes independentes vitruvian-1 requer um ambiente de software configurado corretamente e recursos de hardware adequados. Utilizando frameworks como o LM Evaluation Harness, os desenvolvedores podem executar os benchmarks localmente, validando em primeira mão as métricas declaradas pela comunidade.

A verdadeira essência do Information Gain na área da informática é a reprodutibilidade. Eis os passos fundamentais para executar os testes de forma autónoma:

1. Pré-requisitos de Hardware e Software: É necessária uma GPU com VRAM adequada (por exemplo, NVIDIA RTX 3090/4090 para modelos quantizados em 4 bits ou 8 bits) ou acesso a um cluster de nuvem. Do lado do software, é indispensável Python 3.10+, PyTorch e a biblioteca Transformers atualizada.

2. Instalação do Framework de Avaliação: A ferramenta mais credenciada é o EleutherAI LM Evaluation Harness . A instalação é feita clonando o repositório oficial e executando pip install -e . dentro do ambiente virtual.

3. Execução do Teste: Através da linha de comando, é possível iniciar a avaliação especificando o modelo e as tarefas desejadas. Um exemplo de comando padrão é:

lm_eval --model hf --model_args pretrained=nome-org/vitruvian-1 --tasks mmlu_it --device cuda:0 --batch_size 8

Resolução de problemas: Se ocorrer um erro de falta de memória (OOM) durante a execução, recomenda-se reduzir o batch_size para 1 ou 2, ou usar técnicas de quantização adicionando o argumento load_in_4bit=True aos parâmetros do modelo. Se os resultados diferirem drasticamente dos oficiais, verifique se o modelo de prompt usado pela estrutura corresponde exatamente ao usado no treinamento do Vitruvian-1 (por exemplo, ChatML ou formatos personalizados).

Em Resumo (TL;DR)

A confiança em testes independentes do modelo Vitruvian-1 é fundamental para garantir transparência e decisões baseadas em dados empíricos verificáveis.

Os pesquisadores medem o desempenho por meio de métricas padronizadas, avaliando também a compreensão profunda do contexto normativo e cultural italiano.

Desenvolvedores e profissionais podem consultar os resultados em plataformas de código aberto como o GitHub para verificar a reprodutibilidade dos experimentos.

Conclusões

Em resumo, a busca por testes independentes do Vitruvian-1 exige a exploração de repositórios GitHub, leaderboards no Hugging Face e artigos acadêmicos. A confiança em fontes terceiras e comunidades de código aberto é o único método rigoroso para validar as reais capacidades deste software italiano.

A adoção de modelos linguísticos avançados não pode prescindir de uma fase de auditoria técnica aprofundada. Como vimos, os recursos disponíveis para os desenvolvedores em 2026 são vastos e altamente especializados. Seja consultando métricas em um leaderboard ou executando scripts de validação em seu próprio servidor corporativo , a abordagem científica e independente continua sendo a melhor garantia para integrar a inteligência artificial de forma segura, ética e eficiente.

Perguntas frequentes

Os resultados das avaliações imparciais podem ser facilmente encontrados em plataformas colaborativas de código aberto como GitHub e Hugging Face. Ao consultar os leaderboards específicos para modelos de linguagem italianos, os desenvolvedores podem analisar os dados brutos, comparar as métricas de desempenho e verificar a validade dos experimentos conduzidos pela comunidade científica independente.

Uma avaliação cultural precisa garante que o modelo compreenda as especificidades do nosso país, como o ordenamento jurídico e as dinâmicas sociais, sem se limitar a traduzir conceitos anglo-saxónicos. Essa abordagem reduz o risco de respostas inadequadas e garante que o software seja seguro e confiável para uso em setores críticos, como a administração pública.

Para executar as avaliações de forma independente, é necessário ter uma placa de vídeo com memória adequada e instalar frameworks específicos dedicados ao teste de modelos de linguagem. Através da linha de comando, é possível iniciar os scripts de avaliação nos conjuntos de dados desejados, verificando pessoalmente as métricas declaradas e garantindo a total reprodutibilidade dos experimentos.

Os pesquisadores medem as capacidades do software analisando indicadores quantitativos objetivos, incluindo a perplexidade e a precisão em tarefas específicas traduzidas para o italiano. A superação do limiar de setenta por cento de precisão no modo zero-shot nesses exames padronizados indica um nível de raciocínio lógico e linguístico altamente competitivo.

Se o sistema esgotar a memória disponível durante as sessões de inferência, recomenda-se reduzir o tamanho do lote de processamento para valores mínimos. Alternativamente, é possível aplicar técnicas de quantização de quatro ou oito bits para aliviar a carga computacional no hardware, mantendo ainda um excelente nível de precisão nos resultados finais.

Ainda tem dúvidas sobre Guia para testes independentes em Vitruvian-1: fontes e métodos?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Fontes e Aprofundamento

- Quadro Regulamentar Europeu para a Inteligência Artificial (Comissão Europeia)

- Estrutura de Gerenciamento de Risco de Inteligência Artificial (NIST – Governo dos EUA)

- Métrica BLEU para avaliação de processamento de linguagem natural (Wikipedia)

- O que é um modelo de linguagem grande (LLM)? – Amazon Web Services

- Benchmark MMLU (Massive Multitask Language Understanding) para avaliação de IA (Wikipedia)

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.