A integração do NIST AI RMF (Quadro de Gestão de Riscos de Inteligência Artificial) representa hoje o pilar fundamental para qualquer organização que deseje desenvolver, adquirir ou integrar sistemas de inteligência artificial. No contexto tecnológico de 2026, caracterizado pela plena operacionalidade da Lei de IA da UE e pela proliferação de modelos generativos complexos , a gestão de riscos deixou de ser uma opção, tornando-se um imperativo estratégico. Este guia técnico fornece um caminho estruturado para a adoção do framework, transformando a conformidade regulatória em uma vantagem competitiva tangível por meio de uma sólida governança de IA .

Introdução à Gestão de Riscos de IA

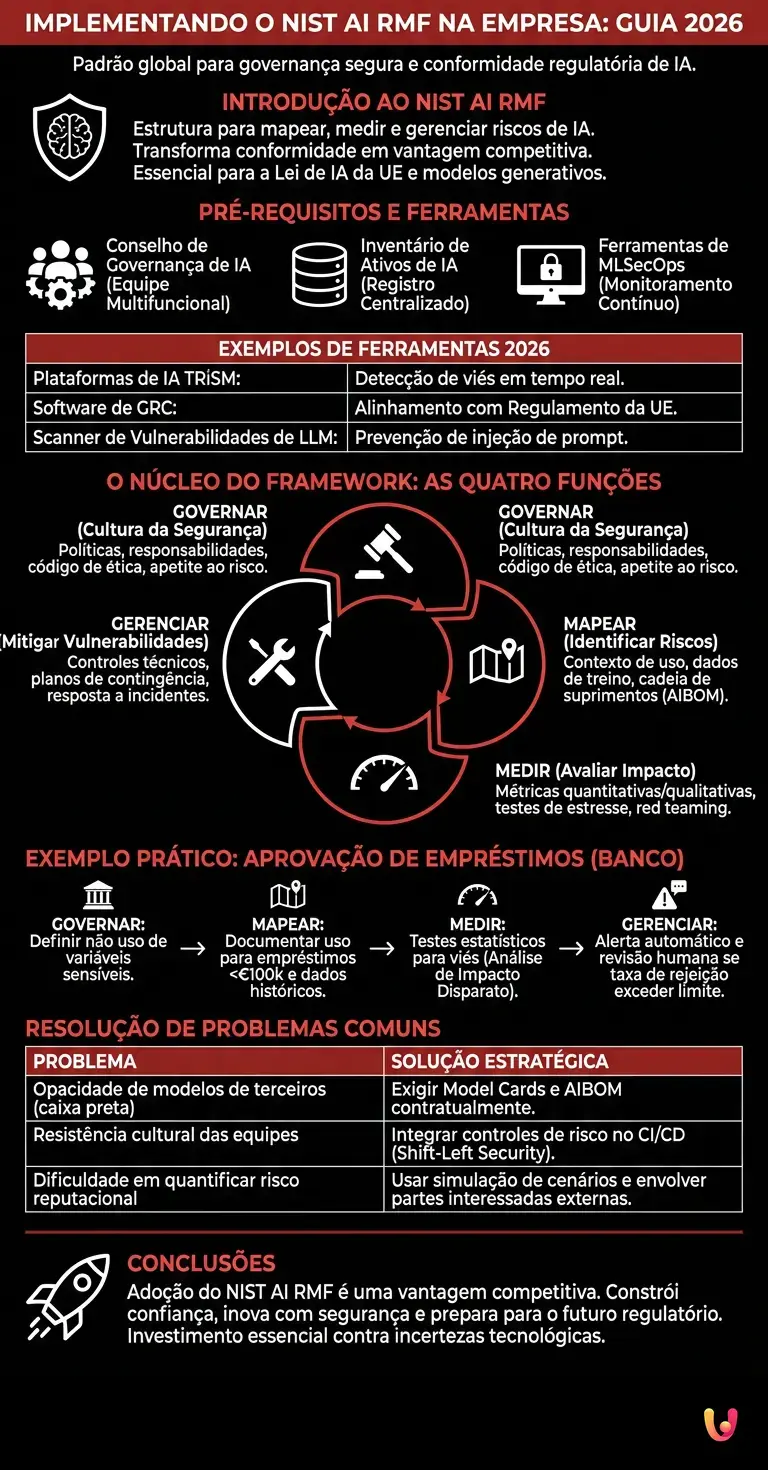

A adoção do NIST AI RMF representa o padrão global em 2026 para governar a inteligência artificial de forma segura. Essa estrutura permite que as empresas mapeiem, meçam e gerenciem os riscos relacionados à IA, garantindo a conformidade regulatória e a confiabilidade dos sistemas tecnológicos.

De acordo com a documentação oficial do National Institute of Standards and Technology (NIST), a estrutura foi projetada para ser independente do setor e escalável. Não se trata de uma simples lista de verificação de segurança, mas de uma mudança cultural que envolve toda a estrutura empresarial, desde o conselho de administração até os desenvolvedores de machine learning. Em 2026, o alinhamento entre o NIST RMF tradicional e as especificidades da inteligência artificial exige uma compreensão profunda de conceitos como a interpretabilidade dos modelos, a privacidade dos dados de treinamento e a mitigação de vieses algorítmicos.

Pré-requisitos e Ferramentas para a Conformidade

Antes de implementar o NIST AI RMF , é fundamental estabelecer uma governança corporativa de IA sólida. Os pré-requisitos incluem a formação de um comitê de ética multidisciplinar, a adoção de software para auditoria algorítmica e o mapeamento da infraestrutura de dados existente.

Para iniciar o processo com sucesso, as organizações precisam de um ecossistema de ferramentas e competências adequadas. A abordagem “Zero-to-Hero” exige a preparação do terreno empresarial através dos seguintes passos operacionais:

- Constituição do Conselho de Governança de IA: Uma equipe multifuncional composta por cientistas de dados, consultores jurídicos, CISO e representantes do negócio.

- Inventário de ativos de IA: Criação de um registro centralizado (AI Registry) de todos os modelos em uso, incluindo serviços de terceiros (IA paralela).

- Adoção de ferramentas de MLSecOps: Integração de plataformas para monitoramento contínuo do desempenho e da segurança dos modelos em produção.

| Categoria Instrumento | Função no Framework | Exemplo de Aplicação 2026 |

|---|---|---|

| Plataformas de IA TRiSM | Monitoramento e Confiança | Detecção em tempo real de desvio e viés de dados. |

| Software de GRC (Governança, Risco e Conformidade) | Gestão de Políticas | Alinhamento automático entre as políticas internas e os requisitos do Regulamento da UE sobre Inteligência Artificial. |

| Scanner de Vulnerabilidades de LLM | Segurança Técnica | Prevenção de ataques de injeção de prompt e vazamento de dados. |

O Núcleo do Framework: As Quatro Funções

A arquitetura do NIST AI RMF baseia-se em quatro funções interconectadas: Governar, Mapear, Medir e Gerenciar. Essa estrutura circular e contínua garante que o ciclo de vida da inteligência artificial seja constantemente monitorado, reduzindo vieses e vulnerabilidades operacionais .

Essas funções não são sequenciais, mas operam de forma sinérgica. A sua implementação requer metodologias rigorosas e documentação rastreável, essencial para superar quaisquer auditorias de conformidade.

Governança: Criar a Cultura da Segurança

A função de Governança do NIST AI RMF estabelece as políticas corporativas e as responsabilidades legais. É o coração da governança de IA , pois alinha as estratégias de inteligência artificial com os valores éticos, a tolerância ao risco e as regulamentações vigentes.

Nesta fase, a liderança da empresa deve definir claramente quem é responsável por cada sistema de IA. As ações-chave incluem a elaboração de um código de ética para IA, a definição dos níveis de risco aceitáveis (Declaração de Apetite ao Risco) e a criação de canais de comunicação transparentes para relatar anomalias algorítmicas sem receio de retaliação.

Mapa: Identificar os Riscos dos Modelos

Através da fase de Mapeamento do NIST AI RMF , as organizações catalogam cada sistema de IA em uso. Esta etapa exige a documentação dos dados de treinamento, das limitações do modelo e dos potenciais impactos negativos nos usuários finais ou no negócio.

O mapeamento costuma ser a fase mais complexa. De acordo com dados do setor, mais de 60% das empresas desconhecem a real extensão de sua superfície de ataque de IA. É necessário documentar:

- O contexto de utilização previsto (Intended Use) e os usos impróprios previsíveis.

- A origem e a qualidade dos conjuntos de dados de treino e validação.

- A cadeia de suprimentos de software (Lista de Materiais de IA – AIBOM).

Medida: Avaliar o Impacto da Inteligência Artificial

A fase de Medição do NIST AI RMF utiliza métricas quantitativas e qualitativas para testar a confiabilidade dos modelos. Inclui testes de estresse, análise de vieses e avaliações de robustez, garantindo que a IA opere dentro dos parâmetros de segurança preestabelecidos.

As medições devem ser objetivas e repetíveis. As equipes técnicas devem implementar métricas de justiça, precisão, interpretabilidade e resiliência a ataques adversários (Aprendizado de Máquina Adversarial). O uso de *red teaming* específico para IA tornou-se um padrão de fato em 2026 para validar a robustez dos modelos generativos antes do lançamento em produção.

Gerenciar: Mitigar as Vulnerabilidades

Com a função Gerenciar, o NIST AI RMF fornece diretrizes para responder aos riscos identificados. As empresas implementam controles técnicos, planos de contingência e monitoramento contínuo para desativar ou corrigir os sistemas de IA em caso de anomalias.

A gestão ativa de riscos exige a criação de manuais de resposta a incidentes de IA. Se um modelo começar a produzir resultados discriminatórios ou alucinações prejudiciais , os sistemas de disjuntores devem intervir automaticamente para degradar o serviço de forma segura (degradação graciosa) ou transferir o controlo para um operador humano (Human-in-the-Loop).

Exemplos Práticos de Adoção Empresarial

A aplicação do NIST AI RMF em cenários reais demonstra sua versatilidade. Seja em um chatbot baseado em LLM para atendimento ao cliente ou em algoritmos de pontuação financeira , a estrutura padroniza os processos de validação e lançamento.

Consideremos uma instituição bancária que implementa um novo sistema de aprovação de empréstimos baseado em Machine Learning. Utilizando o framework:

- Governança: O comitê estabelece que o modelo não deve utilizar variáveis demográficas sensíveis.

- Mapa: Documenta-se que o modelo será usado apenas para empréstimos abaixo de 100.000 euros e mapeiam-se os dados históricos utilizados.

- Medida: São realizados testes estatísticos para verificar a ausência de viés contra minorias específicas (Análise de Impacto Disparato).

- Gerir: É definido um alerta automático se a taxa de rejeição para um determinado grupo demográfico exceder um limite de alerta, ativando a revisão humana.

Resolução de Problemas Comuns

Durante a integração do NIST AI RMF , as empresas frequentemente enfrentam obstáculos como a falta de transparência dos fornecedores ou a baixa qualidade dos dados. A resolução desses problemas exige auditorias de terceiros e a atualização contínua das políticas do NIST RMF .

| Problema Encontrado (Solução de Problemas) | Solução Estratégica |

|---|---|

| Opacidade dos modelos de terceiros (caixa preta) | Exigir contratualmente os Model Cards e os AIBOM dos fornecedores antes da aquisição. |

| Resistência cultural das equipes de desenvolvimento | Integrar os controles de risco diretamente nos pipelines de CI/CD (Shift-Left Security) para não atrasar o lançamento. |

| Dificuldade em quantificar o risco reputacional | Utilizar estruturas de simulação de cenários e envolver partes interessadas externas (por exemplo, associações de consumidores) na fase de Medição. |

Em Resumo (TL;DR)

A adoção do NIST AI RMF em 2026 é indispensável para governar os riscos da inteligência artificial, garantindo a plena conformidade com a Lei de IA da UE.

Para iniciar este percurso, é necessária uma sólida governança corporativa, apoiada por um comitê de ética multidisciplinar e por ferramentas avançadas de auditoria algorítmica.

O núcleo do framework compreende quatro funções sinérgicas essenciais para governar, mapear, medir e gerenciar continuamente todo o ciclo de vida dos modelos.

Conclusões

Implementar com sucesso o NIST AI RMF em 2026 não é apenas uma obrigação de conformidade, mas uma vantagem competitiva. As empresas que dominam a governança de IA constroem confiança, inovam com segurança e se preparam para futuras evoluções regulatórias.

A gestão de riscos na inteligência artificial é uma jornada contínua, não um destino final. Ao adotar as funções de Governança, Mapeamento, Medição e Gestão, as organizações de TI podem maximizar o valor das tecnologias emergentes, ao mesmo tempo em que protegem seus usuários, seus dados e sua reputação no mercado global. O investimento hoje em estruturas consolidadas como a do NIST representa a melhor garantia contra as incertezas tecnológicas do futuro.

Perguntas frequentes

A estrutura NIST AI RMF representa um padrão global para a gestão de riscos relacionados à inteligência artificial. Este sistema permite que as organizações mapeiem, meçam e governem os modelos, garantindo a conformidade com as regulamentações europeias e melhorando a segurança tecnológica geral.

A arquitetura baseia-se em quatro funções contínuas e sinérgicas denominadas Governar, Mapear, Medir e Gerenciar. Essas etapas permitem estabelecer políticas éticas, catalogar os sistemas em uso, avaliar os impactos por meio de métricas objetivas e mitigar as vulnerabilidades operacionais de forma oportuna.

Para iniciar o processo, é fundamental estabelecer uma governança corporativa sólida, criando um comitê de ética multidisciplinar. Em seguida, torna-se necessário mapear a infraestrutura de dados existente e adotar ferramentas específicas para o monitoramento contínuo do desempenho e da segurança dos modelos.

Para superar a falta de transparência dos fornecedores externos, a estrutura sugere a exigência contratual de documentação específica antes da aquisição. Ferramentas como as Model Cards e as listas de materiais do software são essenciais para compreender as limitações e os dados de treinamento de modelos opacos.

A adoção deste framework padroniza os processos de validação e gestão de riscos, facilitando enormemente o cumprimento dos requisitos legais europeus. Utilizando software de governança dedicado, as empresas podem traduzir as políticas internas em ações em conformidade com as diretrizes internacionais.

Ainda tem dúvidas sobre Implementando o NIST AI RMF na Empresa: Guia 2026?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.