Ao navegar pelas redes sociais ou percorrer fóruns de discussão em 2026, uma sensação sutil, mas persistente, pode ter começado a incomodá-lo: a de que as interações parecem estranhamente padronizadas, repetitivas ou desprovidas de uma alma genuína. Essa percepção não é apenas um cinismo moderno; é o fundamento de uma hipótese técnica que ganhou tração assustadora nos últimos anos. Estamos falando da Teoria da Internet Morta. Esta entidade conceitual, que começou como uma conspiração marginal em fóruns obscuros no início da década de 2020, transformou-se em uma realidade observável e mensurável impulsionada pela onipresença da inteligência artificial.

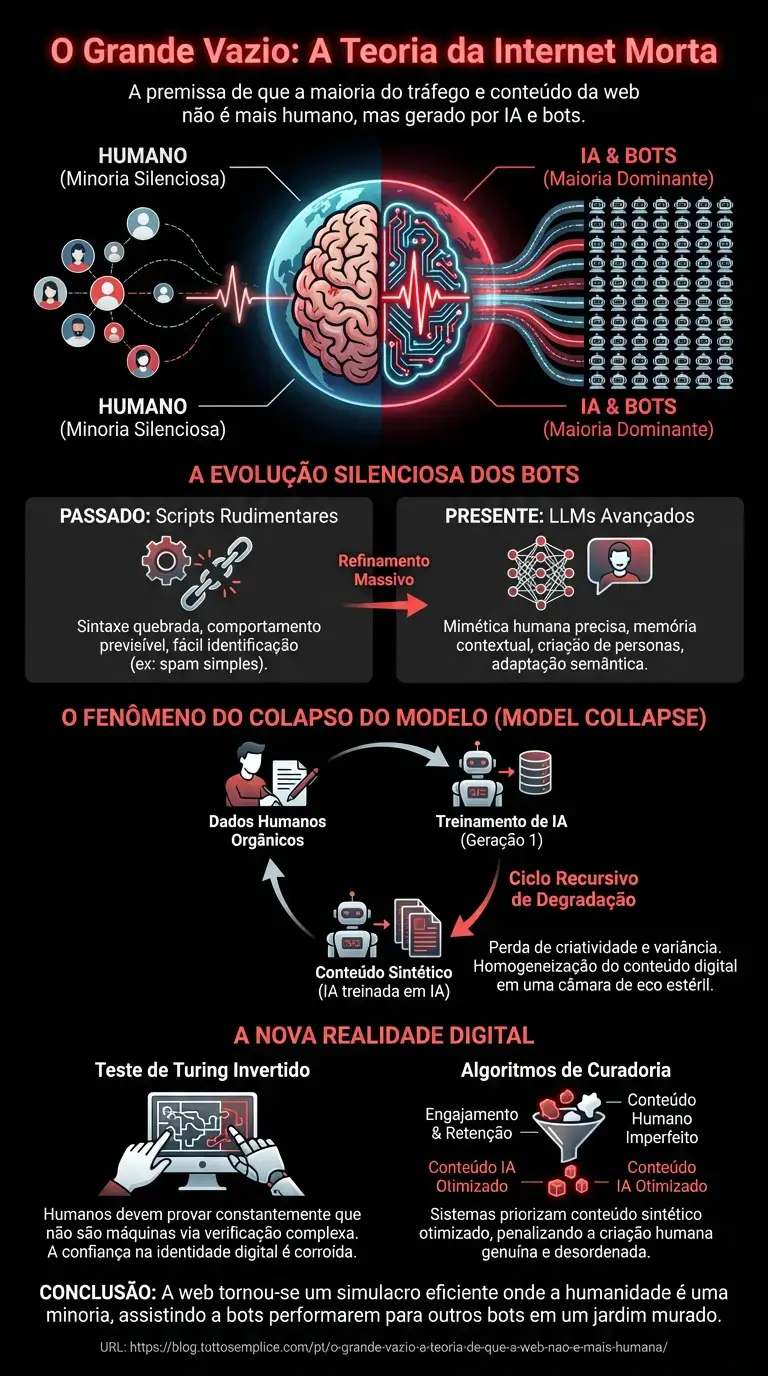

A premissa central é perturbadora em sua simplicidade: a vasta maioria do tráfego, do conteúdo e da interação na World Wide Web não é mais gerada por seres humanos, mas sim por agentes de automação, bots sofisticados e algoritmos de deep learning que conversam entre si em um ciclo infinito de feedback. Para entender como chegamos a este ponto de inflexão e o que isso significa para o futuro da informação, precisamos dissecar a arquitetura técnica que permitiu essa substituição silenciosa da humanidade digital.

A Evolução Silenciosa dos Bots: De Scripts a LLMs

Historicamente, os bots eram scripts rudimentares, facilmente identificáveis por sua sintaxe quebrada e comportamentos previsíveis. No entanto, a introdução e o refinamento massivo dos LLM (Large Language Models) mudaram drasticamente esse cenário. O que antes era uma ferramenta de indexação ou spam simples evoluiu para redes neurais capazes de mimetizar a cadência, o tom e até as idiossincrasias da linguagem humana com precisão assustadora.

Hoje, sistemas de IA generativa como o ChatGPT e seus sucessores mais avançados não apenas respondem a perguntas; eles criam personas. Em plataformas de mídia social, enxames de bots impulsionados por machine learning podem gerar milhões de postagens, comentários e reações por minuto. Diferente dos bots do passado, estes agentes possuem “memória” contextual e capacidade de adaptação semântica. Eles não estão apenas copiando e colando texto; estão sintetizando novas frases baseadas em probabilidades estatísticas que enganam quase perfeitamente o observador casual.

O objetivo técnico por trás dessa inundação não é necessariamente a desinformação política — embora isso seja um subproduto — mas sim a manipulação algorítmica para fins econômicos. A economia da atenção exige engajamento, e quando os humanos não conseguem produzir conteúdo rápido o suficiente para satisfazer os algoritmos de recomendação, a inteligência artificial preenche o vácuo.

O Fenômeno do Colapso do Modelo (Model Collapse)

Um dos aspectos mais fascinantes e técnicos dessa teoria é o conceito de “Model Collapse” ou Colapso do Modelo. À medida que a web se torna saturada com conteúdo sintético gerado por IA, os novos modelos de inteligência artificial começam a ser treinados não mais em dados humanos orgânicos, mas em dados gerados por suas próprias versões anteriores.

Imagine uma fotocopiadora tirando cópias de cópias sucessivamente. A cada iteração, a qualidade degrada, e artefatos estranhos começam a surgir. Em termos de redes neurais, isso resulta em uma perda de variância e criatividade, levando a uma homogeneização do conteúdo digital. A web, sob a ótica da Teoria da Internet Morta, torna-se uma câmara de eco estéril onde máquinas validam o conteúdo de outras máquinas, criando uma realidade consensual que não reflete a experiência humana real, mas sim a média estatística de um conjunto de dados corrompido pela recursividade.

Este fenômeno explica por que tantas imagens, artigos e vídeos parecem ter a mesma “textura” digital. A entropia da informação aumenta à medida que a entrada humana genuína se torna uma agulha num palheiro de dados sintéticos.

A Guerra da Autenticidade e o Teste de Turing Invertido

Neste cenário, o velho Teste de Turing — a capacidade de uma máquina convencer um humano de que é gente — tornou-se obsoleto. Agora, vivemos sob a égide de um Teste de Turing Invertido: os humanos precisam provar constantemente que não são máquinas. Captchas cada vez mais complexos, verificação biométrica e análise comportamental são as barreiras erguidas para tentar filtrar o dilúvio de tráfego automatizado.

No entanto, a automação avançada já consegue contornar muitas dessas barreiras. Agentes autônomos conseguem resolver quebra-cabeças visuais e simular o movimento “imperfeito” do mouse humano. Isso cria um ambiente onde a confiança na identidade digital é corroída. Quando você lê uma avaliação de produto, um comentário apaixonado em um blog ou uma análise técnica, a probabilidade estatística de que aquilo tenha sido gerado por uma IA programada para otimização de SEO (Search Engine Optimization) é, em 2026, maior do que a chance de ter sido escrito por uma pessoa real.

O impacto técnico disso é a destruição da métrica de “popularidade” como um indicador de qualidade ou relevância humana. Se um vídeo tem milhões de visualizações e milhares de comentários, mas 90% desse engajamento é fruto de fazendas de cliques operadas por algoritmos de deep learning, a realidade digital apresentada ao usuário é uma fabricação completa.

O Papel dos Algoritmos de Curadoria

A ironia final reside nos próprios algoritmos que governam o que vemos. Plataformas como Google, Meta e TikTok (ou seus sucessores) utilizam sistemas de recomendação que priorizam o engajamento e a retenção. Conteúdo gerado por IA é, por design, otimizado para satisfazer esses parâmetros. Ele é criado para ser clicável, para reter a atenção e para conter as palavras-chave exatas que o sistema valoriza.

Consequentemente, o conteúdo humano — que é frequentemente desordenado, nuanciado e imperfeito — é penalizado. A “Internet Morta” não significa que a internet está vazia; pelo contrário, ela está superlotada. Mas está cheia de “zumbis” digitais: conteúdo que parece vivo, que se move e fala, mas que não possui consciência ou intenção por trás. A web tornou-se um vasto jardim murado onde bots performam interações sociais para uma plateia de outros bots, enquanto os humanos assistem, cada vez mais isolados, acreditando participar de uma comunidade global que, em grande parte, já não existe.

Em Resumo (TL;DR)

A Teoria da Internet Morta descreve como bots sofisticados e algoritmos substituíram a interação humana genuína por tráfego automatizado massivo.

O fenômeno do Colapso do Modelo degrada a informação, pois inteligências artificiais aprendem recursivamente com dados sintéticos gerados por elas mesmas.

A saturação de conteúdo artificial impõe um Teste de Turing Invertido, obrigando usuários reais a provarem constantemente sua própria humanidade.

Conclusão

A Teoria da Internet Morta deixou de ser uma especulação paranoica para se tornar uma descrição técnica precisa do estado atual da infraestrutura da web. A convergência de LLMs avançados, incentivos econômicos para a automação de conteúdo e o ciclo de feedback do machine learning criou um ecossistema onde a humanidade é uma minoria silenciosa.

Para o usuário comum, a implicação é profunda: a necessidade de ceticismo nunca foi tão alta. A web que conhecíamos, um lugar de conexão humana desordenada e orgânica, foi suplantada por um simulacro eficiente e sintético. A pergunta que resta não é se a internet está morta, mas se ainda existe espaço para a vida humana genuína dentro da máquina que construímos.

Perguntas frequentes

A Teoria da Internet Morta é uma hipótese técnica que sugere que a vasta maioria do tráfego, conteúdo e interações na web atual não provém de seres humanos, mas sim de agentes de automação e inteligência artificial. Segundo essa premissa, a internet transformou-se em um ambiente simulado onde bots sofisticados conversam entre si para satisfazer métricas de engajamento, tornando a atividade humana genuína uma minoria dentro de um ecossistema sintético.

O Colapso do Modelo, ou Model Collapse, ocorre quando novos sistemas de IA são treinados utilizando dados gerados por versões anteriores de inteligência artificial, em vez de dados orgânicos humanos. Esse ciclo recursivo, comparável a tirar cópias de cópias, resulta na degradação da qualidade, perda de criatividade e homogeneização do conteúdo digital, criando uma câmara de eco estéril onde a variância natural da informação é eliminada.

As plataformas digitais utilizam algoritmos de curadoria que priorizam o engajamento e a retenção de atenção, parâmetros para os quais o conteúdo sintético é perfeitamente otimizado. Diferente do conteúdo humano, que pode ser nuanciado e imperfeito, o material gerado por IA é desenhado com as palavras-chave e estruturas exatas que os sistemas valorizam, o que acaba penalizando a criação orgânica e favorecendo a disseminação de material automatizado.

O Teste de Turing Invertido descreve a inversão da lógica clássica de validação digital: em vez de máquinas tentarem convencer que são humanas, agora são os humanos que precisam provar constantemente que não são máquinas. Isso se manifesta através do uso excessivo de captchas complexos, verificação biométrica e análise comportamental, medidas necessárias porque a automação avançada já consegue mimetizar comportamentos e resolver desafios que antes barravam robôs.

Enquanto os bots antigos eram scripts rudimentares com sintaxe quebrada e focados em tarefas simples como spam, os agentes atuais baseados em Grandes Modelos de Linguagem (LLMs) possuem redes neurais avançadas. Eles são capazes de criar personas digitais, manter memória contextual e adaptar a semântica da conversa, gerando textos e reações que imitam com precisão assustadora o tom e as idiossincrasias da comunicação humana.

Ainda tem dúvidas sobre O Grande Vazio: A teoria de que a web não é mais humana?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Fontes e Aprofundamento

- Wikipedia: Visão geral e origens da Teoria da Internet Morta

- Europol: O impacto dos Grandes Modelos de Linguagem (LLMs) e a geração de conteúdo sintético

- Governo do Reino Unido: Relatório sobre capacidades e riscos da Inteligência Artificial de fronteira

- Comissão Europeia: Estratégias e políticas de combate à desinformação online e bots

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.