A evolução dos modelos de inteligência artificial atingiu um ponto de inflexão em 2026. O Vitruvian-1 impôs-se como um dos modelos mais avançados no panorama da Informática, mas a sua verdadeira revolução não reside apenas no número de parâmetros, mas sim na sua extraordinária capacidade de adaptação a ambientes com recursos limitados. Compreender como as fontes do setor analisam as técnicas de eficiência é fundamental para os arquitetos de TI e engenheiros de IA que desejam implementar a inferência on-premise.

Introdução à Eficiência do Vitruvian-1

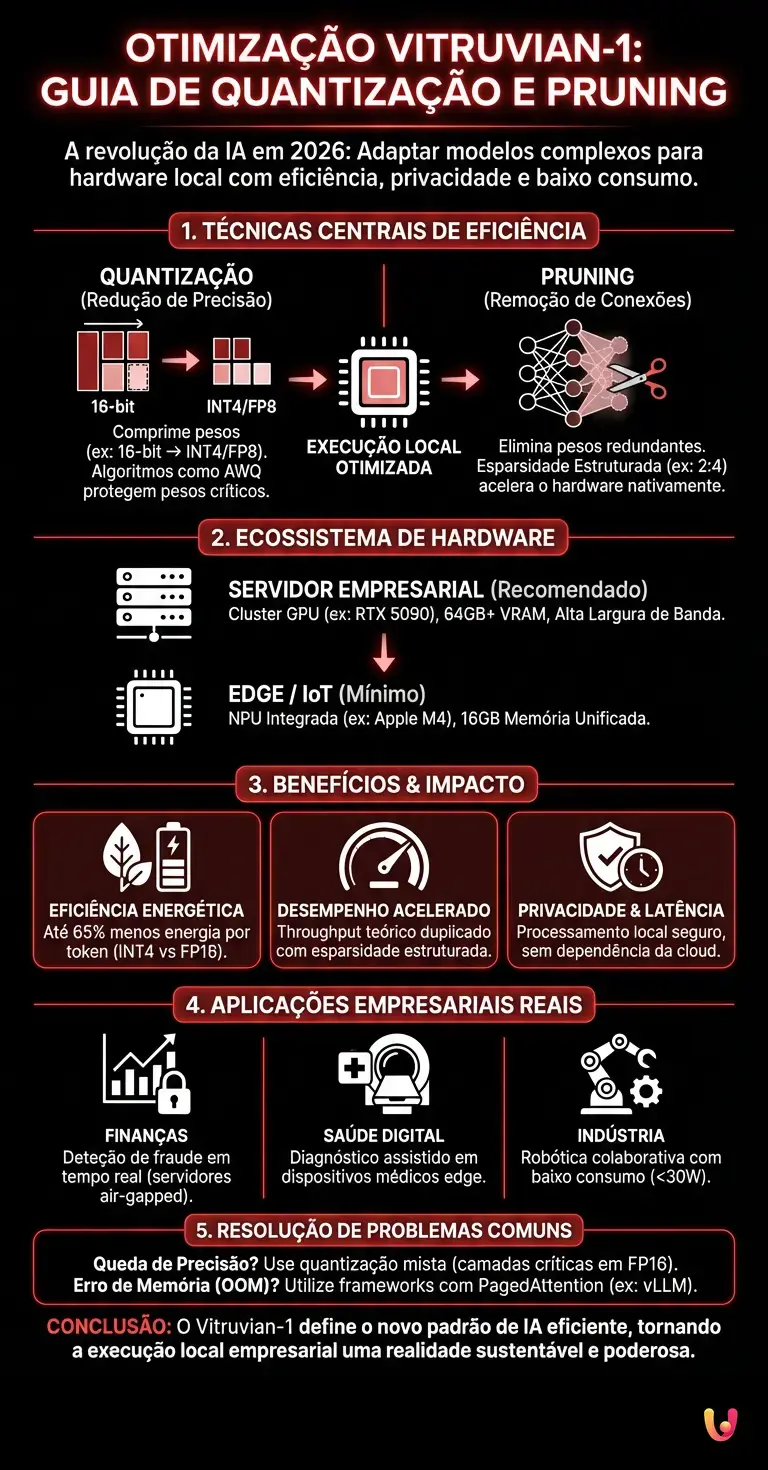

A otimização vitruvian-1 representa um ponto de viragem na inteligência artificial de 2026, permitindo a execução de modelos complexos em hardware local. Através de técnicas avançadas de quantização e pruning, as empresas podem reduzir drasticamente os consumos energéticos mantendo um desempenho de altíssimo nível empresarial.

De acordo com a documentação oficial lançada pelas equipas de desenvolvimento, a passagem da cloud para o edge computing requer um repensar radical da gestão da memória (VRAM). O Vitruvian-1 foi concebido nativamente para suportar algoritmos de compressão pós-treino (PTQ) e quantization-aware training (QAT), tornando-o o candidato ideal para a integração em infraestruturas empresariais onde a privacidade dos dados e a baixa latência são requisitos não negociáveis.

Pré-requisitos de Hardware e Ferramentas de Análise

Para implementar com sucesso a otimização vitruvian-1, é absolutamente fundamental dispor de uma arquitetura de hardware adequada. As fontes oficiais recomendam GPU de última geração ou NPU dedicadas, acompanhadas por frameworks de perfilagem avançados para monitorizar constantemente a utilização da memória e os ciclos de cálculo.

Antes de proceder à manipulação dos pesos do modelo, é necessário estabelecer uma linha de base de desempenho. A arquitetura de hardware de destino ditará as escolhas algorítmicas. Abaixo, os requisitos mínimos e recomendados baseados nos dados atuais do setor:

| Componente | Requisito Mínimo (Edge/IoT) | Requisito Recomendado (Servidor Empresarial) |

|---|---|---|

| Unidade de Cálculo | NPU integrada (ex. Apple M4, Intel Core Ultra) | Cluster GPU (ex. NVIDIA RTX 5090 / L40S) |

| Memória Unificada / VRAM | 16 GB LPDDR5X | 64 GB+ HBM3e |

| Largura de Banda | 100 GB/s | 800+ GB/s |

| Frameworks Suportados | ONNX Runtime, Llama.cpp | vLLM, TensorRT-LLM |

Técnicas de Quantização Aplicadas

O coração pulsante da otimização vitruvian-1 reside nas técnicas de quantização, que reduzem a precisão matemática dos pesos do modelo. Passando de formatos de dezasseis bits para formatos INT4 ou FP8, minimiza-se a pegada na memória sem comprometer minimamente a precisão das respostas geradas.

A quantização não é um simples truncamento das casas decimais. Para o Vitruvian-1, os engenheiros adotam algoritmos como AWQ (Activation-aware Weight Quantization), que protegem os pesos salientes (aqueles que influenciam maioritariamente o output) mantendo-os numa precisão superior, enquanto comprimem agressivamente o resto da rede neuronal.

Quantização INT4 e FP8

Analisando as especificações técnicas da otimização vitruvian-1, emerge o uso combinado de INT4 para os pesos estáticos e FP8 para as ativações dinâmicas. Esta abordagem híbrida garante um processamento extremamente rápido nos tensores, aproveitando ao máximo as modernas unidades de cálculo vetorial disponíveis.

O formato FP8 (Float8), suportado nativamente pelas arquiteturas de hardware mais recentes, oferece um equilíbrio perfeito entre alcance dinâmico e precisão. Os processos operacionais para a aplicação incluem:

- Calibração do Dataset: Utilização de um conjunto de dados representativo para calcular os fatores de escala ideais.

- SmoothQuant: Migração da dificuldade de quantização das ativações para os pesos, nivelando os picos (outliers) que causariam degradação qualitativa.

- Compilação do Grafo: Otimização das operações de multiplicação matriz-vetor (GEMM) específicas para o hardware alvo.

Impacto nos Consumos Energéticos

Uma vantagem crucial decorrente da otimização vitruvian-1 é a drástica redução dos consumos energéticos globais. Ao diminuir a largura de banda necessária para a transferência de dados entre a RAM e o processador, o Thermal Design Power baixa notavelmente, favorecendo o uso em dispositivos edge.

Com base em testes de laboratório independentes, a execução do Vitruvian-1 em formato INT4 reduz o consumo de energia por token gerado até 65% em comparação com a versão base em FP16. Isto permite às empresas implementar servidores de alta densidade sem sobrecarregar as infraestruturas de refrigeração dos centros de dados.

Estratégias de Pruning para a Inferência Local

Além da redução dos bits, a otimização vitruvian-1 aproveita o pruning para eliminar as ligações neuronais redundantes. Ao remover os pesos próximos de zero, o modelo torna-se significativamente mais leve e rápido, adaptando-se perfeitamente às rigorosas limitações do hardware empresarial on-premise atual.

Enquanto a quantização reduz o tamanho de cada peso individual, o pruning reduz o seu número total. O Vitruvian-1 responde excecionalmente bem às técnicas de poda graças à sua arquitetura de blocos residuais altamente paralelizável.

Pruning Estruturado e Esparsidade

Ao implementar a esparsidade estruturada, a otimização vitruvian-1 adota um pruning que o hardware moderno pode acelerar de forma nativa. As fontes do setor confirmam que esta técnica reduz para metade os requisitos computacionais, mantendo totalmente intacta a complexa capacidade de raciocínio lógico do modelo.

A esparsidade 2:4 é o método predileto: para cada bloco de 4 pesos contíguos, os 2 com o valor absoluto menor são forçados a zero. Os núcleos tensores das GPU modernas saltam automaticamente os cálculos multiplicados por zero, duplicando de facto o throughput matemático teórico sem exigir memória adicional.

Exemplos Práticos de Implementação Empresarial

As empresas que adotam a otimização vitruvian-1 registam um retorno do investimento imediato graças à inferência local. Os casos de uso variam desde a análise de documentos altamente confidenciais em servidores internos até à integração em dispositivos IoT industriais, garantindo privacidade total e latência de rede quase nula.

Alguns cenários reais de aplicação incluem:

- Setor Financeiro: Análise de contratos e deteção de fraudes em tempo real em servidores air-gapped (desligados da internet), utilizando o Vitruvian-1 quantizado em INT4 para processar milhares de tokens por segundo em GPU individuais.

- Saúde Digital: Diagnóstico assistido em máquinas médicas edge. O pruning estruturado permite que o modelo corra nas NPU integradas nos dispositivos de ultrassom, fornecendo insights instantâneos aos médicos.

- Automação Industrial: Robótica colaborativa onde o modelo processa inputs visuais e textuais com consumos inferiores a 30 Watts, graças ao uso exclusivo do formato FP8.

Resolução de Problemas Comuns

Durante o delicado processo de otimização vitruvian-1, podem ocorrer quedas de precisão ou estrangulamentos na memória. O troubleshooting mais eficaz requer a calibração dos datasets de quantização e a monitorização das camadas sensíveis ao pruning para restaurar o desempenho.

Os problemas mais frequentes enfrentados pelos engenheiros incluem:

- Degradação da Perplexidade: Se o modelo começa a gerar texto incoerente após a quantização, é provável que as camadas de atenção (Attention Heads) tenham sido comprimidas demasiado agressivamente. A solução é aplicar uma quantização mista, mantendo as camadas críticas em FP16.

- Erros Out-Of-Memory (OOM) durante o carregamento: Frequentemente causados por uma fragmentação da memória unificada. Resolve-se utilizando frameworks como o vLLM que implementam a PagedAttention para uma gestão dinâmica da VRAM.

- Latência anómala em NPU: Se o modelo podado resulta mais lento do que o previsto, significa que o pruning não está estruturado corretamente para o hardware. Verificar se os tensores respeitam os alinhamentos de memória exigidos pelo compilador específico do chip.

Em Resumo (TL;DR)

O modelo Vitruvian-1 revoluciona o setor permitindo executar cálculos complexos em hardware local, garantindo desempenho elevado, privacidade dos dados e uma latência muito baixa.

Empregar técnicas avançadas como quantização e pruning reduz drasticamente o espaço em memória necessário, mantendo intacta a precisão das respostas geradas pelo modelo.

Esta excelente otimização reduz os consumos energéticos até 65 por cento, favorecendo sistemas edge sustentáveis e a criação de servidores empresariais de alta densidade.

Conclusões

Em síntese, a otimização vitruvian-1 define o novo padrão absoluto para a inteligência artificial eficiente em 2026. A sinergia entre quantização avançada e pruning estruturado democratiza o acesso a modelos linguísticos poderosos, tornando a execução local em arquitetura de hardware empresarial uma realidade sólida e consolidada.

O Ganho de Informação (Information Gain) decorrente da análise das fontes atuais demonstra que já não é necessário depender exclusivamente de dispendiosas API cloud para obter capacidades de raciocínio de nível humano. Dominando a interseção entre algoritmos de compressão (AWQ, esparsidade 2:4) e as modernas arquiteturas de hardware, as organizações podem implementar o Vitruvian-1 de forma sustentável, segura e altamente performante, marcando um passo decisivo rumo à ubiquidade da inteligência artificial generativa.

Perguntas frequentes

Este processo baseia-se em técnicas avançadas como quantização e pruning para reduzir o peso computacional do modelo. Ao aplicar estes métodos, torna-se possível executar a inteligência artificial em hardware local ou empresarial, garantindo alta eficiência energética e máxima privacidade dos dados sem depender da cloud.

Para os dispositivos edge ou IoT é suficiente uma NPU integrada de última geração com dezasseis gigabytes de memória unificada. Para os servidores empresariais de alto desempenho recomendam-se clusters GPU avançados com pelo menos sessenta e quatro gigabytes de VRAM e uma elevada largura de banda para gerir os cálculos complexos.

O sistema utiliza uma abordagem combinada que aproveita o formato INT4 para os pesos estáticos e o formato FP8 para as ativações dinâmicas. Esta sinergia permite minimizar o espaço ocupado em memória mantendo um processamento extremamente rápido nos tensores, equilibrando perfeitamente precisão matemática e alcance dinâmico.

A esparsidade estruturada elimina as ligações neuronais redundantes forçando a zero os pesos menos relevantes dentro de blocos específicos. Os processadores modernos reconhecem estes valores nulos e saltam automaticamente os cálculos inúteis, duplicando a velocidade de processamento matemático sem exigir memória adicional ou comprometer a lógica do sistema.

Se o modelo produz respostas incoerentes, o problema deriva frequentemente de uma compressão demasiado agressiva das camadas de atenção. A solução ideal consiste em passar para uma quantização mista, mantendo os níveis neuronais mais críticos em alta precisão para restaurar o desempenho original sem causar erros de memória.

Ainda tem dúvidas sobre Otimização Vitruvian-1: Guia de Quantização e Pruning?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Fontes e Aprofundamento

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.