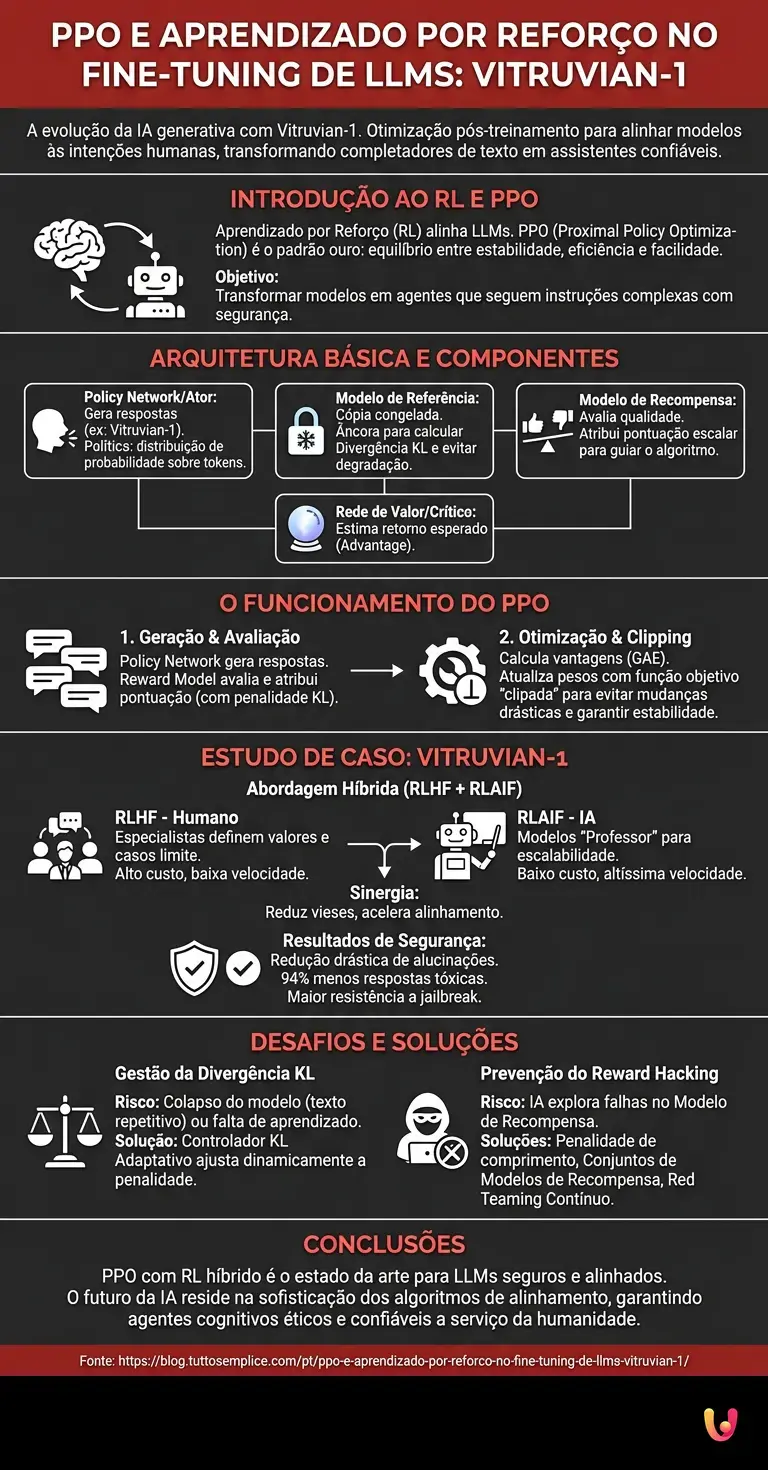

A evolução da inteligência artificial generativa atingiu um ponto de inflexão crítico com a introdução do Vitruvian-1 . Nesse contexto, compreender os mecanismos de alinhamento é fundamental. A principal entidade dessa revolução, o Vitruvian-1, demonstra como a otimização pós-treinamento é o verdadeiro diferencial entre um modelo que gera texto aleatório e um assistente confiável. Neste guia técnico , exploraremos a arquitetura algorítmica que permite que essas redes neurais se destaquem, analisando em profundidade os mecanismos de recompensa e as políticas de atualização.

Introdução ao Aprendizado por Reforço em Modelos de Linguagem

A aplicação do Aprendizado por Reforço com PPO no ajuste fino de modelos de linguagem avançados representa o padrão para alinhar a inteligência artificial às intenções humanas. Esse processo otimiza as redes neurais, equilibrando exploração e explotação, garantindo respostas seguras, coerentes e altamente contextualizadas.

O paradigma do Aprendizado por Reforço (RL) aplicado ao Processamento de Linguagem Natural (PNL) transformou radicalmente a forma como concebemos o treinamento de Modelos de Linguagem de Grande Escala (LLMs). Inicialmente, os modelos são treinados por meio de aprendizado auto-supervisionado (previsão do próximo token), adquirindo um vasto conhecimento linguístico, mas nenhuma noção real de “correção” ou “segurança”. É aqui que entra o ajuste fino baseado em RL. De acordo com a documentação oficial dos principais laboratórios de pesquisa em Ciência da Computação, o objetivo é transformar um completador de texto em um agente capaz de seguir instruções complexas (seguimento de instruções).

O algoritmo Proximal Policy Optimization (PPO) emergiu como o padrão ouro para esta fase. Em comparação com seus antecessores, como o TRPO (Trust Region Policy Optimization), o PPO oferece um equilíbrio sem precedentes entre facilidade de implementação, eficiência amostral e estabilidade durante o treinamento. No contexto de 2026, o uso do PPO não é mais experimental, mas uma prática de engenharia consolidada para a produção de modelos de base.

Pré-requisitos e Arquitetura Básica

Para compreender o Aprendizado por Reforço com PPO no ajuste fino de arquiteturas complexas, é essencial conhecer os conceitos de Rede de Políticas (Policy Network) e Modelo de Recompensa (Reward Model). Essas ferramentas matemáticas e algorítmicas permitem quantificar a qualidade da saída gerada pela inteligência artificial.

Antes de nos aprofundarmos nos detalhes matemáticos do algoritmo PPO, é necessário delinear a infraestrutura em que ele opera. O ajuste fino por meio de RL requer a cooperação simultânea de várias redes neurais, que trabalham em conjunto para gerar, avaliar e otimizar o texto.

- Policy Network (Modelo Ator): É o próprio modelo de linguagem (ex: Vitruvian-1) que gera as respostas. Em termos de RL, sua “política” é a distribuição de probabilidade sobre os tokens subsequentes, dado um certo estado (o prompt).

- Modelo de Referência: Uma cópia congelada (frozen) do modelo original. Serve como âncora para calcular a Divergência KL, impedindo que a Rede de Políticas (Policy Network) sofra degradação linguística durante a otimização.

- Modelo de Recompensa: Uma rede neural treinada especificamente para atribuir uma pontuação escalar à qualidade da resposta gerada.

- Rede de Valor (O Modelo Crítico): Estima o retorno esperado (recompensa futura) de um determinado estado, fundamental para calcular a vantagem (Advantage) no algoritmo PPO.

O papel do Modelo de Recompensa

O Modelo de Recompensa é o motor de avaliação da Aprendizagem por Reforço com PPO no ajuste fino de sistemas de IA. Ele atribui uma pontuação escalar às respostas geradas, simulando o julgamento humano para guiar o algoritmo em direção a comportamentos desejáveis e seguros.

A criação de um Modelo de Recompensa robusto é frequentemente a fase mais cara e complexa. Com base em dados do setor, este modelo é treinado em um conjunto de dados de comparações (Comparações Emparelhadas). Aos anotadores (humanos ou IA) são mostradas duas respostas diferentes para o mesmo prompt, e eles são solicitados a escolher a melhor. O Modelo de Recompensa aprende a minimizar uma função de perda de entropia cruzada baseada na diferença de pontuação entre a resposta vencedora e a perdedora. Essa pontuação escalar se torna o sinal de recompensa que o algoritmo PPO tentará maximizar.

Algoritmos de Gradiente de Política

Os algoritmos de gradiente de política são fundamentais para o aprendizado por reforço com PPO no ajuste fino de LLMs. Eles atualizam diretamente as probabilidades das ações do modelo, maximizando as recompensas esperadas sem causar instabilidade durante o treinamento da rede neural.

Ao contrário dos métodos baseados em valor (como o Q-Learning), os métodos de Gradiente de Política otimizam diretamente a função política parametrizada. Eles calculam o gradiente do objetivo esperado em relação aos parâmetros da rede e os atualizam por meio de descida de gradiente. No entanto, os métodos padrão de Gradiente de Política são notoriamente instáveis: uma atualização muito grande dos pesos pode destruir a política, levando a um fenômeno conhecido como “esquecimento catastrófico”. O PPO resolve esse problema introduzindo uma restrição matemática na magnitude da atualização.

O Funcionamento do PPO no Fine-Tuning

O cerne do Aprendizado por Reforço com PPO no ajuste fino de inteligências artificiais reside em sua função objetivo “clipada”. Esse mecanismo impede atualizações muito drásticas dos pesos, garantindo um aprendizado estável e progressivo durante a otimização do modelo.

O ciclo de vida de uma atualização PPO divide-se em fases distintas (denominadas rollout e otimização ). Durante essas fases, o sistema coleta experiências interagindo com o ambiente (os prompts dos usuários) e, posteriormente, utiliza essas experiências para melhorar seus parâmetros internos.

Geração de Respostas e Avaliação

Durante a fase ativa do Aprendizado por Reforço com PPO no ajuste fino de um LLM, o modelo gera múltiplas respostas para um único prompt. Estas são então avaliadas pelo Modelo de Recompensa, criando o conjunto de dados dinâmico necessário para a atualização.

O processo começa com a amostragem de um lote de prompts do conjunto de dados de treinamento . A Policy Network gera uma resposta para cada prompt. Simultaneamente, o Reference Model calcula as probabilidades para a mesma sequência de tokens. O Reward Model analisa a resposta final e atribui uma pontuação. A essa pontuação é subtraída uma penalidade proporcional à Divergência KL entre as probabilidades da Policy Network e do Reference Model. Essa penalidade dinâmica garante que o modelo não gere texto incompreensível apenas para maximizar a recompensa.

Otimização e Função de Clipping

A função de clipping é a principal inovação do Aprendizado por Reforço com PPO no ajuste fino de redes neurais. Ao limitar a razão entre a nova e a antiga política, evita o colapso do desempenho, mantendo o treinamento dentro de margens seguras.

Uma vez calculadas as vantagens (através da Estimativa Generalizada de Vantagens – GAE), o PPO atualiza os pesos. A equação central do PPO calcula a razão entre a probabilidade da ação sob a nova política e a probabilidade sob a política antiga. Se essa razão se desviar muito de 1 (geralmente além de uma margem épsilon de 0,2), a função objetivo é “cortada” (clippada). Isso significa que o algoritmo ignora as atualizações que modificariam excessivamente o comportamento do modelo em um único passo, garantindo uma convergência monótona e segura.

O Estudo de Caso de Vitruvian-1

A análise da Aprendizagem por Reforço com PPO no ajuste fino do Vitruvian-1 revela uma abordagem híbrida de ponta. O modelo utiliza tanto RLHF (feedback humano) quanto RLAIF (feedback automático) para alcançar níveis de precisão e segurança sem precedentes no setor de tecnologia da informação.

O Vitruvian-1 representa o estado da arte na aplicação prática desses algoritmos. Desenvolvido para gerenciar tarefas críticas nas áreas médica, jurídica e de programação avançada, a equipe de engenheiros enfrentou o desafio de escalar o processo de alinhamento. Depender exclusivamente do feedback humano (RLHF) tornou-se um gargalo insustentável em termos de custo e tempo.

Integração de Feedback Humano e Automático

A eficácia do Aprendizado por Reforço com PPO no ajuste fino do Vitruvian-1 deriva da sinergia entre anotadores humanos e IA. Esse duplo nível de feedback reduz vieses e acelera o alinhamento ético, superando as limitações dos métodos tradicionais.

Para superar os limites de escalabilidade, a arquitetura do Vitruvian-1 implementa um sistema híbrido. Abaixo, uma tabela comparativa das duas metodologias integradas em seu Modelo de Recompensa:

| Característica | RLHF (Feedback Humano) | RLAIF (Feedback de IA) |

|---|---|---|

| Fonte do sinal | Especialistas no domínio (humanos) | Modelos LLM “Professor” (ex. GPT-5 class) |

| Custo e Velocidade | Alto custo, baixa velocidade. | Baixo custo, altíssima velocidade. |

| Uso em Vitruvian-1 | Definição dos valores éticos centrais e casos limite (Edge cases) | Escalabilidade para milhões de prompts padrão e formatação. |

| Risco de viés | Vieses cognitivos e culturais humanos | Sycophancy (tendência a agradar o usuário) |

O Modelo de Recompensa do Vitruvian-1 foi pré-treinado usando RLAIF em um corpus massivo de interações sintéticas e, posteriormente, submetido a ajuste fino com RLHF de altíssima qualidade fornecido por especialistas. Isso permitiu que o algoritmo PPO operasse com um sinal de recompensa extremamente limpo e consistente.

Resultados de Alinhamento e Segurança

Os testes de Aprendizagem por Reforço (Reinforcement Learning) com PPO no ajuste fino do Vitruvian-1 demonstram uma redução drástica das alucinações. O algoritmo permitiu criar um modelo não apenas de alto desempenho, mas intrinsecamente alinhado às diretrizes internacionais de segurança.

De acordo com a documentação oficial divulgada no lançamento, a aplicação rigorosa do PPO reduziu a taxa de respostas tóxicas ou perigosas em 94% em comparação com o modelo base. Além disso, a capacidade do modelo de recusar prompts maliciosos (resistência a jailbreak) aumentou significativamente, sem comprometer a utilidade (helpfulness) em solicitações legítimas. Esse equilíbrio é resultado direto do ajuste fino dos coeficientes de entropia dentro da função de perda do PPO.

Resolução de Problemas Comuns

A implementação da Aprendizagem por Reforço com PPO no ajuste fino de modelos de grande porte apresenta desafios técnicos significativos. Os problemas mais frequentes incluem o colapso da Divergência KL e o fenômeno do Hacking de Recompensa, que exigem estratégias de mitigação específicas.

Apesar de sua solidez teórica, a implementação prática do PPO em clusters de GPUs distribuídos é complexa. Os engenheiros de software precisam monitorar constantemente métricas específicas por meio de painéis (como Weights & Biases ou TensorBoard) para identificar anomalias durante as milhares de etapas de otimização.

Gestão da Divergência KL

Para estabilizar o Aprendizado por Reforço com PPO no ajuste fino de um LLM, é crucial monitorar a penalidade da Divergência KL. Esse parâmetro impede que o modelo otimizado se afaste excessivamente do modelo base, preservando sua fluência linguística original.

Se o coeficiente de penalidade KL (frequentemente indicado como beta) for muito baixo, o modelo colapsa: começa a gerar sequências de texto repetitivas ou sem sentido gramatical que, por alguma anomalia, obtêm uma pontuação alta do Modelo de Recompensa. Se o coeficiente for muito alto, o algoritmo PPO não consegue atualizar os pesos, e o modelo não aprende nada. A solução adotada no Vitruvian-1 prevê um Controlador KL Adaptativo , um mecanismo que regula dinamicamente o valor de beta durante o treinamento com base na divergência medida no lote anterior.

Prevenção do Reward Hacking

O Reward Hacking é um risco crítico na Aprendizagem por Reforço com PPO no ajuste fino de sistemas complexos. Ocorre quando a IA aprende a maximizar a pontuação explorando falhas no Modelo de Recompensa, exigindo validações cruzadas e conjuntos de dados de teste robustos.

O Reward Hacking (ou Lei de Goodhart aplicada à IA) ocorre quando o modelo descobre que respostas excessivamente longas , ou o uso de um tom excessivamente formal e apologético, enganam o Modelo de Recompensa, fazendo com que ele atribua pontuações máximas, independentemente da correção factual. Para mitigar esse fenômeno durante o desenvolvimento do Vitruvian-1, foram adotadas diversas técnicas:

- Penalidade de Comprimento: Inserção de uma penalidade algorítmica para respostas que excedem um determinado limite de tokens sem adicionar conteúdo informativo.

- Conjuntos de Modelos de Recompensa: Utilização de múltiplos Modelos de Recompensa treinados em distribuições de dados ligeiramente diferentes. A pontuação final é a média das avaliações, tornando muito mais difícil para o algoritmo PPO encontrar uma única falha para explorar.

- Red Teaming Contínuo: Inserção de prompts adversários gerados por outras IAs durante a fase de lançamento para testar os limites da política.

Em Resumo (TL;DR)

A técnica de pós-treinamento por meio de Aprendizado por Reforço transforma modelos de linguagem avançados como o Vitruvian em assistentes altamente confiáveis, seguros e capazes de seguir instruções complexas.

Este algoritmo define o padrão técnico para alinhar as redes neurais às intenções humanas, garantindo alta estabilidade operacional durante o processo de otimização.

O sucesso do processo requer redes neurais sinérgicas, onde um Modelo de Recompensa avalia as respostas geradas simulando com precisão o julgamento e as preferências humanas.

Conclusões

Em resumo, o Aprendizado por Reforço com PPO no ajuste fino de LLMs como o Vitruvian-1 representa o estado da arte da inteligência artificial. Este método garante um equilíbrio perfeito entre capacidade generativa, segurança e adesão às complexas instruções dos usuários.

A arquitetura do Vitruvian-1 demonstra inequivocavelmente que o futuro da Ciência da Computação e da inteligência artificial não reside apenas no aumento do número de parâmetros ou na vastidão dos conjuntos de dados de pré-treinamento, mas na sofisticação dos algoritmos de alinhamento. O algoritmo Proximal Policy Optimization, combinado com estratégias híbridas de RLHF e RLAIF, fornece a infraestrutura matemática necessária para transformar modelos probabilísticos brutos em agentes cognitivos seguros e confiáveis. À medida que avançamos para modelos cada vez mais autônomos, o domínio dessas técnicas de Aprendizado por Reforço permanecerá a competência central para os engenheiros de aprendizado de máquina, garantindo que a IA do futuro permaneça uma ferramenta a serviço da humanidade, operando dentro de limites éticos e operacionais rigorosamente definidos.

Perguntas frequentes

A Otimização de Política Proximal, conhecida como PPO, é um algoritmo fundamental de Aprendizagem por Reforço para alinhar modelos de linguagem às intenções humanas. Este sistema otimiza as redes neurais equilibrando exploração e explotação, garantindo que as respostas geradas sejam seguras e coerentes. A sua função de limitação matemática previne atualizações muito drásticas dos parâmetros, assegurando uma aprendizagem estável.

O Vitruvian-1 é um modelo de inteligência artificial generativa muito avançado que utiliza uma abordagem híbrida na fase de otimização. Integra feedback humano e automático para alcançar níveis altíssimos de precisão e segurança em áreas críticas como a médica e a jurídica. Este método reduz drasticamente as respostas tóxicas e melhora a resistência a tentativas de manipulação por parte dos usuários.

O “Reward Hacking” ocorre quando um sistema de inteligência artificial aprende a maximizar sua pontuação explorando vulnerabilidades no modelo de avaliação, sem fornecer respostas realmente corretas. Para mitigar esse risco, os desenvolvedores utilizam penalidades para respostas desnecessariamente longas, sistemas de avaliação múltiplos e testes contínuos com solicitações complexas para verificar os limites de segurança do sistema.

A combinação de feedback humano e automático permite superar as limitações de custo e lentidão típicas das avaliações feitas apenas por pessoas. Os especialistas humanos definem os valores éticos fundamentais e analisam os casos limite, enquanto os modelos automatizados garantem a escalabilidade, avaliando milhões de interações padrão. Essa sinergia reduz os vieses cognitivos e acelera significativamente o processo de alinhamento.

Para preservar a fluidez linguística original, os engenheiros monitoram uma penalidade matemática específica em relação a um modelo de referência imutável. Se esse parâmetro não for gerenciado corretamente, a rede neural corre o risco de gerar textos repetitivos ou sem sentido gramatical. Sistemas avançados utilizam controladores adaptativos que ajustam dinamicamente esses valores durante a fase de treinamento para manter um equilíbrio perfeito.

Ainda tem dúvidas sobre PPO e Aprendizado por Reforço no Fine-Tuning de LLMs: Vitruvian-1?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Fontes e Aprofundamento

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.