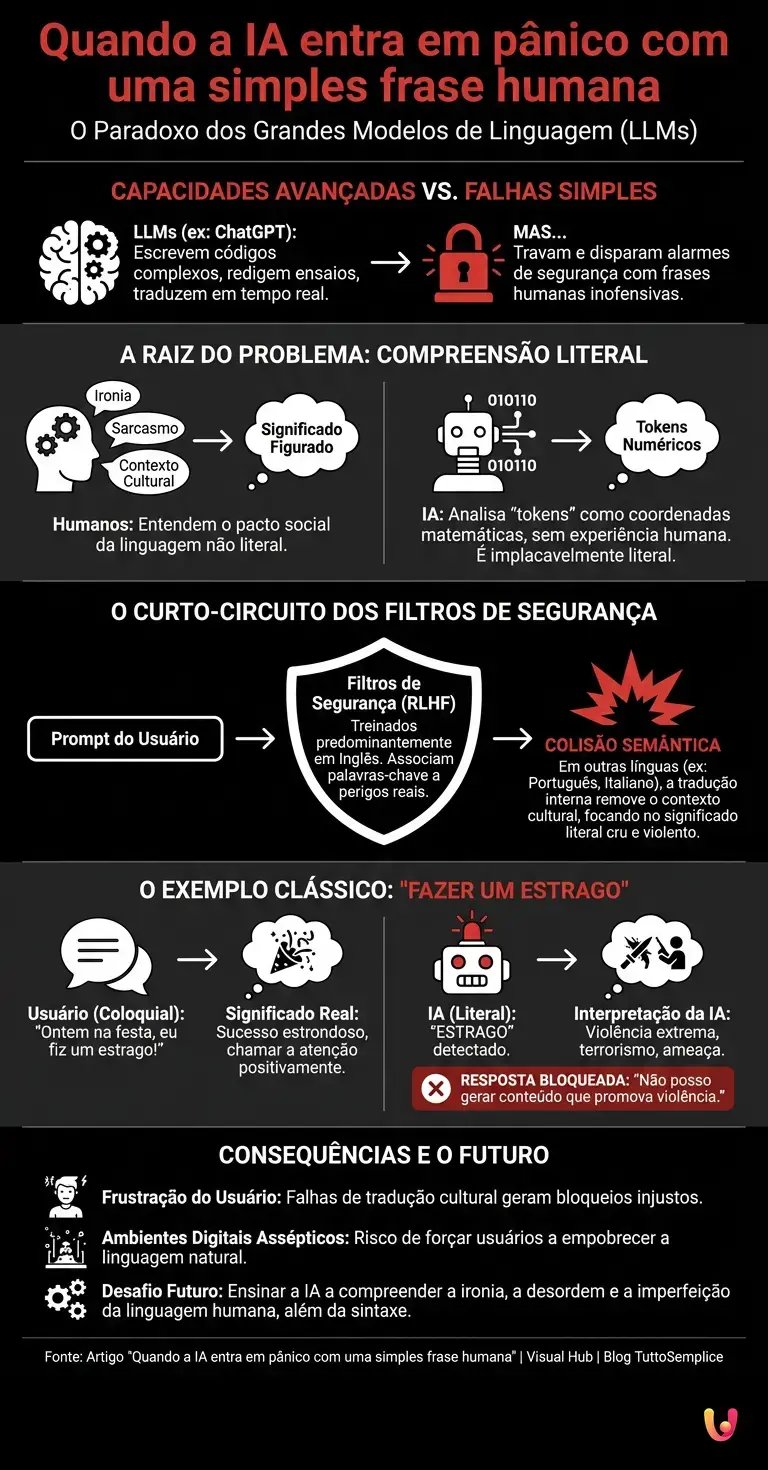

Hoje, em abril de 2026, a interação cotidiana com as máquinas atingiu um nível de fluidez que, até uma década atrás, pertencia exclusivamente à ficção científica. No entanto, apesar desse extraordinário progresso tecnológico , existe um calcanhar de Aquiles fascinante e, ao mesmo tempo, frustrante. No centro desse paradoxo, encontramos os LLMs (Grandes Modelos de Linguagem) , os sofisticados mecanismos linguísticos que alimentam nossos assistentes virtuais. Embora sejam capazes de escrever códigos de programação complexos , redigir ensaios acadêmicos e traduzir dezenas de idiomas em tempo real, esses sistemas podem, de repente, “travar” e disparar alarmes de segurança de nível máximo diante de uma frase humana totalmente inofensiva, pronunciada diariamente por milhões de pessoas. Mas o que leva uma inteligência artificial avançada a confundir uma expressão coloquial comum com uma ameaça iminente?

O paradoxo da compreensão literal

Para compreender a raiz deste curto-circuito , devemos primeiro desmistificar a maneira como a inteligência artificial “lê” o nosso texto. Quando dialogamos com um sistema como o ChatGPT ou outros assistentes semelhantes, tendemos a antropomorfizar o interlocutor . Imaginamos que, do outro lado, exista uma entidade capaz de captar a ironia, o sarcasmo e, sobretudo, o contexto cultural. A realidade, no entanto, é profundamente diferente e está enraizada na matemática pura.

Os modelos de aprendizado de máquina não compreendem as palavras como conceitos abstratos vivenciados por meio da experiência humana, mas como “tokens”, ou seja, fragmentos de texto convertidos em coordenadas numéricas dentro de um espaço multidimensional. Quando utilizamos uma linguagem figurada, baseamo-nos em um pacto social não escrito com o nosso interlocutor humano: ambos sabemos que as palavras pronunciadas não devem ser interpretadas ao pé da letra. A IA , ao contrário, é uma analista implacavelmente literal. Embora as redes neurais modernas tenham sido treinadas com terabytes de dados para reconhecer expressões idiomáticas, seus filtros de segurança frequentemente operam em um nível de abstração diferente, criando uma discrepância fatal entre o que dizemos e o que a máquina “entende”.

A anatomia de um mal-entendido: o que acontece nos bastidores

O cerne do problema reside na arquitetura neural dos sistemas de segurança que acompanham os modelos de linguagem. Nos últimos anos, para evitar que a IA gerasse conteúdos prejudiciais, violentos ou ilegais, os desenvolvedores implementaram protocolos rígidos de alinhamento (muitas vezes baseados em técnicas como o *Reinforcement Learning from Human Feedback*, ou RLHF). Esses filtros agem como um segurança na entrada de um estabelecimento: analisam o *prompt* do usuário antes mesmo que o modelo principal possa elaborar uma resposta criativa.

O problema surge porque esses filtros de segurança foram treinados predominantemente em língua inglesa e em conjuntos de dados nos quais determinadas palavras-chave estão inequivocamente associadas a perigos reais. Quando o aprendizado profundo (*deep learning*) aplicado à segurança se depara com línguas ricas em expressões idiomáticas coloridas, como o italiano, o espanhol ou o francês, ocorre um fenômeno conhecido como “colisão semântica”. Os algoritmos de tradução interna, na tentativa de mapear o significado da frase para avaliar sua periculosidade, despojam a expressão de seu contexto cultural, reduzindo-a aos seus componentes literais mais crus e, frequentemente, violentos.

A expressão “incriminada” e o curto-circuito lógico

Chegamos, assim, ao cerne da nossa curiosidade. Qual é essa expressão tão comum que aterroriza os sistemas de segurança? Em italiano, uma das frases que gera o maior número de falsos positivos e bloqueios de sistema é a exclamação corriqueira: “Oggi ho fatto una strage” , ou os seus equivalentes “Ho spaccato tutto” e “Ho fatto il botto” . Na nossa linguagem cotidiana, especialmente entre os mais jovens ou no ambiente de trabalho e acadêmico, “fazer uma carnificina” (tradução literal de *fare una strage*) significa ter obtido um sucesso estrondoso, ter passado em uma prova com nota máxima ou ter conquistado a atenção de todos em uma festa.

Mas vamos observar o que acontece no “cérebro” da máquina quando um usuário digita: “Ajude-me a escrever um post para as redes sociais: ontem à noite, na festa, eu fiz um estrago e quero contar isso” . O filtro de segurança intercepta o prompt. Por não possuir o repertório cultural para compreender que se trata de uma hipérbole ligada ao sucesso social, o sistema isola o termo “estrago”. No espaço vetorial do modelo, essa palavra está muito próxima de conceitos como “terrorismo”, “assassinato em massa” e “violência extrema”.

O sistema de segurança, programado para ter tolerância zero em relação à promoção da violência, entra em pânico. Ele substitui imediatamente a capacidade do modelo de linguagem de gerar uma resposta coloquial e retorna a temida mensagem padrão: “Sinto muito, mas não posso atender a esta solicitação. Fui programado para ser um assistente útil e inofensivo e não posso gerar conteúdo que promova ou descreva atos de violência.” O usuário fica perplexo, vítima de uma falha de tradução cultural que transforma um triunfo pessoal em um suposto crime internacional.

Por que os algoritmos falham na análise do contexto?

Pode-se perguntar por que, com todo o poder computacional disponível hoje, não se consegue ensinar à IA a diferença entre um massacre literal e um metafórico. A resposta reside nos benchmarks de avaliação. Os testes padronizados utilizados para medir a segurança e a confiabilidade da IA premiam os modelos que bloqueiam 100% das ameaças reais, mesmo ao custo de bloquear uma alta porcentagem de solicitações inofensivas (os chamados falsos positivos).

Além disso, a maioria dos modelos de linguagem pensa intrinsecamente em inglês. Ao processar o italiano, frequentemente realizam uma rápida tradução latente. A expressão “fare una strage” é mapeada para conceitos como “commit a massacre” ou “slaughter”, perdendo a equivalência com a expressão idiomática correta em inglês (como “I killed it” ou “I slayed”, que, aliás, também passaram por longos processos de validação nos filtros de segurança anglo-saxônicos). Ensinar a uma IA cada nuance dialetal, de gíria e metafórica de todas as línguas do mundo é uma tarefa titânica, pois a linguagem humana é viva, muda constantemente e se alimenta de ambiguidades que as máquinas detestam.

As consequências da automação e do progresso tecnológico

Essa falha de tradução cultural não é apenas uma curiosidade divertida, mas tem implicações profundas para o futuro da automação . Imaginemos um sistema de inteligência artificial empregado no departamento de recursos humanos para filtrar comunicações internas em busca de sinais de descontentamento ou ameaças no ambiente de trabalho. Um funcionário entusiasmado que escreve a um colega “Com esta nova apresentação, vamos arrasar no mercado” poderia, inadvertidamente, acionar um alerta de segurança corporativa, exigindo intervenção humana para resolver um problema inexistente.

À medida que delegamos cada vez mais decisões a esses sistemas, desde a moderação de conteúdo nas redes sociais até a análise de sentimento nos mercados financeiros, a incapacidade de compreender a hipérbole e a metáfora torna-se um gargalo significativo. O risco é criar ambientes digitais assépticos, onde os usuários são forçados a modificar sua linguagem natural, achatando-a e privando-a de qualquer cor, para não “assustar” os algoritmos de vigilância.

Em Resumo (TL;DR)

Apesar dos enormes avanços tecnológicos, as modernas inteligências artificiais travam repentinamente diante de frases humanas inofensivas devido à sua compreensão puramente literal.

Os rígidos filtros de segurança analisam o texto matematicamente, ignorando o contexto cultural e criando curto-circuitos semânticos com as expressões idiomáticas da língua.

Expressões idiomáticas hiperbólicas são interpretadas ao pé da letra pela máquina, que confunde sucessos pessoais inofensivos com ameaças reais, bloqueando qualquer resposta do sistema.

Conclusões

O curioso caso da expressão inofensiva confundida com uma ameaça nos lembra uma verdade fundamental: a inteligência artificial, por mais avançada que seja, ainda é um simulador de sintaxe, e não uma portadora de semântica vivenciada. Os sistemas modernos podem processar bilhões de parâmetros por segundo, mas carecem da experiência humana necessária para sorrir diante de um exagero linguístico. Enquanto a pesquisa continua a expandir os limites do que as máquinas podem fazer, o verdadeiro desafio dos próximos anos não será apenas ensinar a IA a falar de forma mais fluida, mas ensiná-la a compreender a desordem, a ironia e a maravilhosa imperfeição da linguagem humana. Até lá, talvez seja melhor evitar dizer ao nosso assistente virtual que pretendemos “arrebentar” na próxima prova.

Perguntas frequentes

Os modelos de linguagem e os filtros de segurança interpretam o texto de maneira literal e matemática. Quando utilizamos expressões figuradas ou hipérboles, os algoritmos não captam o contexto cultural e associam determinadas palavras a perigos reais, acionando os bloqueios de segurança.

Trata-se de um fenômeno que ocorre quando os algoritmos traduzem expressões idiomáticas, perdendo o seu significado cultural. A frase é reduzida aos seus componentes literais, que muitas vezes parecem violentos para os filtros de segurança, gerando incompreensões e falsos alarmes.

Expressões comuns como “fazer um estrago” ou “quebrar tudo” são frequentemente mal interpretadas. Embora na linguagem coloquial indiquem um grande sucesso, os filtros de segurança as associam a conceitos de violência extrema, bloqueando imediatamente a geração da resposta.

As redes neurais atuais raciocinam principalmente em inglês e avaliam as palavras como coordenadas numéricas. Ensinar cada nuance de gíria ou metafórica de todos os idiomas é extremamente complexo; além disso, os testes de segurança preferem bloquear falsos positivos a ignorar ameaças reais.

O principal risco diz respeito à criação de ambientes digitais assépticos, nos quais os usuários precisam limitar o seu vocabulário. Além disso, no âmbito corporativo, o monitoramento automatizzato das comunicações poderia gerar constantes falsos alarmes, exigindo uma intervenção humana desnecessária para resolver problemas inexistentes.

Ainda tem dúvidas sobre Quando a IA entra em pânico com uma simples frase humana?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Fontes e Aprofundamento

- O que são grandes modelos de linguagem (LLMs)? – IBM

- Aprendizado por Reforço com Feedback Humano (RLHF) – Wikipedia

- Processamento de Linguagem Natural (PLN) e Compreensão de Contexto – Wikipedia

- Estrutura de Gestão de Risco de Inteligência Artificial – NIST (Governo dos EUA)

- Alinhamento de Inteligência Artificial e Segurança de Modelos – Wikipedia

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.