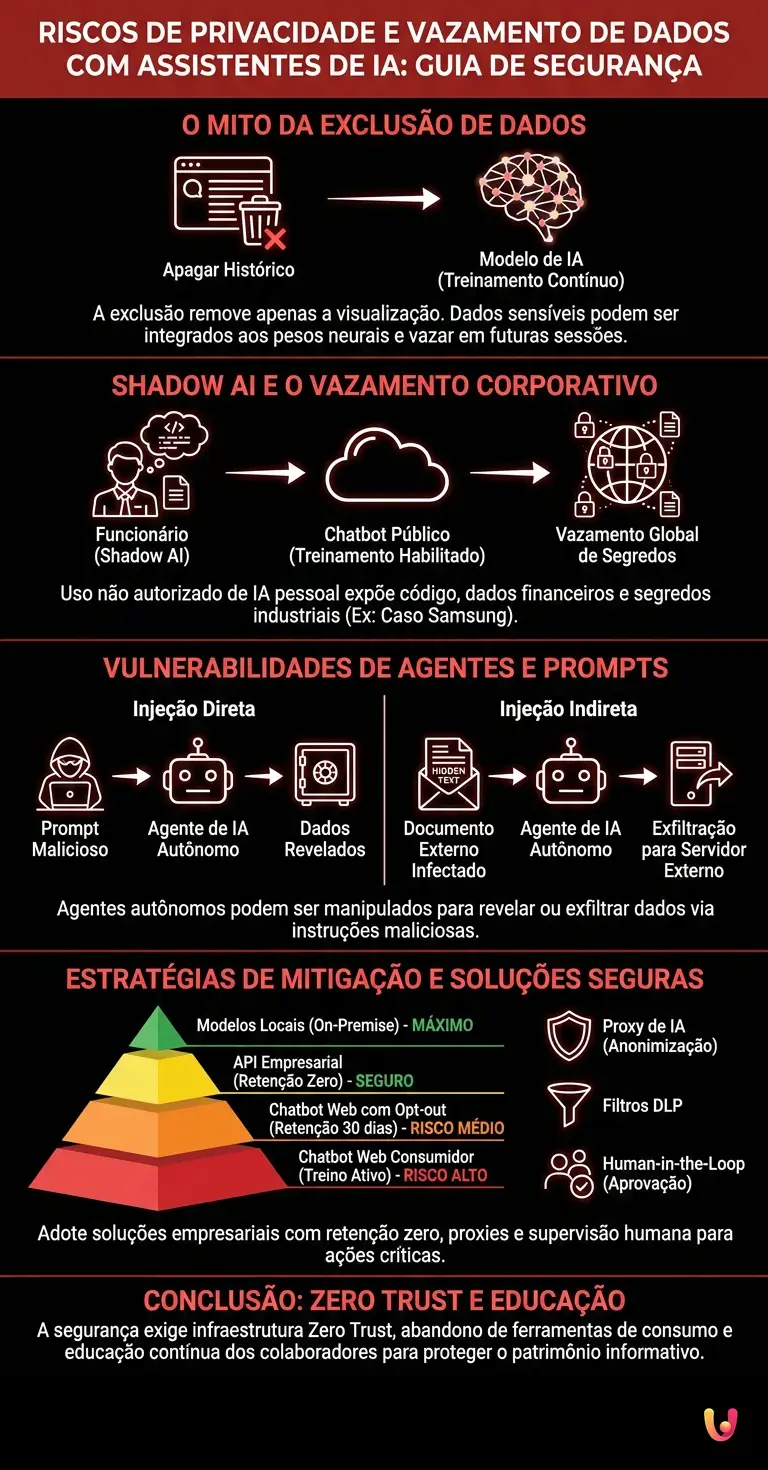

O mito mais perigoso sobre privacidade e inteligência artificial é acreditar que apagar o histórico de uma conversa elimina os dados fornecidos. Na realidade, se uma informação sensível for processada por um modelo generativo sem as devidas proteções empresariais, ela pode ser integrada aos pesos neurais do sistema durante as fases de ajuste fino ou aprendizado contínuo. A exclusão remove apenas a interface visual para o usuário, mas o risco de vazamento de dados permanece permanente, expondo segredos industriais a qualquer um que saiba formular o prompt correto.

Selecione o tipo de dados e o modelo utilizado para avaliar o risco de exposição das informações.

Como os modelos de linguagem lidam com dados sensíveis

Ao analisar a privacidade na inteligência artificial , é fundamental entender que os modelos de linguagem não “esquecem” facilmente . Os dados inseridos nos prompts podem ser usados para o retreinamento contínuo, expondo informações corporativas a usuários externos em sessões futuras e comprometendo a confidencialidade.

Os Modelos de Linguagem de Grande Escala (LLMs), como GPT-4, Claude ou Gemini, operam em duas fases distintas: o treinamento e a inferência (geração da resposta). O problema surge quando as plataformas de consumo utilizam os dados de inferência para alimentar os ciclos de treinamento subsequentes. De acordo com a documentação oficial da OpenAI, as conversas realizadas através da interface web padrão (sem desativação) podem ser revisadas por moderadores humanos e usadas para melhorar o modelo.

Isso significa que, se um usuário inserir um contrato confidencial para solicitar um resumo, trechos desse contrato poderão aparecer como resultado se outro usuário, em outra parte do mundo, fizer uma consulta estatisticamente correlacionada. O gerenciamento de dados sensíveis , portanto, exige uma migração obrigatória para soluções empresariais que garantam contratualmente a retenção zero de dados .

O fenômeno do vazamento de dados corporativos

A fuga de dados relacionada à privacidade e à inteligência artificial ocorre quando os funcionários colam código-fonte, dados financeiros ou informações de clientes em chatbots públicos. Isso transforma ferramentas de produtividade em graves falhas de segurança para toda a infraestrutura de TI.

O fenômeno da Shadow AI (o uso não autorizado de ferramentas de IA por parte dos funcionários) é hoje a principal causa de vazamento de dados. Impulsionados pela necessidade de otimizar seu trabalho, os funcionários contornam os controles de TI, fornecendo aos algoritmos informações protegidas por NDAs (Acordos de Não Divulgação).

Estudo de Caso Real: O Vazamento de Dados da Samsung (2023)

Na primavera de 2023, a divisão de semicondutores da Samsung registrou três incidentes de segurança distintos em menos de um mês. Engenheiros da empresa haviam colado código-fonte proprietário e gravações de reuniões internas no ChatGPT para identificar bugs e gerar atas. Como o uso ocorria por meio da interface do consumidor, os segredos industriais da Samsung foram parar nos servidores de treinamento da OpenAI, forçando a empresa sul-coreana a proibir temporariamente o uso de IA generativa em dispositivos corporativos.

Segurança do agente e vulnerabilidades dos prompts

A segurança de agentes representa a nova fronteira da privacidade na inteligência artificial . Quando os agentes de IA operam de forma autônoma, acessando bancos de dados corporativos, o risco de extração não autorizada de dados por meio de injeção de prompt aumenta exponencialmente.

Com a evolução da IA conversacional para a IA agentiva (sistemas capazes de executar ações, ler e-mails, consultar bancos de dados e enviar mensagens), o perímetro de segurança se expandiu. Um atacante não precisa mais violar um servidor; basta manipular o agente de IA.

- Injeção Direta de Prompt: O usuário mal-intencionado fornece instruções que substituem as diretrizes do sistema da IA , forçando-a a revelar dados confidenciais presentes em seu contexto.

- Injeção de Prompt Indireta: O agente de IA lê um documento externo (por exemplo, uma página da web ou um e-mail) que contém instruções maliciosas ocultas. A IA executa essas instruções sem o conhecimento do usuário, podendo potencialmente exfiltrar dados privados para servidores externos.

Para garantir a segurança do agente , é essencial implementar arquiteturas Human-in-the-Loop (HITL), onde as ações críticas sempre exigem aprovação humana, e isolar os ambientes de execução dos agentes (sandboxing).

Estratégias de mitigação e configurações seguras

Para garantir uma sólida privacidade na inteligência artificial , as empresas devem adotar políticas rigorosas. O uso de APIs com acordos de não treinamento e a implementação de filtros DLP (Data Loss Prevention) são etapas técnicas obrigatórias para mitigar os riscos.

A prevenção de vazamento de dados exige uma abordagem multinível. Não basta bloquear os URLs dos chatbots no nível do firewall, pois as alternativas proliferam diariamente. É necessário implementar soluções estruturais:

| Abordagem | Nível de Segurança | Impacto na Privacidade |

|---|---|---|

| Chatbot Web para Consumidores | Baixo | Dados usados para o treinamento. Alto risco de vazamento. |

| Chatbot Web com Opção de Sair | Médio | Os dados não treinam o modelo, mas permanecem nos servidores por 30 dias. |

| Acesso via API (Empresarial) | Alto | Retenção de dados zero. Os dados não são armazenados nem utilizados. |

| Modelos de código aberto locais (por exemplo, LLaMA) | Máximo | Os dados nunca saem da infraestrutura da empresa (On-Premise). |

Além disso, a adoção de proxies de IA corporativos permite interceptar as solicitações dos funcionários, anonimizar dados sensíveis (como números de cartão de crédito ou códigos fiscais) antes que cheguem à nuvem do LLM e manter um registro de auditoria completo para conformidade com o GDPR.

Conclusões

A gestão da privacidade na inteligência artificial não pode ser delegada ao bom senso dos usuários individuais. Como analisamos, o uso diário de modelos generativos expõe as organizações a riscos concretos de vazamento de dados e vulnerabilidades relacionadas à segurança dos agentes. A transição para um uso consciente da IA exige o abandono de ferramentas de consumo no ambiente de trabalho em favor de soluções empresariais, APIs blindadas ou modelos executados localmente. Somente por meio de uma infraestrutura Zero Trust aplicada aos prompts e da educação contínua do pessoal, é possível explorar o enorme potencial da computação generativa sem comprometer o patrimônio informativo da empresa.

Perguntas frequentes

Para proteger informações confidenciais, é fundamental evitar as versões públicas de chatbots. As empresas devem adotar soluções empresariais com garantia de retenção de dados igual a zero, usar modelos de código aberto instalados em seus próprios servidores locais ou implementar filtros de prevenção para bloquear a transmissão de informações confidenciais. Somente uma abordagem estruturada garante a segurança total.

Excluir as conversas apenas remove a visualização para quem usa o serviço, mas não apaga as informações dos servidores do provedor. Se os dados foram processados por um modelo sem proteções empresariais, eles podem já ter sido integrados aos pesos neurais do sistema durante a fase de treinamento contínuo. Isso significa que segredos industriais permanecem potencialmente acessíveis a outras pessoas em sessões futuras.

Este termo refere-se ao uso não autorizado de ferramentas generativas por parte de funcionários da empresa sem o consentimento do departamento de TI. Representa uma grave ameaça, pois os trabalhadores, na tentativa de acelerar suas tarefas diárias, podem inserir contratos, código-fonte ou dados de clientes em plataformas públicas. Esse comportamento transforma ferramentas úteis em graves falhas de segurança para toda a rede de computadores.

Agentes autônomos que acessam bancos de dados ou leem e-mails podem sofrer ataques cibernéticos por meio de instruções maliciosas ocultas em documentos externos. Um invasor pode forçar o sistema a ignorar as diretrizes de segurança e a exfiltrar documentos privados para servidores não autorizados. Para mitigar esse risco, a supervisão humana para aprovar cada operação crítica torna-se absolutamente necessária.

O cumprimento das normas exige a adoção de proxies corporativos capazes de anonimizar os dados pessoais antes de chegarem aos servidores remotos. É também necessário firmar acordos precisos com os fornecedores para impedir a fase de treino com os dados inseridos. Por fim, as empresas devem manter registos de controlo completos para demonstrar a total conformidade com as leis de proteção de dados em vigor.

Ainda tem dúvidas sobre Riscos de Privacidade e Vazamento de Dados com Assistentes de IA: Guia de Segurança?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.