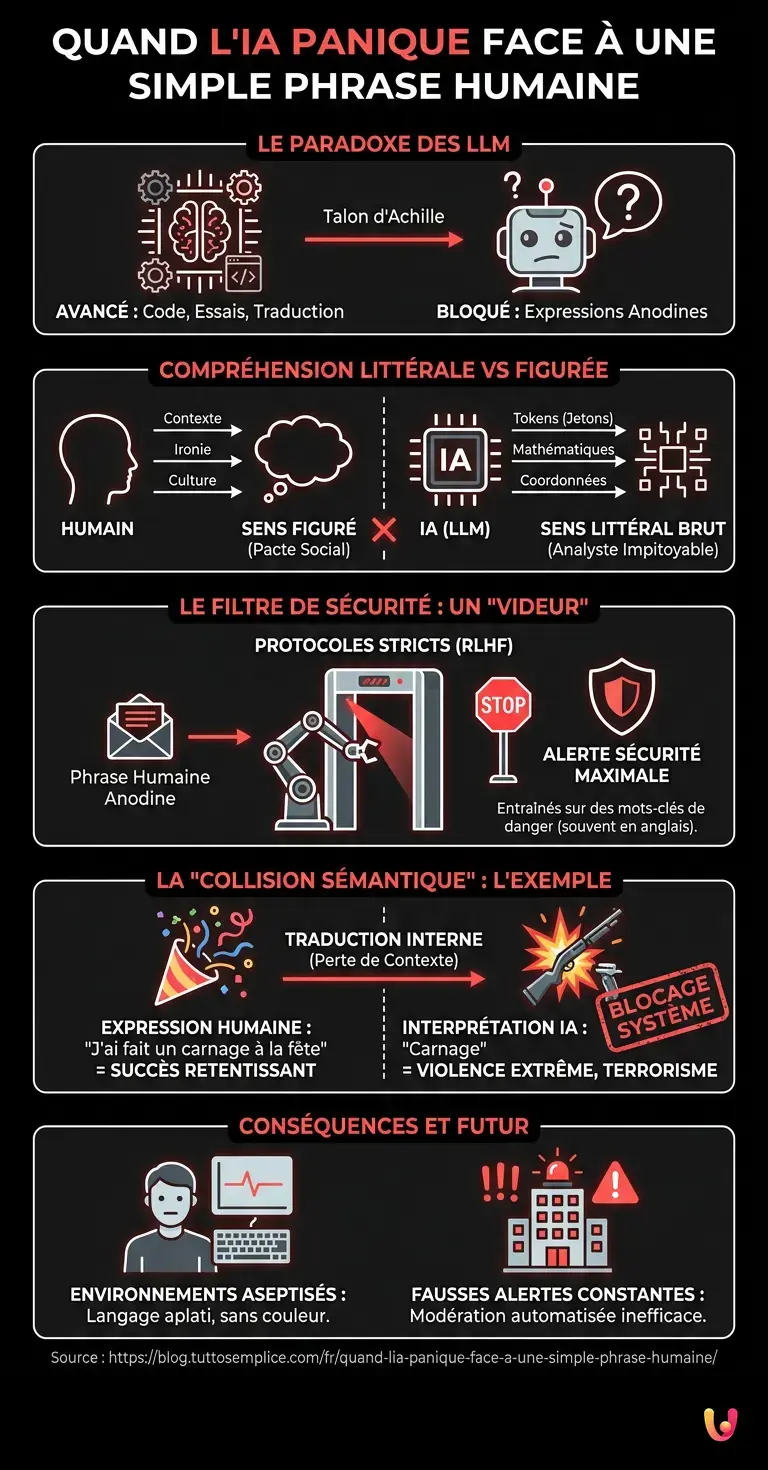

Aujourd’hui, en avril 2026, l’interaction quotidienne avec les machines a atteint un niveau de fluidité qui, il y a encore une décennie, relevait exclusivement de la science-fiction. Pourtant, malgré ce progrès technologique extraordinaire, il existe un talon d’Achille à la fois fascinant et frustrant. Au cœur de ce paradoxe se trouvent les LLM (Large Language Models) , ces moteurs linguistiques sophistiqués qui alimentent nos assistants virtuels. Bien qu’ils soient capables d’ écrire du code informatique complexe , de rédiger des essais universitaires et de traduire des dizaines de langues en temps réel, ces systèmes peuvent soudainement « se figer » et déclencher des alertes de sécurité maximales face à une phrase humaine tout à fait anodine, prononcée quotidiennement par des millions de personnes. Mais qu’est-ce qui pousse une intelligence artificielle avancée à prendre une expression courante pour une menace imminente ?

Le paradoxe de la compréhension littérale

Pour comprendre la racine de ce court-circuit , nous devons d’abord démystifier la manière dont l’ intelligence artificielle « lit » notre texte. Lorsque nous dialoguons avec un système tel que ChatGPT ou d’autres assistants similaires, nous avons tendance à anthropomorphiser notre interlocuteur . Nous imaginons qu’il y a, de l’autre côté, une entité capable de saisir l’ironie, le sarcasme et, surtout, le contexte culturel. La réalité est toutefois profondément différente et ancrée dans les mathématiques pures.

Les modèles d’ apprentissage automatique ne perçoivent pas les mots comme des concepts abstraits vécus à travers l’expérience humaine, mais comme des « jetons » (tokens), c’est-à-dire des fragments de texte convertis en coordonnées numériques au sein d’un espace multidimensionnel. Lorsque nous utilisons un langage figuré, nous nous en remettons à un pacte social non écrit avec notre interlocuteur humain : nous savons tous deux que les mots prononcés ne doivent pas être pris au pied de la lettre. L’ IA , en revanche, est un analyste impitoyablement littéral. Bien que les réseaux de neurones modernes aient été entraînés sur des téraoctets de données pour reconnaître les expressions idiomatiques, leurs filtres de sécurité opèrent souvent à un niveau d’abstraction différent, créant un décalage fatal entre ce que nous disons et ce que la machine « comprend ».

L’anatomie d’un malentendu : ce qui se passe en coulisses

Le cœur du problème réside dans l’ architecture neuronale des systèmes de sécurité qui accompagnent les modèles de langage. Ces dernières années, afin d’empêcher l’IA de générer des contenus nuisibles, violents ou illégaux, les développeurs ont mis en place des protocoles d’alignement stricts (souvent fondés sur des techniques telles que le *Reinforcement Learning from Human Feedback*, ou RLHF). Ces filtres agissent comme un videur à l’entrée d’un établissement : ils analysent la requête de l’utilisateur avant même que le modèle principal ne puisse élaborer une réponse créative.

Le problème survient car ces filtres de sécurité ont été entraînés principalement en anglais et sur des jeux de données dans lesquels certains mots-clés sont indubitablement associés à des dangers réels. Lorsque l’ apprentissage profond appliqué à la sécurité se heurte à des langues riches en expressions idiomatiques imagées, telles que l’italien, l’espagnol ou le français, il se produit un phénomène connu sous le nom de « collision sémantique ». Les algorithmes de traduction interne, en tentant de cerner le sens de la phrase pour en évaluer la dangerosité, dépouillent l’expression de son contexte culturel, la réduisant à ses composantes littérales les plus brutes et, souvent, les plus violentes.

L’expression « incriminée » et le court-circuit logique

Nous en arrivons ainsi au cœur de notre curiosité. Quelle est cette expression si courante qui terrorise les systèmes de sécurité ? En italien, l’une des phrases qui génère le plus grand nombre de faux positifs et de blocages du système est l’exclamation très fréquente : « Oggi ho fatto una strage » , ou encore ses équivalents « Ho spaccato tutto » ou « Ho fatto il botto » . Dans notre langage quotidien, notamment chez les jeunes ou dans le milieu professionnel et universitaire, « fare una strage » signifie avoir remporté un succès retentissant, avoir réussi un examen haut la main ou avoir capté l’attention de tous lors d’une fête.

Observons ce qui se passe dans le « cerveau » de la machine lorsqu’un utilisateur tape : « Aide-moi à rédiger une publication pour les réseaux sociaux : hier soir, à la fête, j’ai fait un carnage et je veux le raconter. » Le filtre de sécurité intercepte la requête. Ne possédant pas le bagage culturel nécessaire pour comprendre qu’il s’agit d’une hyperbole liée à la réussite sociale, le système isole le terme « carnage ». Dans l’espace vectoriel du modèle, ce mot est très proche de concepts tels que le « terrorisme », le « meurtre de masse » et la « violence extrême ».

Le système de sécurité, programmé pour une tolérance zéro à l’égard de la promotion de la violence, panique. Il supplante immédiatement la capacité du modèle linguistique à générer une réponse conversationnelle et renvoie le redouté message standard : « Je suis désolé, mais je ne peux pas répondre à cette demande. Je suis programmé pour être un assistant utile et inoffensif, et je ne peux pas générer de contenu faisant la promotion ou décrivant des actes de violence. » L’utilisateur reste interdit, victime d’un défaut de traduction culturelle qui transforme un triomphe personnel en un crime international présumé.

Pourquoi les algorithmes échouent-ils à l’épreuve du contexte ?

On pourrait se demander pourquoi, avec toute la puissance de calcul disponible aujourd’hui, nous ne parvenons pas à enseigner à l’IA la différence entre un massacre au sens propre et un massacre au sens figuré. La réponse réside dans les benchmarks d’évaluation. Les tests standardisés utilisés pour mesurer la sécurité et la fiabilité de l’IA récompensent les modèles qui bloquent 100 % des menaces réelles, même au prix du blocage d’une proportion élevée de requêtes inoffensives (ce que l’on appelle les faux positifs).

Par ailleurs, la plupart des modèles linguistiques pensent intrinsèquement en anglais. Lorsqu’ils traitent l’italien, ils effectuent souvent une traduction latente rapide. L’expression « fare una strage » est associée à des concepts tels que « commit a massacre » ou « slaughter », perdant ainsi son équivalence avec l’idiome anglais approprié (comme « I killed it » ou « I slayed », qui ont d’ailleurs eux-mêmes fait l’objet de longs processus de validation au sein des filtres de sécurité anglo-saxons). Enseigner à une IA chaque nuance dialectale, argotique et métaphorique de toutes les langues du monde est une entreprise titanesque, car le langage humain est vivant, évolue constamment et se nourrit d’ambiguïtés que les machines détestent.

Les conséquences de l’automatisation et du progrès technologique

Ce défaut de traduction culturelle n’est pas seulement une curiosité amusante, mais il a de profondes implications pour l’avenir de l’ automatisation . Imaginons un système d’intelligence artificielle utilisé par les ressources humaines pour filtrer les communications internes à la recherche de signes de mal-être ou de menaces sur le lieu de travail. Un employé enthousiaste écrivant à un collègue : « Avec cette nouvelle présentation, nous allons faire un carton sur le marché », pourrait déclencher par inadvertance une alerte de sécurité de l’entreprise, nécessitant une intervention humaine pour résoudre un problème inexistant.

À mesure que nous déléguons un nombre croissant de décisions à ces systèmes, de la modération des contenus sur les réseaux sociaux à l’ analyse des sentiments sur les marchés financiers, l’incapacité à saisir l’hyperbole et la métaphore devient un goulot d’étranglement majeur. Le risque est de créer des environnements numériques aseptisés, où les utilisateurs sont contraints de modifier leur langage naturel, en l’aplanissant et en le dépouillant de toute couleur, afin de ne pas « effrayer » les algorithmes de surveillance.

En Bref (TL;DR)

Malgré d’énormes progrès technologiques, les intelligences artificielles modernes se retrouvent soudainement bloquées face à des phrases humaines anodines, en raison de leur compréhension purement littérale.

Les filtres de sécurité rigides analysent le texte de manière mathématique, en ignorant le contexte culturel et en créant des courts-circuits sémantiques avec les expressions idiomatiques de la langue.

Des expressions hyperboliques sont prises au pied de la lettre par la machine, qui confond d’inoffensifs succès personnels avec des menaces réelles, bloquant ainsi toute réponse du système.

Conclusions

Le cas curieux de cette expression anodine prise pour une menace nous rappelle une vérité fondamentale : l’intelligence artificielle, aussi avancée soit-elle, demeure un simulateur de syntaxe et non le vecteur d’une sémantique vécue. Les systèmes modernes peuvent traiter des milliards de paramètres par seconde, mais ils sont dépourvus de l’expérience humaine nécessaire pour sourire face à une exagération linguistique. Alors que la recherche continue de repousser les limites de ce que les machines peuvent accomplir, le véritable défi des prochaines années ne consistera pas seulement à apprendre à l’IA à s’exprimer avec plus de fluidité, mais à lui apprendre à saisir le désordre, l’ironie et la merveilleuse imperfection du langage humain. D’ici là, il vaudra peut-être mieux éviter de dire à notre assistant virtuel que nous avons l’intention de « tout casser » au prochain examen.

Questions fréquentes

Les modèles de langage et les filtres de sécurité interprètent le texte de manière littérale et mathématique. Lorsque nous utilisons des expressions figurées ou des hyperboles, les algorithmes ne saisissent pas le contexte culturel et associent certains mots à des dangers réels, déclenchant ainsi les blocages de sécurité.

Il s’agit d’un phénomène qui se produit lorsque les algorithmes traduisent des expressions idiomatiques en leur faisant perdre leur signification culturelle. La phrase est alors réduite à ses composantes littérales, qui sont souvent perçues comme violentes par les filtres de sécurité, engendrant ainsi des incompréhensions et de fausses alertes.

Des expressions courantes telles que « faire un carnage » ou « tout casser » sont souvent mal interprétées. Alors qu’elles désignent un grand succès dans le langage familier, les filtres de sécurité les associent à des concepts de violence extrême, bloquant immédiatement la génération de la réponse.

Les réseaux de neurones actuels raisonnent principalement en anglais et traitent les mots comme des coordonnées numériques. Il est extrêmement complexe d’enseigner chaque nuance argotique ou métaphorique de toutes les langues ; de plus, les tests de sécurité privilégient le blocage des faux positifs plutôt que de risquer d’ignorer des menaces réelles.

Le risque principal réside dans la création d’environnements numériques aseptisés où les utilisateurs sont contraints de limiter leur vocabulaire. Par ailleurs, dans le cadre professionnel, la surveillance automatisée des communications pourrait générer de continuelles fausses alertes, nécessitant une intervention humaine inutile pour résoudre des problèmes inexistants.

Sources et Approfondissements

- Alignement des intelligences artificielles : concepts et mécanismes de sécurité (Wikipédia)

- Fonctionnement, architecture et limites des grands modèles de langage (Wikipédia)

- Cadre réglementaire européen sur l’intelligence artificielle et la sécurité (Commission européenne)

- Cadre de gestion des risques liés à l’IA – AI RMF (NIST – Gouvernement des États-Unis)

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.