Nous vivons à une époque où l’ intelligence artificielle semble ne plus avoir de frontières. Les superordinateurs d’aujourd’hui sont capables de replier des protéines complexes, de diagnostiquer des maladies rares avec une précision supérieure à celle de l’homme, de piloter des véhicules au milieu d’une circulation chaotique et même de composer des symphonies ou de rédiger des essais philosophiques. Pourtant, si nous observons la cour d’une école maternelle, nous assisterons à une activité quotidienne, apparemment banale, qui constitue un mur infranchissable pour tout esprit synthétique. Il s’agit du jeu symbolique (également connu sous le nom de jeu du « on dirait que »), l’objet principal de notre enquête et le véritable talon d’Achille des machines modernes.

Pourquoi une activité aussi naturelle pour un enfant de trois ans s’avère-t-elle impossible à reproduire, ou même à faire comprendre, par un système informatique avancé ? La réponse se cache dans les replis les plus profonds de la cognition humaine et dans les limites structurelles de la manière dont nous avons conçu nos machines pensantes. Il ne s’agit pas d’un simple manque de puissance de calcul, mais d’un abîme philosophique et technique qui sépare le traitement des données de l’expérience vécue.

Au-delà de la logique : l’anatomie du « Faisons comme si »

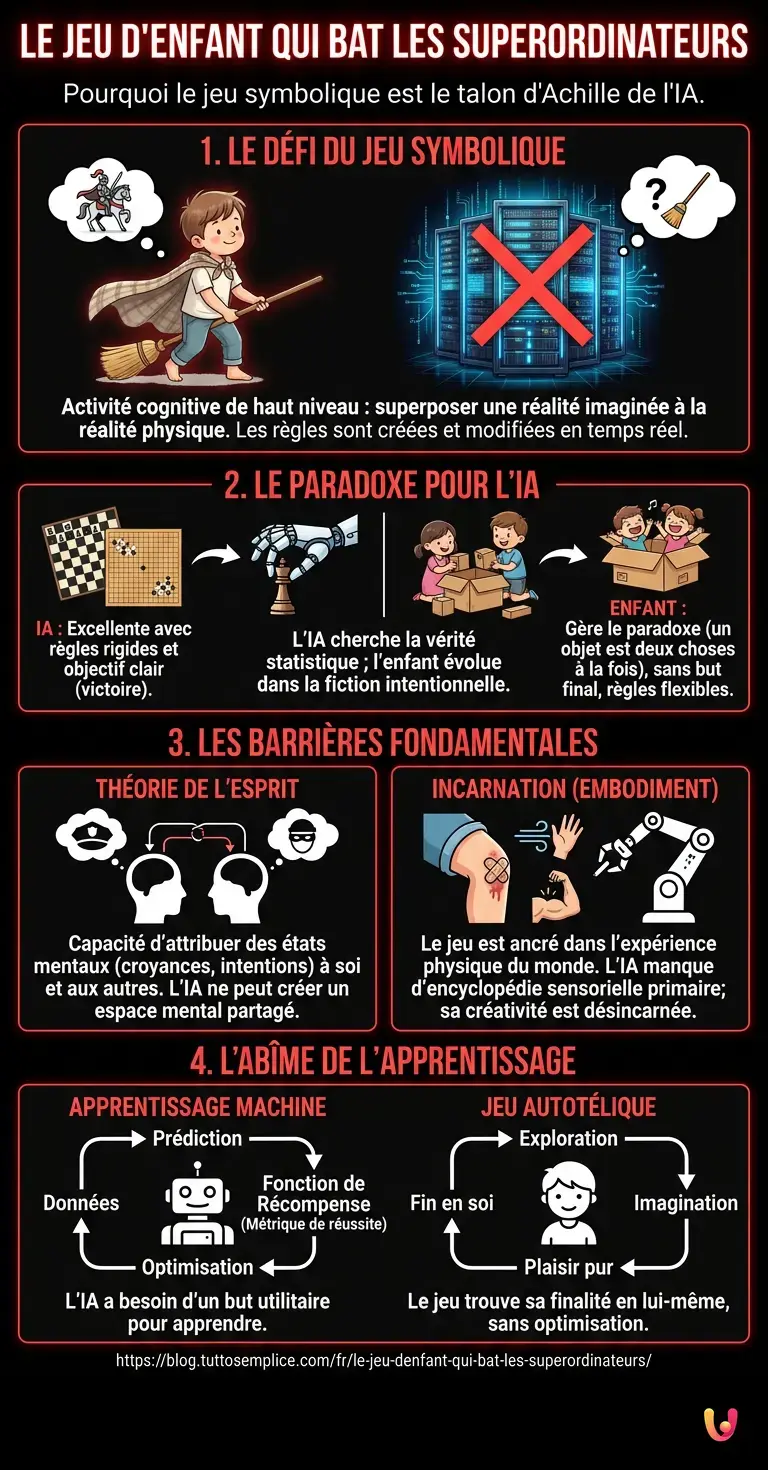

Pour comprendre la portée de ce défi, nous devons d’abord analyser ce qui se passe durant le jeu symbolique. Lorsqu’un enfant saisit un manche à balai et décide qu’il s’agit d’un cheval, ou transforme un carton en vaisseau spatial, il accomplit une opération cognitive de très haut niveau. Il superpose délibérément une réalité imaginée à la réalité physique, tout en conservant la conscience de l’une et de l’autre.

L’enfant sait parfaitement que le balai est un morceau de bois, mais il choisit d’appliquer à cet objet un ensemble de règles physiques et comportementales entièrement nouvelles, inventées sur le moment. Plus surprenant encore est le moment où ce jeu devient social : deux enfants s’accordent instantanément sur le fait que « le sol est de la lave ». Il n’y a besoin d’aucun manuel d’instructions, ni d’aucun ensemble de données préexistantes à analyser. Les règles sont créées, modifiées et abandonnées en temps réel, en se fondant sur des regards, des intuitions et un accord social tacite.

Pour l’ IA , c’est un cauchemar logique. Les systèmes informatiques, aussi complexes soient-ils, opèrent dans le cadre de paramètres définis. Ils peuvent battre le champion du monde d’échecs ou de go car ces jeux, bien que vastes par leurs combinaisons, possèdent des règles rigides et immuables ainsi qu’un objectif clair (la victoire). Le jeu symbolique n’a pas d’objectif final, pas de règles fixes et, surtout, exige la capacité de gérer le paradoxe : une chose est simultanément elle-même et autre chose.

La limite de l’architecture neuronale moderne

Si nous analysons l’ architecture neuronale actuelle qui sous-tend les systèmes les plus avancés, nous comprenons pourquoi cet obstacle est si ardu. Les modèles d’ apprentissage automatique et d’apprentissage profond fonctionnent grâce à la reconnaissance de motifs au sein d’immenses ensembles de données. Ils sont entraînés pour minimiser l’écart entre leurs prédictions et les données réelles.

Mais quelle est la « donnée réelle » dans le jeu du « faire semblant » ? Elle n’existe pas. Lorsqu’un enfant fait semblant de boire dans une tasse vide, un système de vision artificielle entraîné à reconnaître les actions verra simplement « un humain portant un récipient vide à sa bouche ». Il ne peut pas voir le thé imaginaire, car le thé imaginaire n’a pas de pixels, pas de poids, et ne possède aucune représentation vectorielle dans la base de données d’entraînement. L’algorithme recherche la vérité statistique, tandis que l’enfant évolue dans le domaine de la fiction intentionnelle.

Les grands modèles de langage ( LLM ), tels que ChatGPT, peuvent certainement générer un texte décrivant un enfant jouant au pirate. Ils peuvent même simuler un dialogue entre deux pirates imaginaires. Toutefois, il s’agit d’une simulation linguistique, et non d’une compréhension sémantique et situationnelle. Le modèle prédit le mot suivant le plus probable en se basant sur les textes qu’il a lus sur Internet ; il ne « joue » pas. Si l’on modifie soudainement les règles du monde physique au sein d’une simulation non textuelle, le modèle court-circuite, car il ne possède pas l’agilité cognitive nécessaire pour réattribuer instantanément de nouvelles significations aux objets sans un nouveau et long processus d’entraînement (fine-tuning).

Le défi de la « théorie de l’esprit »

Le secret de la capacité des enfants à s’immerger dans ce passe-temps réside dans ce que les psychologues appellent la « théorie de l’esprit » (*Theory of Mind*). Il s’agit de la capacité d’attribuer des états mentaux — croyances, intentions, désirs, émotions et connaissances — à soi-même et aux autres, et de comprendre que les autres possèdent des états mentaux différents des siens.

Lorsque deux enfants jouent aux « gendarmes et aux voleurs », l’enfant qui joue le gendarme doit constamment imaginer ce que pense l’enfant qui joue le voleur, au sein du contexte fictif qu’ils ont créé. Ils doivent partager une intentionnalité. Actuellement, aucun système synthétique ne possède une véritable théorie de l’esprit. Les algorithmes peuvent simuler l’empathie ou prédire le comportement humain en se fondant sur des statistiques passées, mais ils ne parviennent pas à créer un espace mental partagé et dynamique avec un être humain.

Sans cette capacité, l’ automatisation du jeu symbolique est impossible. Un robot doté de l’intelligence artificielle la plus avancée, placé dans une pièce avec des enfants qui font semblant d’être au restaurant, ne saurait pas comment interagir de manière spontanée. Il pourrait reconnaître les objets (assiettes en plastique, faux couverts), mais il ne comprendrait pas qu’à ce moment précis, par convention sociale, un morceau de pâte à modeler verte est devenu un délicieux plat de spaghettis extraterrestres. Pour la machine, la pâte à modeler reste de la pâte à modeler.

Le paradoxe de l’automatisation créative et le problème du corps

Un autre élément crucial qui empêche les esprits synthétiques de comprendre ce passe-temps est l’absence d’un corps vécu, ce que l’on appelle l’« embodiment » en robotique cognitive. Le jeu symbolique est profondément ancré dans l’expérience physique du monde. Un enfant sait comment faire semblant de soulever un rocher très lourd (qui est en réalité un coussin) parce qu’il a l’expérience physique de la gravité, de l’effort musculaire et de la fatigue.

Le progrès technologique nous a dotés de machines capables de traiter des téraoctets d’informations par seconde, mais ces machines n’ont jamais éprouvé ce que signifie s’écorcher le genou, sentir le vent sur son visage ou ressentir le vertige. Par conséquent, leur « créativité » est désincarnée. Lorsqu’un enfant joue, il utilise son propre corps comme principal outil de simulation. L’intelligence artificielle, étant dépourvue de cette encyclopédie sensorielle primaire, ne peut saisir la signification profonde d’une action simulée, se limitant à en enregistrer, dans le meilleur des cas, la cinématique superficielle.

Que se passe-t-il si nous essayons de l’enseigner aux machines ?

Les chercheurs dans le domaine de l’intelligence artificielle générale (IAG) sont parfaitement conscients de cette limite. Ces dernières années, plusieurs benchmarks ont été créés pour tester la capacité des machines à s’adapter à des environnements ouverts et dépourvus de règles fixes. Des tentatives ont été faites pour introduire des agents virtuels dans des mondes simulés, en les récompensant (par le biais de l’apprentissage par renforcement) lorsqu’ils manifestaient des comportements créatifs ou collaboratifs.

Toutefois, les résultats, aussi fascinants soient-ils, demeurent loin du véritable jeu symbolique. Les machines ont tendance à trouver des failles dans le code (ce que l’on appelle les « reward hacks ») pour maximiser leur score, plutôt que de s’adonner à une activité ludique qui serait une fin en soi. Le problème fondamental réside dans le fait que l’IA a besoin d’une fonction de récompense (une métrique de réussite) pour apprendre. Mais quelle est la métrique de réussite lorsqu’il s’agit de faire semblant d’être un dinosaure ? Il n’y en a pas. Le jeu est autotélique : il trouve sa finalité en lui-même. Il s’agit d’un pur plaisir tiré de l’exploration des possibilités, un concept qui échappe totalement à la logique utilitariste et d’optimisation sur laquelle repose l’informatique moderne.

En Bref (TL;DR)

Bien que l’intelligence artificielle excelle dans des tâches complexes, elle échoue face au jeu symbolique des enfants, révélant ainsi une limite structurelle infranchissable pour les machines.

Les systèmes informatiques exigent des paramètres définis et des règles fixes, rendant impossible le traitement des paradoxes créatifs et des réalités changeantes imaginés par les enfants.

La véritable barrière est l’absence de théorie de l’esprit, cette capacité purement humaine de partager des intentions et de comprendre les états mentaux d’autrui.

Conclusions

Alors que nous continuons à repousser les limites de ce que les machines peuvent accomplir, en leur déléguant des tâches de plus en plus complexes et ardues, il est à la fois rassurant et fascinant de découvrir que les sommets les plus élevés de la cognition ne résident pas nécessairement dans les calculs mathématiques les plus abstrus. Ils résident dans l’imagination débridée, dans la capacité à partager des illusions et dans la joie de transformer la réalité par la pensée.

Le jeu symbolique demeure le dernier rempart de l’exclusivité humaine. Il nous rappelle que l’intelligence ne se résume pas à la capacité de résoudre des problèmes ou de traiter des informations, mais qu’elle est aussi celle de rêver éveillé, de donner du sens au néant et de se connecter aux autres à travers des mondes qui n’existent que parce que nous avons décidé, ensemble, de les faire exister. Tant que nous ne parviendrons pas à enseigner à un ordinateur le frisson que procure la transformation d’un carton en vaisseau spatial, nous pourrons avoir la certitude que l’étincelle la plus profonde de l’esprit humain restera inimitable.

Questions fréquentes

Le jeu symbolique constitue une activité cognitive de très haut niveau, au cours de laquelle les enfants transforment des objets ordinaires en éléments imaginaires. Ce processus exige la capacité de gérer des règles flexibles et des paradoxes simultanés. Il s’agit d’une flexibilité mentale extraordinaire qu’il est actuellement impossible de reproduire, même pour les systèmes informatiques les plus avancés.

Les systèmes synthétiques fonctionnent selon des paramètres définis et nécessitent des objectifs clairs pour opérer. À l’inverse, les activités ludiques enfantines fondées sur la fiction ne comportent ni règles fixes ni but ultime à atteindre. Les machines recherchent des vérités statistiques dans les données, tandis que les enfants créent des mondes imaginaires sans avoir besoin d’instructions prédéfinies.

La théorie de l’esprit permet aux êtres humains de comprendre et de partager les états mentaux et les émotions d’autrui. Actuellement, aucun algorithme ne possède cette caractéristique fondamentale pour créer un espace mental partagé. Sans cette empathie cognitive, les robots ne peuvent que simuler des comportements fondés sur des statistiques passées, mais ils sont incapables d’interagir spontanément dans des contextes sociaux complexes.

L’expérience physique du monde est essentielle pour comprendre des concepts pratiques tels que la gravité ou l’effort musculaire. Cette encyclopédie sensorielle primaire permet aux enfants d’utiliser leur propre corps comme outil de simulation durant leurs moments de détente. Les superordinateurs, étant dépourvus de corps vécu, développent une créativité purement théorique qui ne parvient pas à saisir la signification profonde des actions réelles.

Les modèles d’apprentissage automatique nécessitent une métrique de réussite pour apprendre et améliorer leurs performances. Le divertissement enfantin fondé sur l’imagination est, en revanche, autotélique : il trouve sa finalité en lui-même, sans rechercher d’optimisation. Cette absence d’objectif utilitaire remet en question la logique sur laquelle repose l’informatique moderne.

Sources et Approfondissements

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.