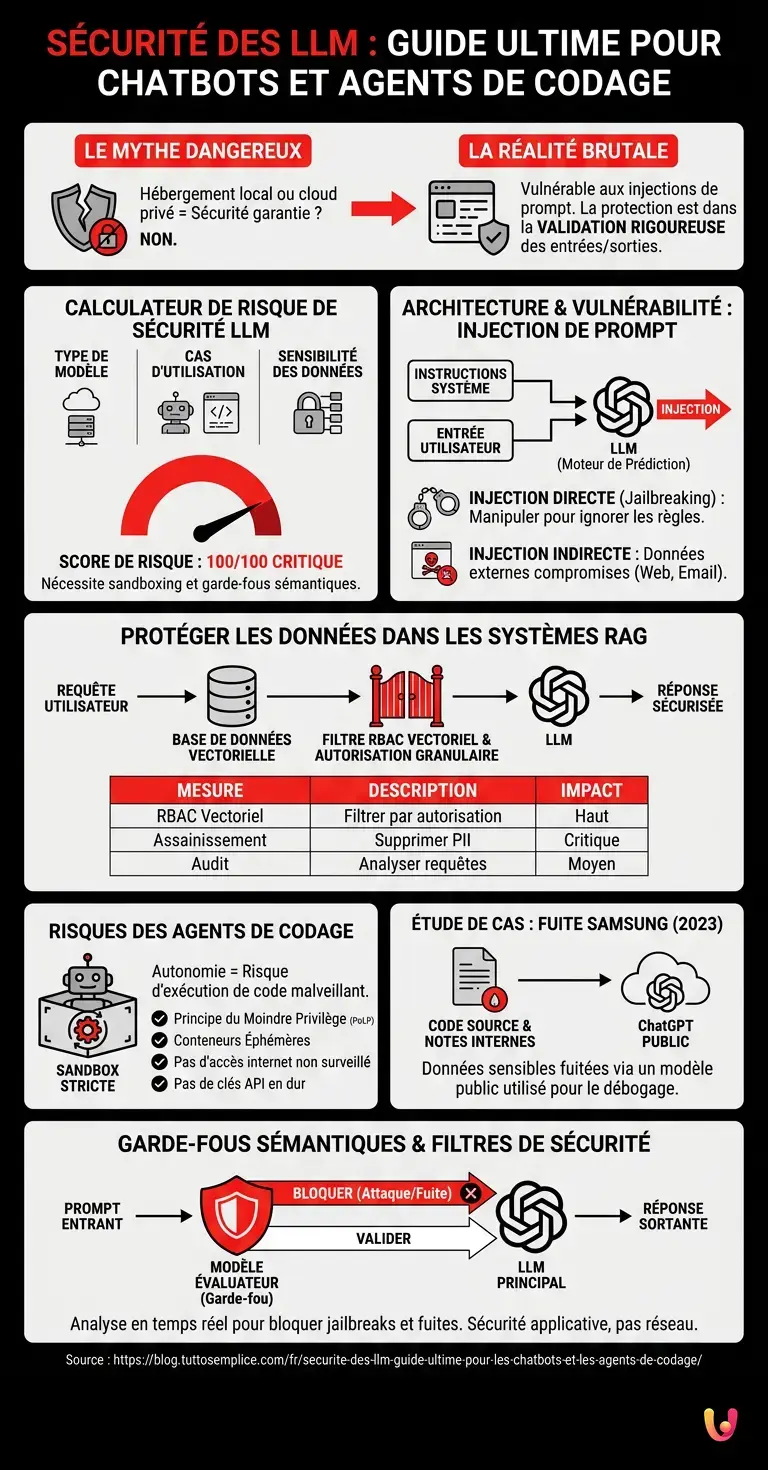

Le faux mythe le plus dangereux dans le monde de l’intelligence artificielle en entreprise est de croire que l’hébergement d’un modèle en local (on-premise) ou l’utilisation d’une instance cloud privée garantit automatiquement la sécurité des LLM . La réalité est brutalement différente : un modèle isolé, s’il est connecté à un agent de codage ou à une base de données d’entreprise via RAG (Retrieval-Augmented Generation), peut être manipulé par injection de prompt pour exfiltrer des données sensibles ou exécuter du code malveillant, contournant complètement les pare-feu traditionnels. La véritable protection ne réside pas dans le périmètre réseau, mais dans la validation rigoureuse des entrées et des sorties du modèle lui-même.

Évaluez le niveau de risque de votre implémentation d’IA.

Architecture et vulnérabilité des modèles linguistiques

Comprendre l’architecture de base est la première étape pour garantir la sécurité des LLM . Les modèles linguistiques traitent le langage naturel, mais leur incapacité native à distinguer les instructions système des entrées utilisateur crée des vulnérabilités critiques, notamment dans les chatbots d’entreprise.

Les grands modèles de langage (LLM) sont fondamentalement des moteurs de prédiction probabiliste. Lorsque nous intégrons un LLM dans une application d’entreprise, nous l’exposons à des vecteurs d’attaque uniques. Selon la documentation officielle OWASP Top 10 pour les LLM , la principale vulnérabilité est l’ injection de prompt . Cela se produit lorsqu’un attaquant insère des instructions cachées dans le prompt qui remplacent les directives originales du système.

Il existe deux variantes principales de cette menace :

- Injection directe d’instructions (Jailbreaking) : L’utilisateur manipule directement le chatbot pour lui faire ignorer les règles de sécurité .

- Injection indirecte d’instructions : Le LLM ingère des données provenant d’une source externe compromise (par exemple, une page web ou un courriel) contenant des instructions malveillantes cachées, influençant ainsi le comportement de l’agent.

Protéger les données d’entreprise dans les systèmes RAG

Dans les systèmes RAG, la sécurité des LLM dépend d’une gestion rigoureuse des droits d’accès. Si un chatbot interroge une base de données d’entreprise sans filtres d’autorisation granulaires, il risque d’exposer des documents confidentiels à des utilisateurs non autorisés via des attaques de manipulation du contexte.

L’architecture Retrieval-Augmented Generation (RAG) est devenue la norme de facto pour fournir aux modèles d’IA l’accès aux données propriétaires. Cependant, la base de données vectorielle qui alimente le RAG devient une cible privilégiée. Si un employé demande au chatbot « Résumez mes objectifs trimestriels », le système doit garantir que le LLM ne récupère et ne traite que les documents auxquels cet employé a explicitement accès.

Pour atténuer les risques de fuite de données , il est impératif de mettre en œuvre :

| Mesure de sécurité | Description | Impact sur le risque |

|---|---|---|

| RBAC vectoriel | Filtrer les résultats de la recherche sémantique en fonction des autorisations de l’utilisateur avant de les envoyer au LLM. | Haut |

| Assainissement des données | Supprimer les informations personnelles identifiables (PII) des documents avant l’intégration. | Critique |

| Audit des requêtes | Enregistrer et analyser les requêtes des utilisateurs afin d’identifier les schémas anormaux ou les tentatives d’exfiltration. | Moyen |

Risques et mesures d’atténuation pour les agents de codage

Lors de l’implémentation d’assistants de programmation, la sécurité des LLM exige l’isolement de l’environnement d’exécution. Les agents de codage autonomes peuvent générer ou exécuter du code malveillant s’ils ne sont pas confinés dans des sandboxes strictes et dépourvus de privilèges système élevés.

Les agents de codage (tels que les implémentations personnalisées basées sur des frameworks d’agents) ne se contentent pas de générer du texte, ils effectuent des actions : ils lisent des référentiels, écrivent des fichiers et, dans certains cas, exécutent des scripts. Ce niveau d’autonomie introduit le risque de conception de plugins non sécurisée et d’exécution de code à distance (RCE) non autorisée.

Si un agent de codage est trompé par un logiciel compromis (attaque de la chaîne d’approvisionnement) ou une instruction malveillante dans un ticket GitHub, il pourrait altérer le code source de l’entreprise. La règle d’or est le principe du moindre privilège (PoLP) : l’agent doit opérer dans des conteneurs éphémères, sans accès non surveillé à internet et sans clés API codées en dur.

Étude de cas : La fuite de données de Samsung (2023)

En 2023, des ingénieurs de Samsung ont involontairement intégré du code source propriétaire et des notes de réunions internes dans ChatGPT pour obtenir de l’aide dans la correction de bugs et la mise en forme. Comme les données saisies dans les modèles publics sont souvent utilisées pour le réentraînement, ces informations hautement sensibles ont fuité hors de l’entreprise, obligeant la société à interdire temporairement l’utilisation d’outils d’IA générative publique et à accélérer le développement de solutions internes sécurisées.

Mettre en œuvre des garde-fous et des filtres de sécurité

L’adoption de garde-fous sémantiques est une pratique essentielle pour la sécurité des LLM . Ces filtres intermédiaires analysent en temps réel les prompts entrants et les réponses sortantes, bloquant les tentatives de jailbreak et empêchant la fuite d’informations sensibles.

Les pare-feu traditionnels basés sur des règles réseau sont inefficaces contre les menaces sémantiques. Il est nécessaire de mettre en œuvre un niveau de sécurité applicative spécifique à l’IA. Des outils open-source comme NeMo Guardrails ou des frameworks propriétaires permettent de définir des limites opérationnelles strictes.

Une architecture de sécurité robuste prévoit un « modèle évaluateur » (souvent un LLM plus petit et plus rapide) qui inspecte la sortie du modèle principal avant qu’elle ne soit présentée à l’utilisateur. Si l’évaluateur détecte que la sortie contient du code malveillant, des données financières non autorisées ou un langage inapproprié, il bloque la transaction et renvoie un message d’erreur standardisé.

Conclusions

En résumé, la sécurité des LLM n’est pas un produit à acheter, mais un processus continu de validation et de surveillance. Protéger les chatbots et les agents de codage nécessite une approche holistique combinant des défenses infrastructurelles, des filtres sémantiques et la formation des développeurs.

L’intégration de l’intelligence artificielle dans les flux de travail des entreprises offre des avantages concurrentiels inestimables, mais elle élargit considérablement la surface d’attaque. Les entreprises qui prospéreront à l’ère de l’IA générative seront celles capables de mettre en œuvre des architectures « Secure by Design », où la validation des entrées, le sandboxing des agents et le contrôle granulaire des accès aux données (RAG) sont considérés comme des exigences fonctionnelles incontournables, et non de simples ajouts a posteriori.

Foire aux questions

Pour protéger les systèmes d’intelligence artificielle contre les manipulations externes, il est fondamental de mettre en œuvre des filtres sémantiques avancés et des barrières de contrôle. Ces outils analysent en temps réel les requêtes des utilisateurs et les réponses générées, bloquant à la source toute tentative de contournement des directives du système. De plus, il est essentiel de séparer rigoureusement les instructions de base des données fournies par les utilisateurs.

De nombreuses entreprises croient à tort que maintenir les serveurs au sein de leur propre périmètre réseau élimine toute menace informatique. En réalité, un système isolé reste vulnérable s’il est connecté à des bases de données d’entreprise ou à des outils de développement, car les attaques sémantiques peuvent exploiter les canaux d’entrée légitimes pour extraire des informations confidentielles. Une véritable défense exige une validation continue des données traitées par le modèle.

Les assistants de programmation disposent d’un niveau d’autonomie élevé qui leur permet de lire des archives, de modifier des fichiers et d’exécuter des scripts opérationnels. Sans restrictions appropriées, un logiciel compromis ou une simple instruction malveillante pourraient amener le système à exécuter des commandes nuisibles sur la machine hôte. Pour atténuer ce risque, il est indispensable de confiner ces ressources dans des environnements isolés et d’appliquer le principe du moindre privilège.

La protection des informations propriétaires dans ces architectures repose sur une gestion extrêmement granulaire des droits d’accès. Avant d’envoyer les résultats d’une recherche sémantique au moteur génératif, le système doit vérifier que l’employé dispose des droits nécessaires pour consulter ces documents spécifiques. Il est également crucial de supprimer les données personnelles sensibles avant l’indexation afin de prévenir les fuites d’informations.

Il s’agit de barrières de sécurité applicatives conçues spécifiquement pour les modèles de langage naturel, capables de surpasser les limitations des pare-feux réseau classiques. Leur fonction principale est de contrôler en permanence le flux de la conversation afin d’identifier et de bloquer les contenus inappropriés, les codes malveillants ou les tentatives d’extraction de données financières. Elles fonctionnent souvent via un modèle d’évaluation secondaire qui approuve ou rejette les transactions en quelques millisecondes.

Encore des doutes sur Sécurité des LLM : Guide ultime pour les chatbots et les agents de codage?

Tapez votre question spécifique ici pour trouver instantanément la réponse officielle de Google.

Avez-vous trouvé cet article utile ? Y a-t-il un autre sujet que vous aimeriez que je traite ?

Écrivez-le dans les commentaires ci-dessous ! Je m’inspire directement de vos suggestions.