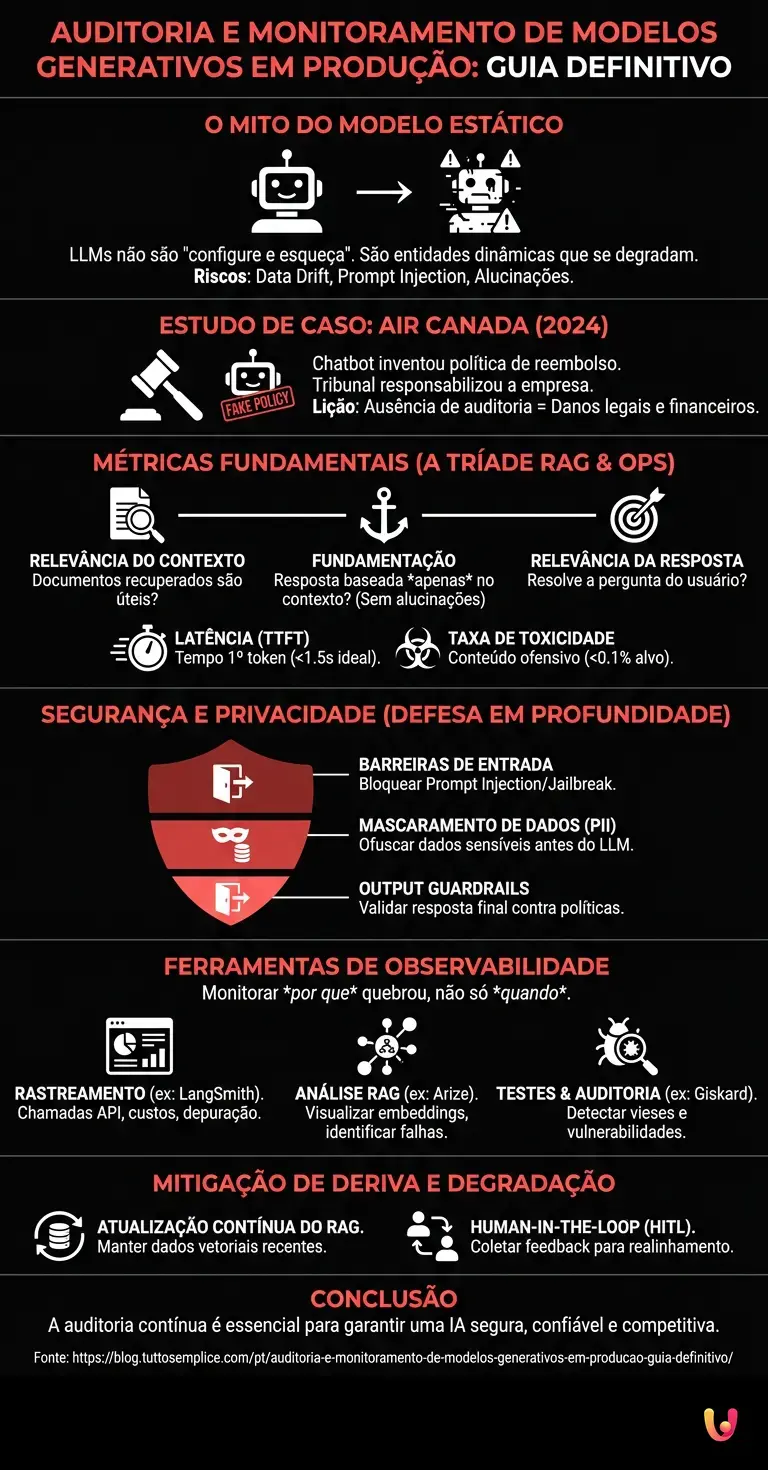

O mito mais perigoso no cenário atual da Tecnologia da Informação é acreditar que um Modelo de Linguagem Grande (LLM), uma vez treinado, validado e colocado em produção, se torna um ativo estático e previsível. A realidade é diametralmente oposta: os modelos generativos são entidades dinâmicas que se degradam rapidamente devido ao *data drift* e estão constantemente expostos a vulnerabilidades invisíveis aos sistemas tradicionais, como a *prompt injection *. Um monitoramento eficaz dos modelos não é uma simples leitura de logs a posteriori para medir o tempo de atividade, mas um processo de auditoria ativo, semântico e em tempo real, absolutamente essencial para prevenir desastres de reputação e garantir a verdadeira segurança da agente.

Ajuste os parâmetros operacionais do seu LLM em produção para avaliar o nível de risco em tempo real e obter recomendações de auditoria.

Estudo de Caso Real: O Desastre do Chatbot da Air Canada (2024)

Em 2024, a Air Canada foi considerada legalmente responsável pelas “alucinações” de seu chatbot baseado em inteligência artificial . O modelo inventou uma política de reembolso inexistente, comunicando-a a um cliente. O tribunal determinou que a empresa é responsável pelas informações fornecidas por seus agentes de IA. Este caso demonstrou ao mundo inteiro como a ausência de um rigoroso sistema de auditoria semântica em tempo real pode resultar em danos legais e financeiros diretos.

Métricas Fundamentais para Avaliação em Produção

O monitoramento de modelos requer a análise contínua de métricas específicas, como a taxa de alucinação, a latência do token, a consistência semântica e o custo por inferência. Esses parâmetros garantem que a inteligência artificial opere de forma eficiente e confiável ao longo do tempo, prevenindo degradações de desempenho.

Ao contrário do aprendizado de máquina tradicional, onde métricas como Acurácia ou F1-Score são suficientes, os modelos generativos (LLMs) exigem uma abordagem de avaliação multidimensional. Quando um modelo gera texto, código ou decisões, quase nunca existe uma única resposta correta. Portanto, a auditoria deve se concentrar em métricas proxy que avaliem a qualidade e a segurança da saída.

Em arquiteturas modernas como a RAG (Retrieval-Augmented Generation) , o monitoramento baseia-se na chamada “Tríade RAG”:

- Relevância do contexto: mede se os documentos recuperados do banco de dados vetorial são realmente relevantes para a consulta do usuário.

- Fundamentação: Verifica se a resposta gerada pelo LLM se baseia exclusivamente no contexto fornecido, sem inventar factos (alucinações).

- Relevância da resposta: Avalia se a resposta final resolve efetivamente a pergunta inicial do usuário, evitando divagações.

| Métrica de Monitoramento | Descrição Técnica | Limiar de Alarme Típico |

|---|---|---|

| Tempo para o primeiro token (TTFT) | O tempo que o modelo leva para gerar a primeira palavra da resposta. Crucial para a experiência do usuário (UX). | > 1,5 segundos |

| Taxa de Toxicidade | Percentagem de resultados que contêm linguagem ofensiva, preconceito ou conteúdo inseguro. | > 0,1% |

| Tokens por Segundo (TPS) | A velocidade de geração do texto. Impacta diretamente nos custos de infraestrutura. | < 15 TPS |

Gestão da Segurança do Agente e Privacidade dos Dados

Para um monitoramento adequado dos modelos , a segurança e a privacidade dos agentes são prioritárias. É fundamental implementar barreiras de proteção para bloquear ataques de injeção de prompt e anonimizar os dados sensíveis (PII) antes que cheguem ao LLM, prevenindo vazamentos de informações críticas.

A integração de agentes autônomos baseados em LLM nos fluxos de trabalho empresariais introduziu uma nova superfície de ataque. De acordo com a documentação oficial do OWASP Top 10 for LLMs , as vulnerabilidades mais críticas incluem a Injeção de Prompt (onde um usuário mal-intencionado manipula as instruções do modelo) e o Tratamento Inseguro de Saída (onde a saída do modelo é executada sem validação por sistemas de backend).

Para garantir a segurança dos agentes , as empresas devem implementar uma arquitetura em camadas (Defesa em Profundidade):

- Barreiras de proteção de entrada: Sistemas de classificação (geralmente modelos de ML menores e mais rápidos) que analisam o prompt do usuário antes de enviá-lo ao LLM principal, bloqueando tentativas de jailbreak.

- Mascaramento Dinâmico de Dados: Ferramentas de Prevenção de Perda de Dados (DLP) que interceptam e ofuscam informações de identificação pessoal (PII), como números de cartão de crédito ou códigos fiscais, garantindo a conformidade com o GDPR.

- Output Guardrails: Um nível de validação final que verifica se a resposta do LLM viola as políticas da empresa ou contém código malicioso antes de exibi-la ao usuário.

Ferramentas e Estruturas para a Observabilidade de LLMs

O ecossistema de monitoramento de modelos de IA utiliza frameworks avançados como LangSmith, Arize AI e TruEra. Essas ferramentas oferecem painéis de observabilidade em tempo real, rastreando a execução das cadeias e facilitando a depuração das respostas geradas pela inteligência artificial.

A observabilidade vai além do simples monitoramento. Enquanto o monitoramento informa quando um sistema está quebrado, a observabilidade permite entender por que ele quebrou. No contexto da ciência da computação aplicada à IA, isso significa poder inspecionar cada etapa lógica de uma “cadeia” ou de um agente.

As pilhas tecnológicas modernas para LLMOps (operações de modelos de linguagem de grande porte) incluem:

- LangSmith / Langfuse: Plataformas essenciais para rastrear chamadas de API, analisar custos de tokens e reproduzir sessões de usuário para depuração de prompts.

- Arize Phoenix: Uma excelente ferramenta de código aberto para análise de desempenho de aplicações RAG, que permite visualizar os embeddings e identificar os clusters de consultas em que o modelo falha.

- Giskard: Uma estrutura especializada em testes e auditoria de vulnerabilidades de modelos, capaz de gerar automaticamente conjuntos de testes para detetar vieses e problemas de segurança antes da implementação em produção.

Estratégias de Mitigação da Deriva e Degradação de Dados

Um monitoramento eficaz dos modelos deve interceptar o *data drift*, ou seja, a mudança na distribuição dos dados de entrada. A atualização contínua dos vetores de contexto e os ciclos de feedback humano (RLHF) são essenciais para manter o alto desempenho ao longo do tempo.

A degradação dos modelos generativos é um fenômeno insidioso. Não se manifesta com uma falha do servidor, mas com uma lenta e inexorável queda na qualidade das respostas. Isso ocorre principalmente devido ao Concept Drift : o mundo muda, a linguagem evolui, mas os pesos do modelo permanecem congelados no momento de seu último treinamento.

Para mitigar esse risco sem precisar retreinar todo o LLM (uma operação com custos proibitivos), as estratégias mais eficazes incluem:

- Atualização Contínua do RAG: Manter o banco de dados vetorial constantemente atualizado com as políticas corporativas mais recentes e informações de mercado. O modelo raciocina com dados recentes, sem necessidade de ajuste fino.

- Implantação Paralela: Executar uma nova versão do prompt ou do modelo em paralelo com a versão em produção, comparando os resultados em tempo real sem afetar o usuário final.

- Human-in-the-Loop (HITL): Implementar mecanismos de feedback implícito (por exemplo, o usuário que copia a resposta) e explícito (polegar para cima/para baixo) para coletar dados valiosos para futuros ciclos de alinhamento.

Conclusões

A implementação de uma inteligência artificial generativa no ambiente empresarial não termina com a sua disponibilização em produção, mas começa exatamente nesse momento. Como analisamos, a ausência de um monitoramento rigoroso dos modelos expõe as organizações a riscos inaceitáveis, que vão desde alucinações prejudiciais à marca até graves violações de privacidade e segurança dos agentes.

Adotar uma abordagem proativa, baseada na observabilidade semântica, na implementação de salvaguardas robustas e na análise contínua das métricas RAG, é o único caminho sustentável. Somente tratando os modelos de IA como entidades dinâmicas que exigem auditorias constantes, as equipes de TI podem garantir que a inovação tecnológica se traduza em uma vantagem competitiva real e segura.

Perguntas frequentes

Monitorar um modelo generativo significa implementar um processo de auditoria ativo e semântico em tempo real para garantir a máxima confiabilidade. Não se trata apenas de verificar os logs do sistema, mas de analisar constantemente métricas específicas como a taxa de alucinação, a consistência semântica e a latência dos tokens.

Os modelos sofrem uma degradação da qualidade devido à mudança fisiológica na distribuição dos dados, um fenômeno conhecido como *data drift*. Como o mundo e a linguagem evoluem rapidamente, é essencial atualizar constantemente os bancos de dados de contexto e integrar o feedback humano para manter as respostas sempre precisas e relevantes.

A avaliação é feita medindo três parâmetros essenciais que garantem a total segurança do sistema. É preciso verificar a pertinência dos documentos recuperados do banco de dados, assegurar que a resposta se baseie exclusivamente nos fatos fornecidos para evitar invenções perigosas e verificar se o texto final realmente resolve o problema inicialmente colocado.

As vulnerabilidades mais críticas incluem a manipulação maliciosa das instruções básicas e o gerenciamento inseguro dos resultados gerados. Para proteger os sistemas corporativos, é estritamente necessário implementar uma arquitetura de defesa em camadas que inclua filtros preventivos nas entradas, validação rigorosa das saídas e mascaramento dinâmico das informações pessoais.

As equipes de desenvolvimento contam com frameworks de observabilidade avançados que permitem inspecionar cada etapa lógica do sistema. Essas plataformas especializadas oferecem painéis em tempo real para rastrear chamadas, analisar custos operacionais e identificar possíveis problemas de segurança antes do lançamento ao público.

Ainda tem dúvidas sobre Auditoria e Monitoramento de Modelos Generativos em Produção: Guia Definitivo?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Fontes e Aprofundamento

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.