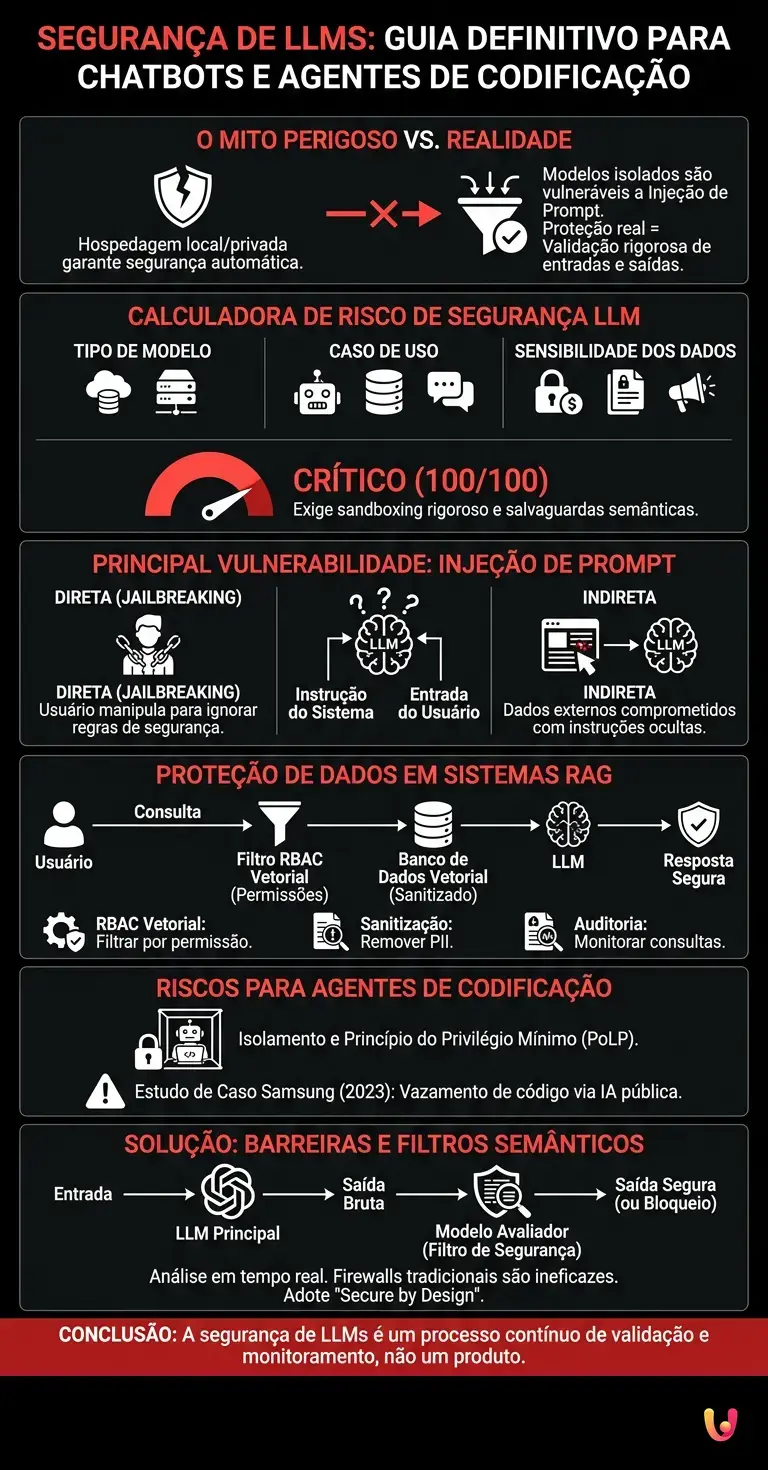

O mito mais perigoso no mundo da inteligência artificial empresarial é acreditar que hospedar um modelo localmente (on-premise) ou usar uma instância de nuvem privada garante automaticamente a segurança do LLM . A realidade é brutalmente diferente: um modelo isolado, se conectado a um agente de codificação ou a um banco de dados corporativo via RAG (Retrieval-Augmented Generation), pode ser manipulado por meio de injeção de prompt para exfiltrar dados sensíveis ou executar código malicioso, contornando completamente os firewalls tradicionais. A verdadeira proteção não reside no perímetro da rede, mas na validação rigorosa das entradas e saídas do próprio modelo.

Avalie o nível de risco da sua implementação de IA.

Arquitetura e Vulnerabilidade dos Modelos Linguísticos

Compreender a arquitetura básica é o primeiro passo para garantir a segurança dos LLMs . Os modelos de linguagem processam a linguagem natural, mas a sua incapacidade inerente de distinguir entre instruções do sistema e entradas do usuário cria vulnerabilidades críticas, especialmente em chatbots corporativos.

Os Modelos de Linguagem de Grande Escala (LLMs) são fundamentalmente motores de predição probabilística. Ao integrar um LLM em uma aplicação empresarial, expomos o sistema a vetores de ataque únicos. De acordo com a documentação oficial do OWASP Top 10 para LLMs , a principal vulnerabilidade é a Injeção de Prompt . Isso ocorre quando um usuário mal-intencionado insere instruções ocultas no prompt que sobrescrevem as diretrizes originais do sistema.

Existem duas variantes principais dessa ameaça:

- Injeção Direta de Prompt (Jailbreaking): O usuário manipula diretamente o chatbot para fazê-lo ignorar as regras de segurança .

- Injeção indireta de prompt: O LLM ingere dados de uma fonte externa comprometida (por exemplo, uma página da web ou um e-mail) que contém instruções maliciosas ocultas, condicionando o comportamento do agente.

Proteger os Dados Empresariais em Sistemas RAG

Em sistemas RAG, a segurança do LLM depende do gerenciamento rigoroso das permissões de acesso. Se um chatbot consulta um banco de dados corporativo sem filtros de autorização granulares, ele corre o risco de expor documentos confidenciais a usuários não autorizados por meio de ataques de manipulação de contexto.

A arquitetura Retrieval-Augmented Generation (RAG) é o padrão de fato para fornecer aos modelos de IA acesso a dados proprietários. No entanto, o banco de dados vetorial que alimenta o RAG se torna um alvo principal. Se um funcionário perguntar ao chatbot “Resuma minhas metas trimestrais”, o sistema deve garantir que o LLM recupere e processe apenas os documentos aos quais esse funcionário tem acesso explícito.

Para mitigar os riscos de vazamento de dados , é imperativo implementar:

| Medida de Segurança | Descrição | Impacto no Risco |

|---|---|---|

| RBAC Vetorial | Filtrar os resultados da pesquisa semântica com base nas permissões do usuário antes de enviá-los para o LLM. | Alto |

| Sanitização de Dados | Remover PII (Informações de Identificação Pessoal) dos documentos antes da incorporação. | Crítico |

| Auditoria de Consultas | Registrar e analisar as consultas dos usuários para identificar padrões anômalos ou tentativas de exfiltração. | Médio |

Riscos e Mitigações para Agentes de Codificação

Ao implementar assistentes de programação, a segurança do LLM exige o isolamento do ambiente de execução. Agentes de codificação autônomos podem gerar ou executar código malicioso se não forem confinados em sandboxes rigorosas e desprovidos de privilégios de sistema elevados.

Agentes de codificação (como implementações personalizadas baseadas em frameworks de agentes) não se limitam a gerar texto, mas realizam ações: leem repositórios, escrevem arquivos e, em alguns casos, executam scripts. Esse nível de autonomia introduz o risco de design de plugin inseguro e de execução remota de código (RCE) não autorizada.

Se um agente de codificação for enganado por meio de um pacote de software comprometido (ataque à cadeia de suprimentos) ou uma instrução maliciosa em um ticket do GitHub, ele poderá alterar o código-fonte da empresa. A regra de ouro é o princípio do privilégio mínimo (PoLP): o agente deve operar em contêineres efêmeros, sem acesso não monitorado à internet e sem chaves de API codificadas.

Estudo de Caso: O Vazamento de Dados da Samsung (2023)

Em 2023, engenheiros da Samsung inseriram acidentalmente código-fonte proprietário e anotações de reuniões internas no ChatGPT para obter ajuda na correção de bugs e na formatação. Como os dados inseridos em modelos públicos são frequentemente usados para retreinamento, essas informações altamente confidenciais vazaram do perímetro da empresa, forçando a empresa a proibir temporariamente o uso de ferramentas de IA generativa pública e a acelerar o desenvolvimento de soluções internas seguras.

Implementar Barreiras de Proteção e Filtros de Segurança

A adoção de salvaguardas semânticas é uma prática fundamental para a segurança de LLMs . Esses filtros intermediários analisam em tempo real tanto os prompts de entrada quanto as respostas de saída, bloqueando tentativas de jailbreak e prevenindo o vazamento de informações sensíveis.

Os firewalls tradicionais baseados em regras de rede são ineficazes contra ameaças semânticas. É necessário implementar um nível de segurança de aplicação específico para IA. Ferramentas de código aberto como o NeMo Guardrails ou frameworks proprietários permitem definir limites operacionais rígidos.

Uma arquitetura de segurança robusta prevê um “modelo avaliador” (frequentemente um LLM menor e mais rápido) que inspeciona a saída do modelo principal antes que ela seja exibida ao usuário. Se o avaliador detectar que a saída contém código malicioso, dados financeiros não autorizados ou linguagem inadequada, ele bloqueia a transação e retorna uma mensagem de erro padronizada.

Conclusões

Em resumo, a segurança de LLMs não é um produto a ser comprado, mas um processo contínuo de validação e monitoramento. Proteger chatbots e agentes de codificação exige uma abordagem holística que combine defesas de infraestrutura, filtros semânticos e treinamento de desenvolvedores.

A integração da inteligência artificial nos fluxos de trabalho empresariais oferece vantagens competitivas incalculáveis, mas expande dramaticamente a superfície de ataque. As empresas que prosperarão na era da IA generativa serão aquelas capazes de implementar arquiteturas “Secure by Design”, onde a validação de entradas, o sandboxing de agentes e o controle granular de acesso aos dados (RAG) são considerados requisitos funcionais essenciais, não meros complementos posteriores.

Perguntas frequentes

Para proteger os sistemas de inteligência artificial contra manipulações externas, é fundamental implementar filtros semânticos avançados e barreiras de controle. Essas ferramentas analisam em tempo real as solicitações dos usuários e as respostas geradas, bloqueando desde o início qualquer tentativa de contornar as diretrizes do sistema. Além disso, é essencial separar rigorosamente as instruções básicas dos dados fornecidos pelos usuários.

Muitas empresas acreditam erroneamente que manter os servidores dentro do seu perímetro de rede elimina todas as ameaças cibernéticas. Na realidade, um sistema isolado permanece vulnerável se conectado a bancos de dados corporativos ou ferramentas de desenvolvimento, pois ataques semânticos podem explorar canais de entrada legítimos para extrair informações confidenciais. A verdadeira defesa exige uma validação contínua dos dados processados pelo modelo.

Os assistentes de programação possuem um alto nível de autonomia, o que lhes permite ler arquivos, modificar arquivos e executar scripts operacionais. Sem restrições adequadas, um pacote de software comprometido ou uma simples instrução maliciosa podem levar o sistema a executar comandos prejudiciais na máquina hospedeira. Para mitigar esse risco, é indispensável confinar esses recursos em ambientes isolados e aplicar o princípio do privilégio mínimo.

A proteção das informações proprietárias nessas arquiteturas baseia-se numa gestão extremamente granular das permissões de acesso. Antes de enviar os resultados de uma pesquisa semântica para o motor generativo, o sistema deve verificar se o funcionário possui os direitos necessários para visualizar esses documentos específicos. Além disso, é crucial remover os dados pessoais sensíveis antes da fase de indexação para evitar fugas de informação.

Trata-se de barreiras de segurança de aplicativos projetadas especificamente para modelos de linguagem natural, capazes de superar as limitações dos firewalls de rede tradicionais. Sua principal função é monitorar constantemente o fluxo da conversa para identificar e bloquear conteúdo inadequado, códigos maliciosos ou tentativas de extração de dados financeiros. Frequentemente, funcionam por meio de um modelo avaliador secundário que aprova ou rejeita as transações em milissegundos.

Ainda tem dúvidas sobre Segurança de LLMs: Guia Definitivo para Chatbots e Agentes de Codificação?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Fontes e Aprofundamento

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.