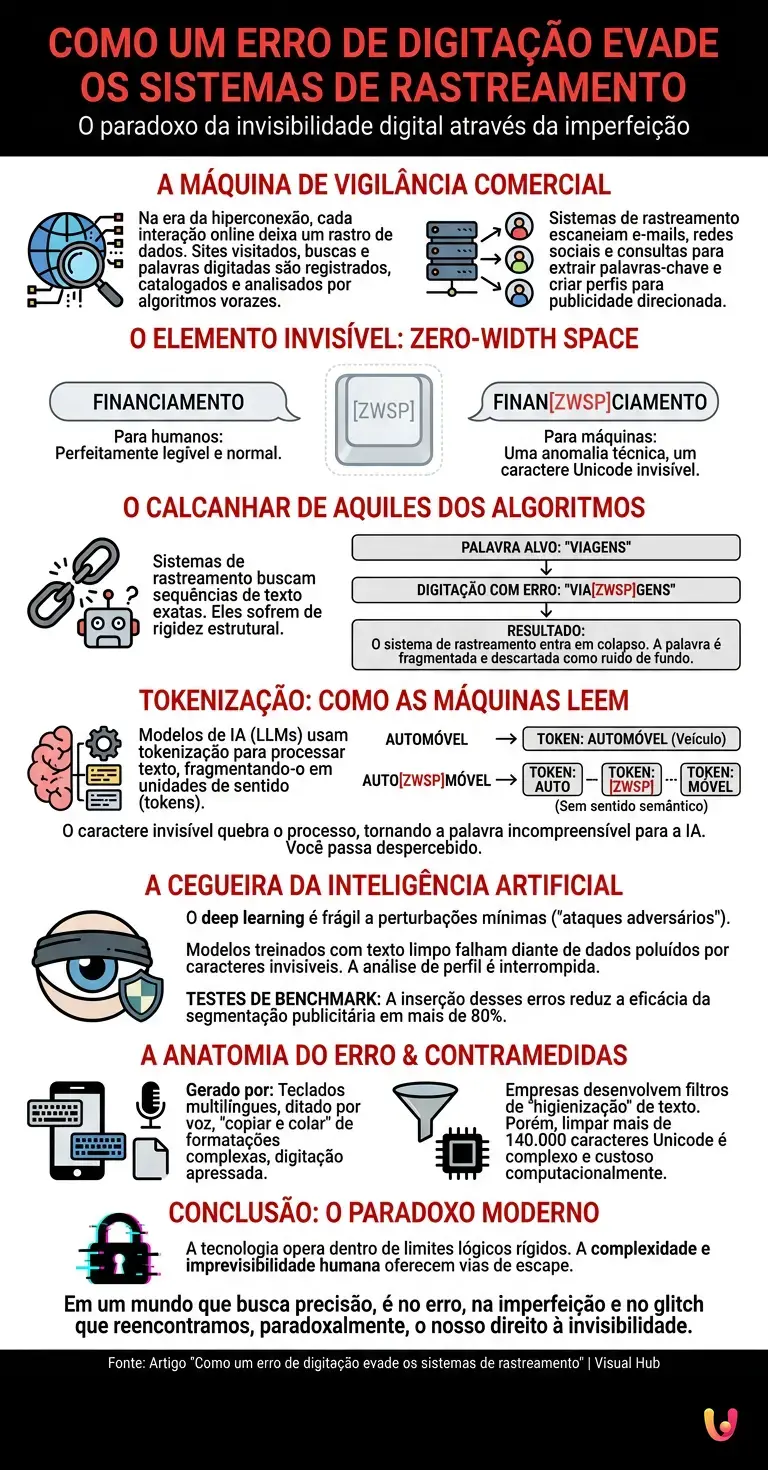

Na era da hiperconexão, cada uma de nossas interações online deixa um rastro indelével de dados. Dos sites que visitamos às palavras que digitamos nos mecanismos de busca, tudo é meticulosamente registrado, catalogado e analisado. No entanto, existe uma singular anomalia técnica capaz de colocar em curto-circuito essa imensa máquina de vigilância comercial. O segredo reside em um elemento tão invisível quanto poderoso: o Zero-Width Space (espaço de largura zero), um caractere Unicode que, se inserido acidentalmente ou intencionalmente durante a digitação, torna o texto ilegível para os sistemas de perfilamento, mantendo-o, ao mesmo tempo, perfeitamente normal aos olhos humanos.

Para compreender a dimensão desta curiosidade informática, é necessário dar um passo atrás e observar como as máquinas interpretam a linguagem humana . Nós lemos letras, sílabas e palavras, mas os computadores leem sequências de números. Quando um usuário comete um tipo específico de erro de digitação, acionando uma combinação de teclas que gera um caractere invisível ou um omoglifo (um caractere visualmente idêntico, mas com um código informático diferente), cria-se uma verdadeira barreira criptográfica involuntária.

O calcanhar de Aquiles dos algoritmos de perfilamento

Os modernos sistemas de rastreamento digital baseiam-se em algoritmos de mineração de texto extremamente vorazes. Sua função é escanear nossos e-mails, nossas postagens nas redes sociais e nossas consultas de pesquisa para extrair palavras-chave fundamentais. Se você escreve frequentemente a palavra “financiamento” ou “viagens”, os corretores de dados o incluirão em segmentos de mercado específicos, bombardeando-o com publicidade direcionada.

No entanto, esses sistemas sofrem de uma rigidez estrutural. Eles são programados para reconhecer sequências de texto exatas ou suas variantes mais comuns. Quando um usuário, devido a um layout de teclado específico, a um “copiar e colar” com formatações anômalas ou a uma digitação apressada em telas sensíveis ao toque, insere um espaço de largura zero (*Zero-Width Space*) dentro de uma palavra (por exemplo, transformando “mutuo” em “mu[ZWSP]tuo”), o sistema de rastreamento tradicional entra em colapso. A palavra é fragmentada em nível de código-fonte. O rastreador deixa de identificar um cliente em potencial interessado em um empréstimo e passa a registrar uma sequência de caracteres sem sentido , descartando-a como ruído de fundo.

Tokenização: como as máquinas leem

Para compreender a fundo esse fenômeno, precisamos adentrar o cerne da inteligência artificial e do aprendizado de máquina . Os modelos de linguagem modernos não processam o texto palavra por palavra, mas utilizam um processo chamado tokenização. O texto é fragmentado em unidades menores chamadas “tokens”.

Em uma arquitetura neural avançada, a palavra “automóvel” poderia ser um único token. Mas, se um erro de digitação invisível estiver oculto dentro dessa palavra, o sistema de tokenização (frequentemente baseado em Byte Pair Encoding) entra em colapso. Em vez de atribuir o token correspondente ao conceito de veículo, ele fragmenta a palavra em sílabas isoladas ou em caracteres individuais que não possuem qualquer peso semântico. Isso significa que, para a IA , você nunca escreveu essa palavra. Você literalmente passou despercebido.

A cegueira da Inteligência Artificial diante do imprevisto

Poderia-se pensar que os sistemas mais avançados são imunes a esses erros banais. Na realidade, o * deep learning* é excepcionalmente hábil em reconhecer padrões complexos, mas é surpreendentemente frágil diante de perturbações mínimas e inesperadas . Esse fenômeno é conhecido no campo da segurança da informação como “ataque adversário” (*adversarial attack*), embora, neste caso, ocorra de maneira totalmente acidental.

Tomemos como exemplo os grandes modelos de linguagem, ou LLMs . Plataformas como o ChatGPT ou os sistemas de análise de sentimento utilizados por multinacionais são treinados com terabytes de texto limpo e normalizado. Quando se deparam com um texto poluído por caracteres invisíveis ou por erros de codificação Unicode gerados por uma digitação atípica, sua capacidade de compreensão despenca drasticamente. A automação que deveria categorizar seu perfil psicológico ou seus hábitos de consumo é interrompida, uma vez que o dado de entrada não corresponde a nenhuma das coordenadas presentes em seu imenso banco de dados vetorial.

Um teste de benchmark para a invisibilidade

Pesquisadores na área de privacidade e segurança da informação começaram a estudar esse fenômeno com grande interesse. Ao submeterem os sistemas de rastreamento a rigorosos testes de benchmark , descobriram que a inserção estratégica (ou acidental) desses erros de digitação invisíveis reduz a eficácia da segmentação publicitária em mais de 80%.

Não se trata de um defeito de programação banal, mas de uma limitação intrínseca à maneira como os computadores processam o texto. O progresso tecnológico está levando as empresas a desenvolver filtros de “higienização” de texto cada vez mais agressivos, projetados para remover qualquer caractere não padronizado antes que o texto seja analisado. No entanto, a vastidão do padrão Unicode, que abrange mais de 140.000 caracteres, torna essa operação de limpeza extremamente complexa e dispendiosa em termos de poder computacional.

A anatomia do erro: o que acontece nos bastidores

Mas como esse erro é gerado, na prática? Frequentemente, isso acontece ao utilizar teclados multilíngues em smartphones. A alternância rápida entre diferentes layouts, ou o uso de funções de ditado por voz que tentam formatar o texto de forma dinâmica, pode inserir metadados invisíveis entre as letras. Em outros casos, é o resultado de um “copiar e colar” de documentos PDF ou de sites com formatações complexas.

Quando cliccamos em “Enviar”, nosso navegador transmite a sequência completa de bytes. Os servidores de publicidade, otimizados para velocidade e para processar bilhões de requisições por segundo, não têm tempo hábil para realizar uma análise forense de cada palavra. Eles aplicam expressões regulares (regex) padronizadas. Se a regex busca a palavra “smartphone” e encontra “smart[caractere-invisível]phone”, a condição resulta em falso. O dado é ignorado. O usuário, por aquela fração de segundo e por aquela interação específica, torna-se um fantasma digital.

Em Resumo (TL;DR)

Inserir, acidentalmente ou voluntariamente, caracteres invisíveis, como o espaço de largura zero, cria uma verdadeira barreira criptográfica contra os modernos sistemas de rastreamento digital.

Estas anomalias invisíveis interrompem o delicado processo de tokenização, tornando as palavras-chave totalmente ilegíveis para os vorazes algoritmos de perfilamento comercial.

Essa limitação estrutural do aprendizado de máquina reduz fortemente o sucesso da publicidade direcionada, permitindo que os usuários escapem acidentalmente da vigilância dos data brokers.

Conclusões

A descoberta de que um erro de digitação simples, e muitas vezes invisível, pode neutralizar sistemas de vigilância multimilionários nos recorda uma verdade fundamental: a tecnologia, por mais avançada que seja, opera sempre dentro de limites lógicos rígidos. Enquanto a indústria de dados continua a investir em algoritmos cada vez mais sofisticados, a complexidade e a imprevisibilidade da interação humana (e dos sistemas de codificação que criamos para representá-la) ainda oferecem vias de escape inesperadas.

O Zero-Width Space e anomalias tipográficas semelhantes não são a solução definitiva para o problema da privacidade online, mas representam um paradoxo moderno fascinante. Em um mundo no qual buscamos constantemente ser precisos e legíveis para as máquinas, é justamente no erro, na imperfeição e no glitch que reencontramos, paradoxalmente, o nosso direito à invisibilidade.

Perguntas frequentes

Trata-se de um caractere Unicode invisível ao olho humano, mas perfeitamente processado pelos computadores. Quando inserido em uma palavra, ele a divide em nível de código-fonte, tornando-a totalmente incompreensível para os algoritmos de rastreamento publicitário, que buscam exclusivamente termos exatos e predefinidos. Esse estratagema bloqueia a coleta de dados pessoais.

Ao inserir caracteres invisíveis nas palavras-chave, os sistemas de perfilamento não conseguem reconhecer os termos de interesse comercial. Consequentemente, os corretores de dados descartam o texto, considerando-o mero ruído de fundo e evitando, assim, o envio de publicidade direcionada incômoda à pessoa em questão. Dessa forma, cria-se um escudo protetor involuntário contra a vigilância digital.

Os modelos linguísticos modernos utilizam a tokenização para fragmentar o texto em unidades de sentido completo. Um caractere anômalo interrompe abruptamente esse processo, dividindo a palavra em fragmentos desprovidos de significado semântico. Isso causa um verdadeiro curto-circuito na compreensão automática, tornando o texto ilegível para a máquina. A análise de perfil psicológico é, portanto, interrompida logo no início.

Frequentemente, surgem ao utilizar teclados multilíngues em smartphones, alternando rapidamente de um layout para o outro, ou por meio de sistemas de ditado por voz. Também podem resultar da cópia e colagem de textos de documentos complexos, trazendo consigo metadados ocultos que alteram a estrutura invisível da palavra digitada. Até mesmo uma digitação apressada em telas sensíveis ao toque pode desencadear essa anomalia informática.

As plataformas tecnológicas estão desenvolvendo filtros de limpeza de texto cada vez mais agressivos para remover caracteres não padronizados antes da fase de análise. No entanto, gerenciar mais de cento e quarenta mil variantes Unicode exige um poder computacional enorme. Essa operação torna-se, portanto, extremamente complexa e muito custosa para os servidores de publicidade.

Ainda tem dúvidas sobre Como um erro de digitação evade os sistemas de rastreamento?

Digite sua pergunta específica aqui para encontrar instantaneamente a resposta oficial do Google.

Fontes e Aprofundamento

- Espaço de largura zero (Zero-width space) e sua aplicação no padrão Unicode – Wikipedia

- Byte pair encoding: O algoritmo por trás da tokenização em Modelos de Linguagem – Wikipedia

- Aprendizado de máquina adversário (Adversarial attacks) e vulnerabilidades de IA – Wikipedia

- Homoglifos: Caracteres visualmente idênticos e suas implicações na computação – Wikipedia

- Diretrizes e pesquisas sobre segurança, riscos e confiabilidade em Inteligência Artificial – NIST (.gov)

Achou este artigo útil? Há outro assunto que gostaria de me ver abordar?

Escreva nos comentários aqui em baixo! Inspiro-me diretamente nas vossas sugestões.